2025 年大模型实践总结

具身智能

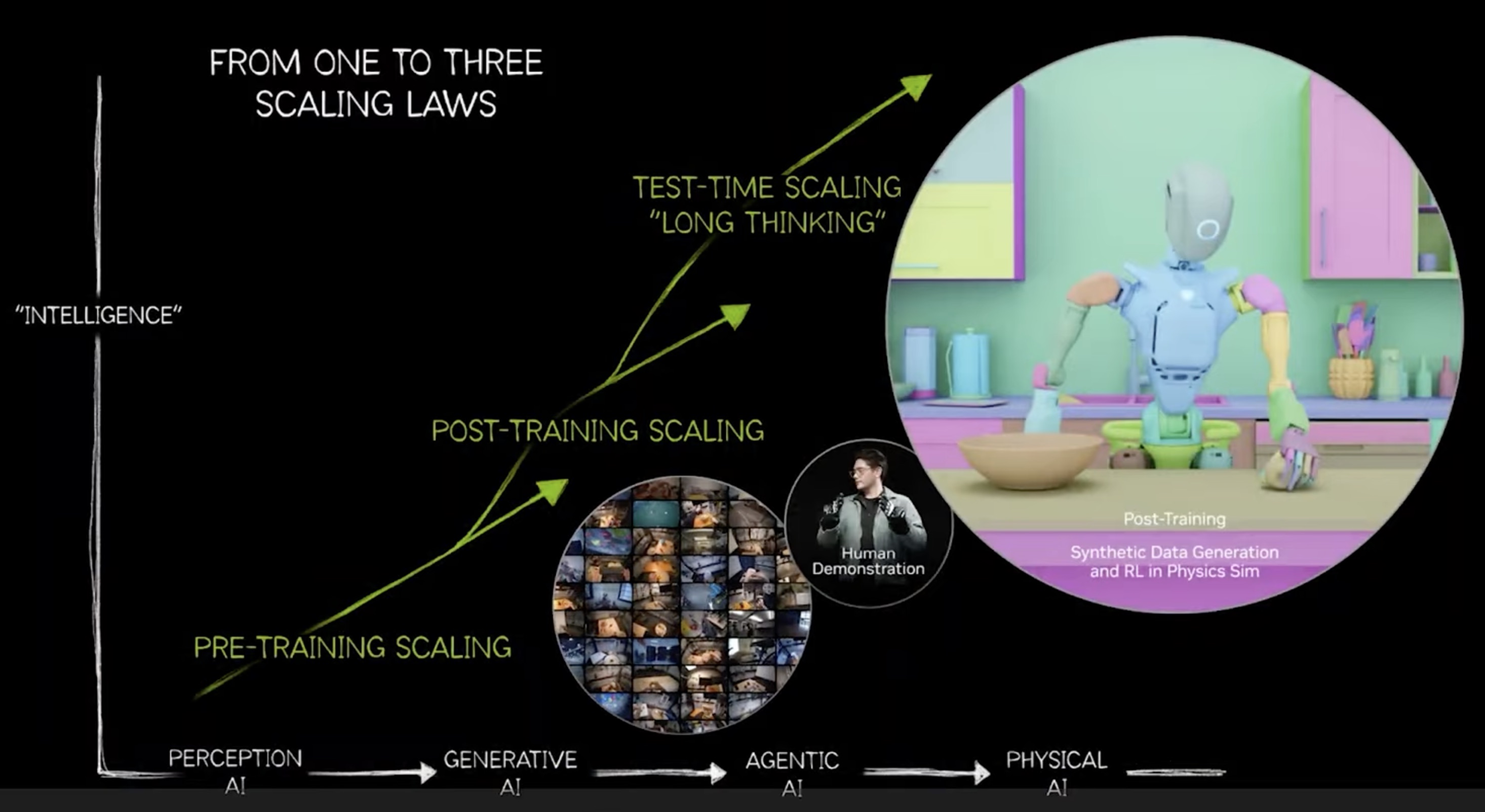

Scaling Laws

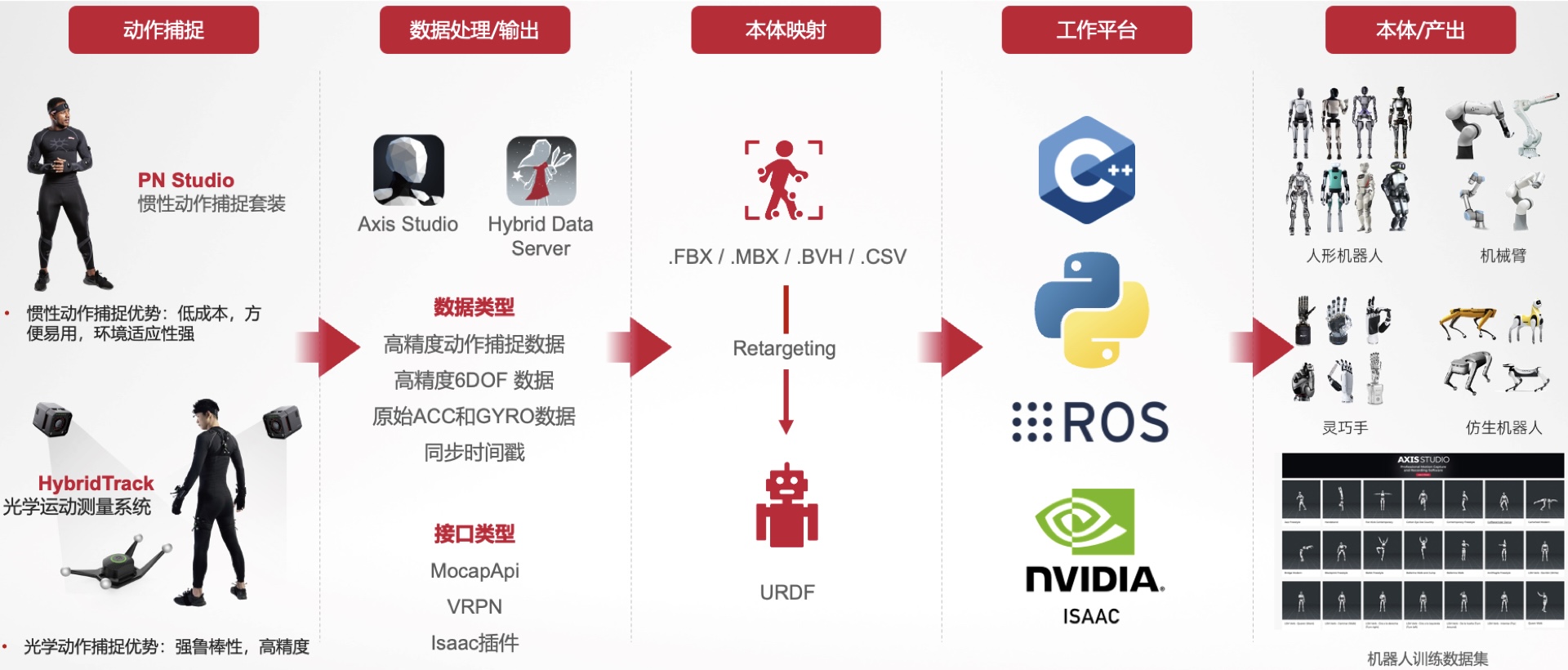

全链路解决方案

1. 动作捕捉

这一阶段负责采集人类的原始动作数据。图中列出了两种主要技术:

- PN Studio (惯性动捕): 利用惯性传感器套件。优点是成本低、易用、环境适应性强。

- HybridTrack (光学动捕): 利用摄像头和标记点。优点是鲁棒性强、精度极高。

2. 数据处理/输出

捕捉到的信号通过 Axis Studio 或 Hybrid Data Server 进行初步处理。

- 数据类型: 包括高精度动捕数据、6DOF(六自由度)数据、原始加速度(ACC)和陀螺仪(GYRO)数据,以及同步时间戳。

- 接口类型: 支持 MocapApi、VRPN 以及专门的 Isaac 插件。

3. 本体映射

这是将人类动作转化为机器人动作的关键步骤。

- 输入格式: 常见的 3D 动画格式,如

.FBX、.MBX、.BVH和数据格式.CSV。 - 重定向 (Retargeting): 通过算法将人类的骨架运动映射到机器人的 URDF(统一机器人描述格式)模型上,确保动作符合机器人的物理结构约束。

4. 工作平台

展示了开发和仿真所使用的核心软件生态:

- 编程语言: C++ 和 Python。

- 中间件: ROS (Robot Operating System),用于机器人控制。

- 仿真环境: NVIDIA ISAAC,一个强大的机器人仿真和人工智能训练平台。

5. 本体/产出

最终的应用成果,分为两个方向:

- 硬件执行: 将动作应用到不同形态的机器人上,包括人形机器人、机械臂、灵巧手以及仿生机器人(如四足机器人)。

- 数据资产: 生成大规模的机器人训练数据集,用于后续的机器学习和算法优化。

GROOT

数据工厂

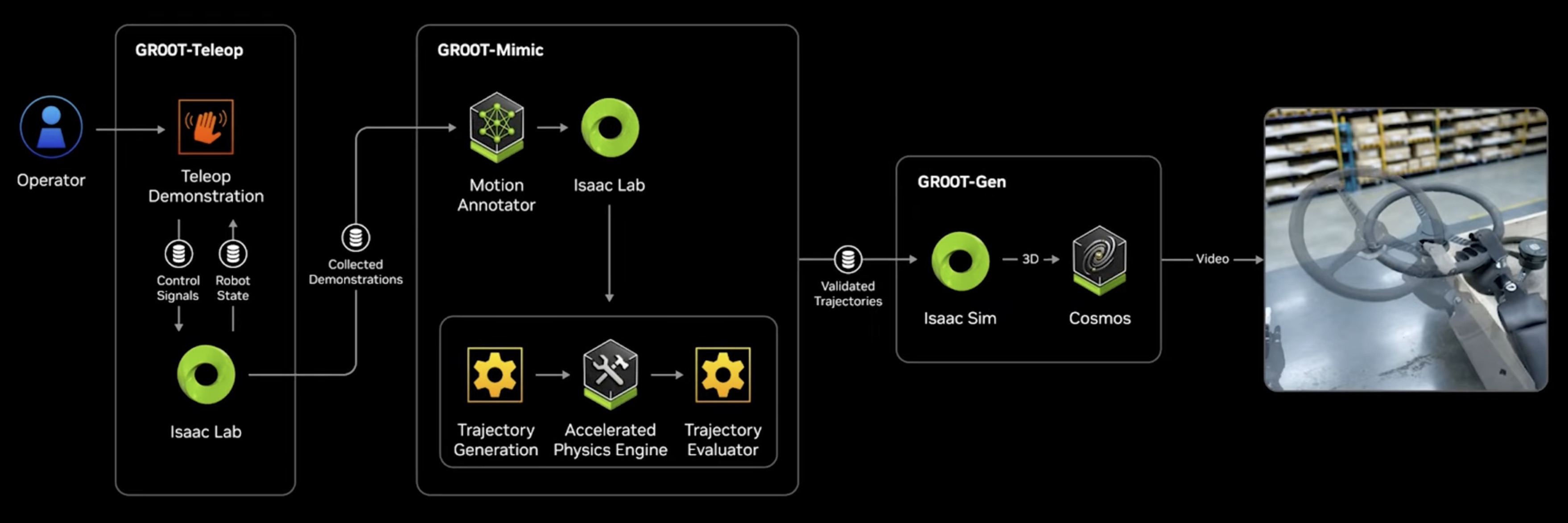

展示了从人类演示到生成大规模合成训练数据的全过程。

- GR00T-Teleop(远程操作集): 人类操作员在 Isaac Lab 虚拟环境中进行动作演示,系统实时记录控制信号与机器人状态,形成初步的“收集演示数据集”。

- GR00T-Mimic(动作模仿与评估): 该阶段利用 Motion Annotator 对动作进行标注,并通过 Isaac Lab 的加速物理引擎进行海量轨迹生成。随后,Trajectory Evaluator 会对这些轨迹进行验证,确保动作在物理规律下的可行性,从而产出“验证后的轨迹数据集”。

- GR00T-Gen(视频与环境生成): 经过验证的 3D 轨迹被导入 Isaac Sim,并结合 Cosmos(NVIDIA 的世界模型)生成高保真的视频数据。这些逼真的视觉反馈最终用于训练机器人的视觉感知与决策能力。

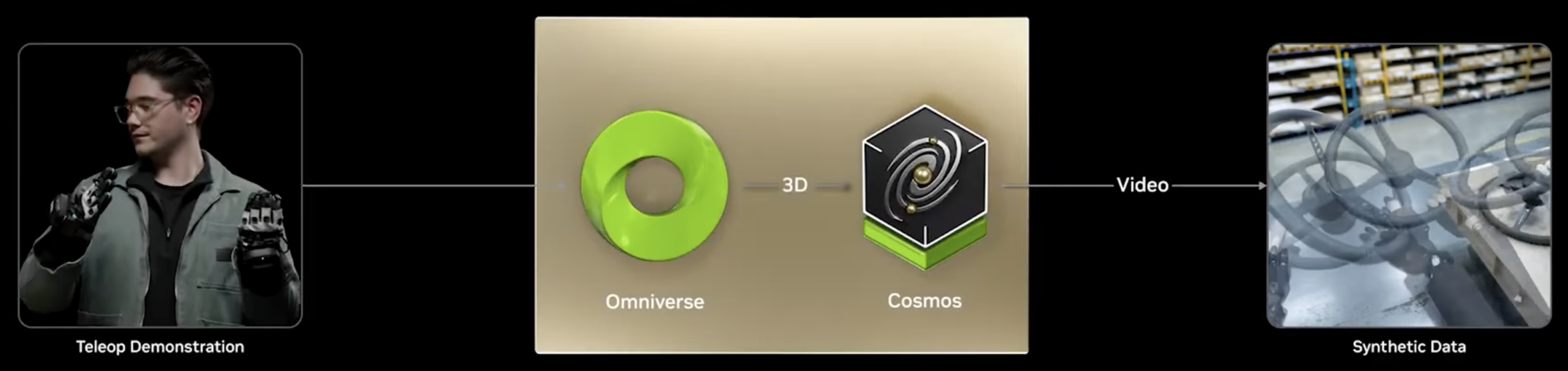

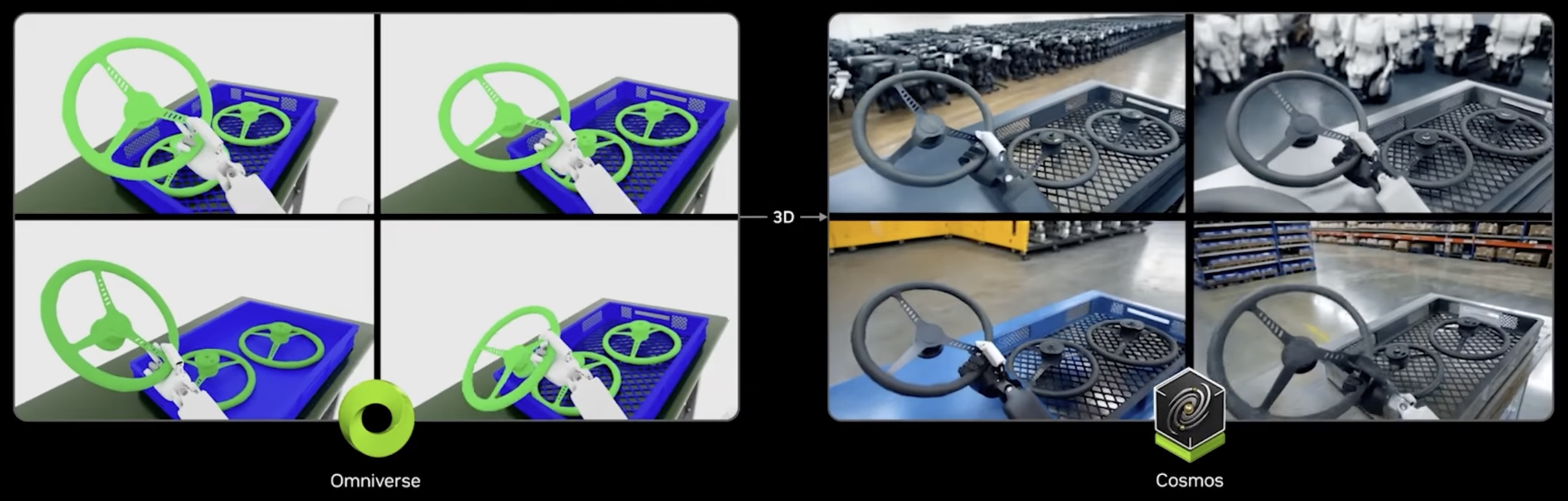

Omniverse 是一个基于 OpenUSD 标准的工业数字化开发平台,它像是一个“虚拟世界构建器”,允许开发者将分散的 3D 设计工具连接起来,创建遵循物理定律的数字孪生场景,用于机器人仿真、协同设计和初步的合成数据生成。

Cosmos 是一个专为物理 AI 打造的生成式世界基础模型(World Foundation Model),它像是一个“视频生成的超级引擎”,能够理解重力、光影等复杂物理规律,将 Omniverse 中的 3D 草图或简单的视频输入,转化并扩增为极其逼真、具有预测能力的感官训练数据,从而极大提升机器人对现实世界的适应性。

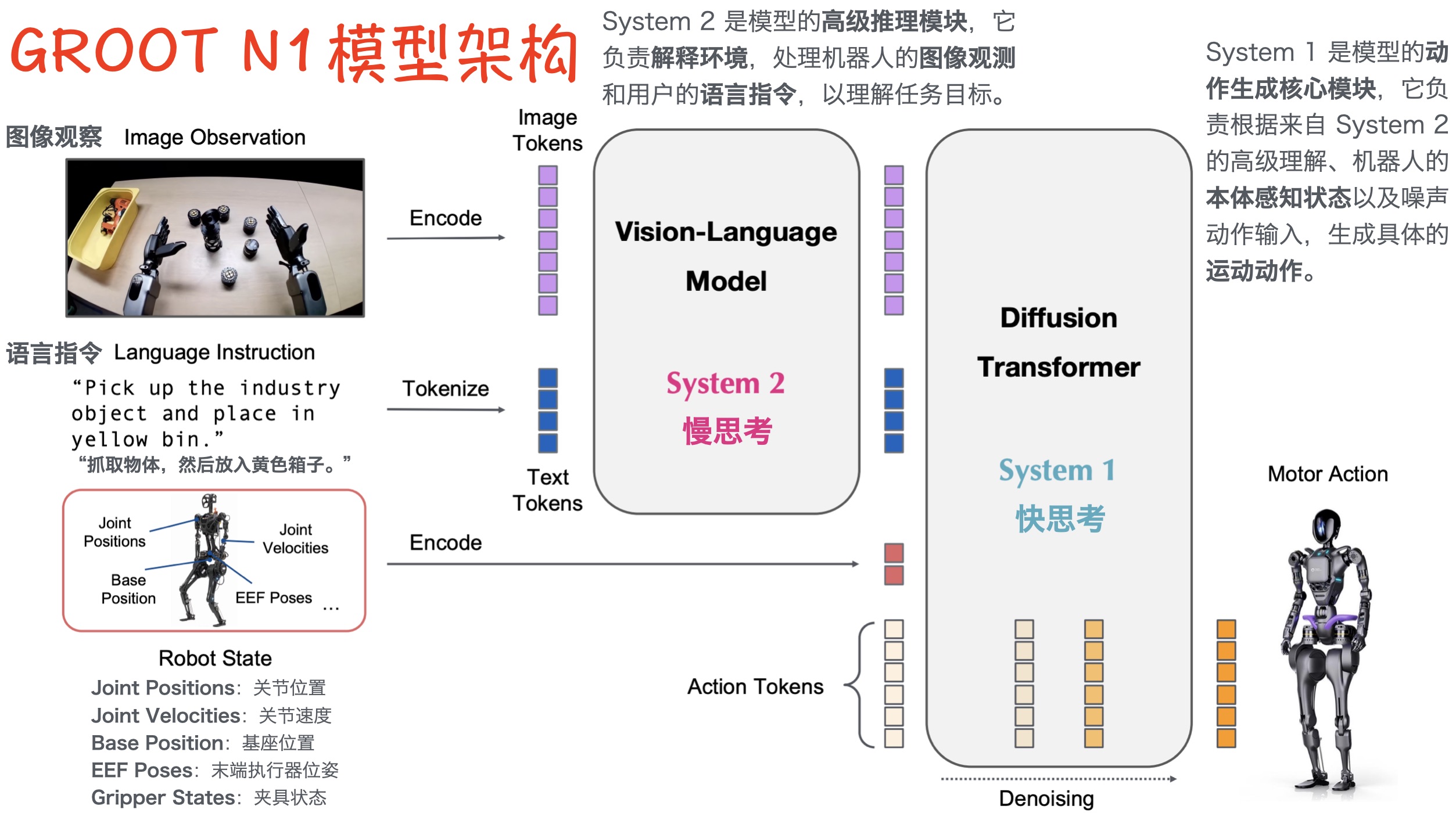

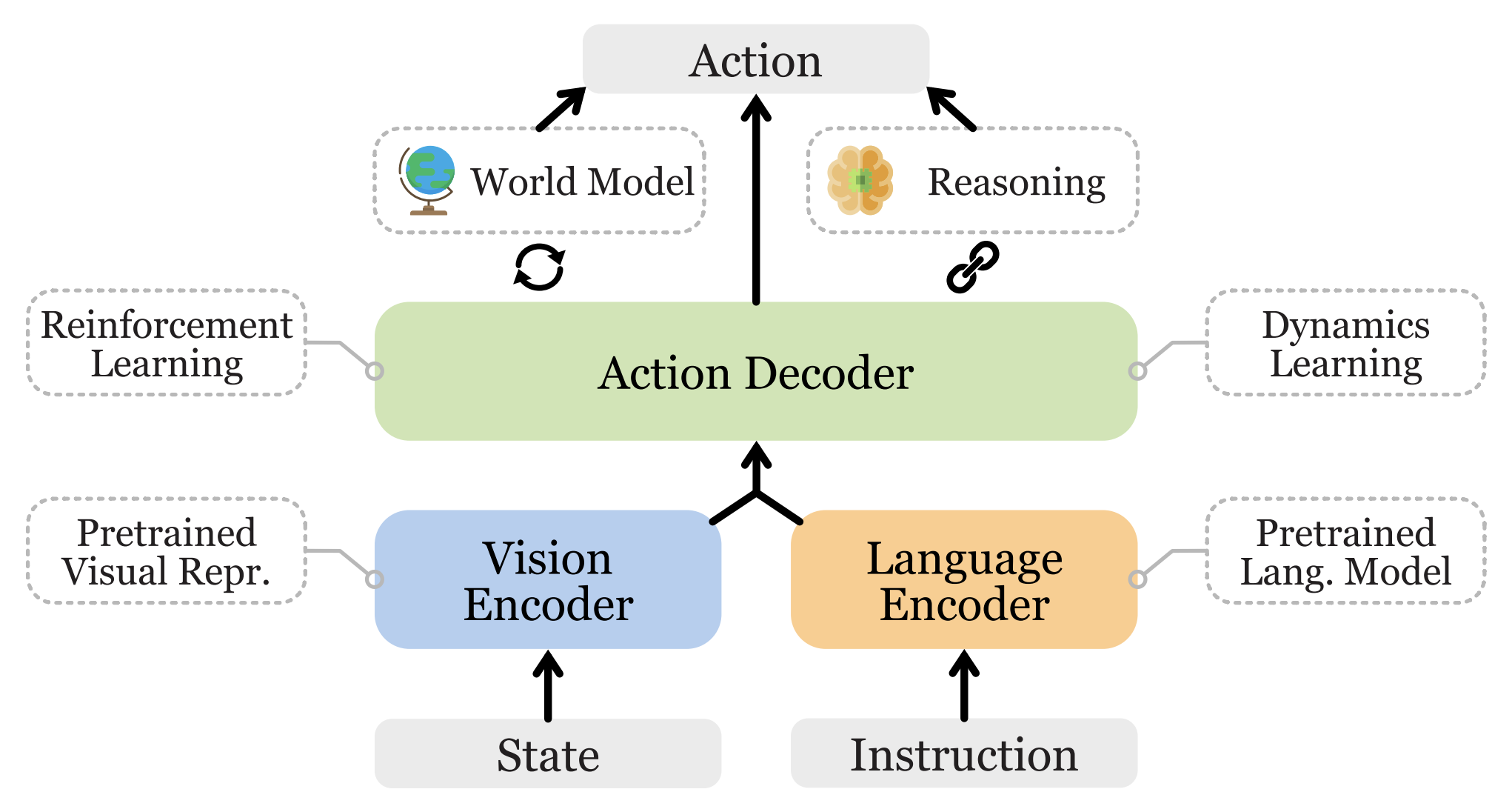

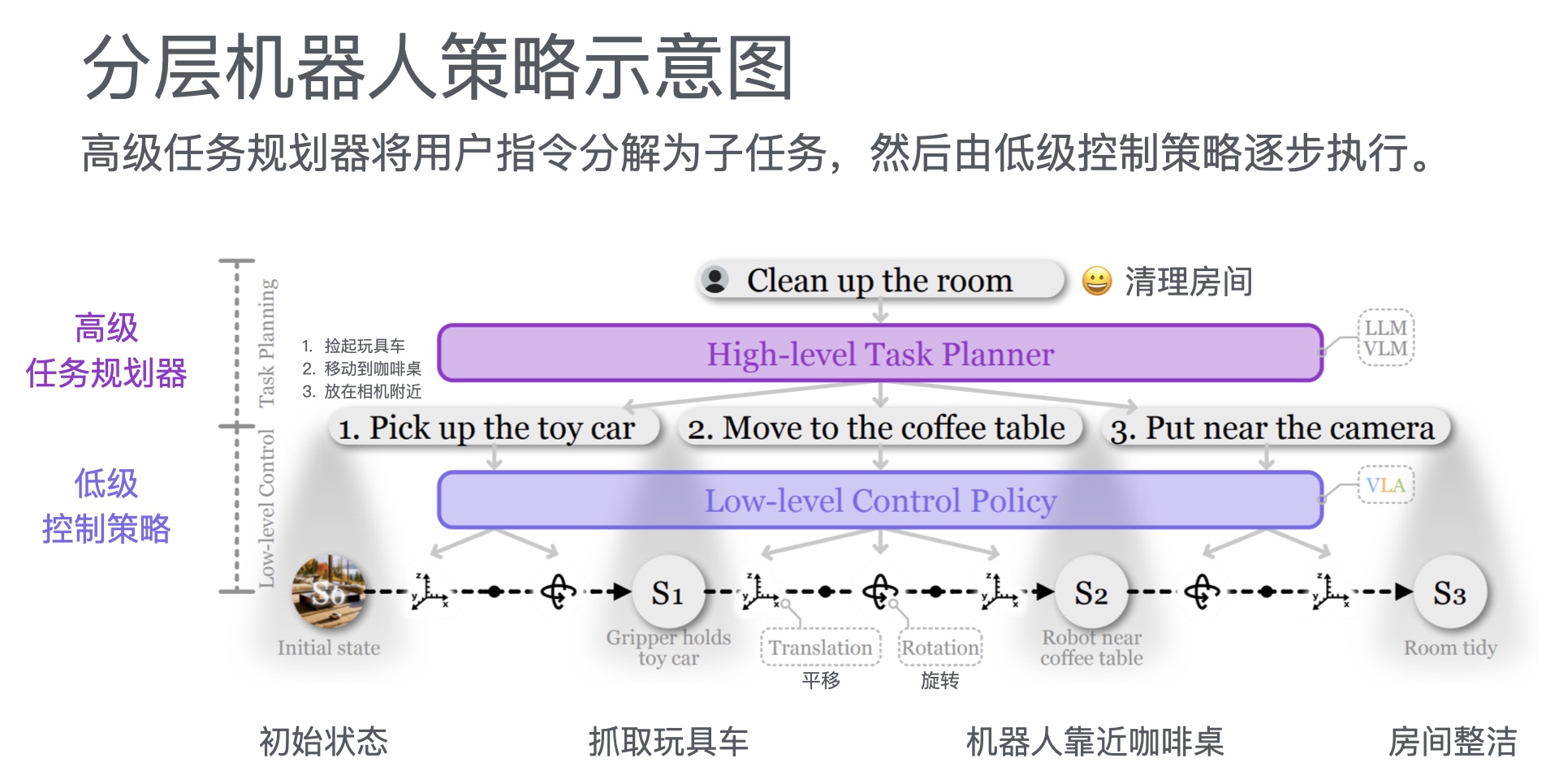

模型架构

VLA (Vision-Language-Action)

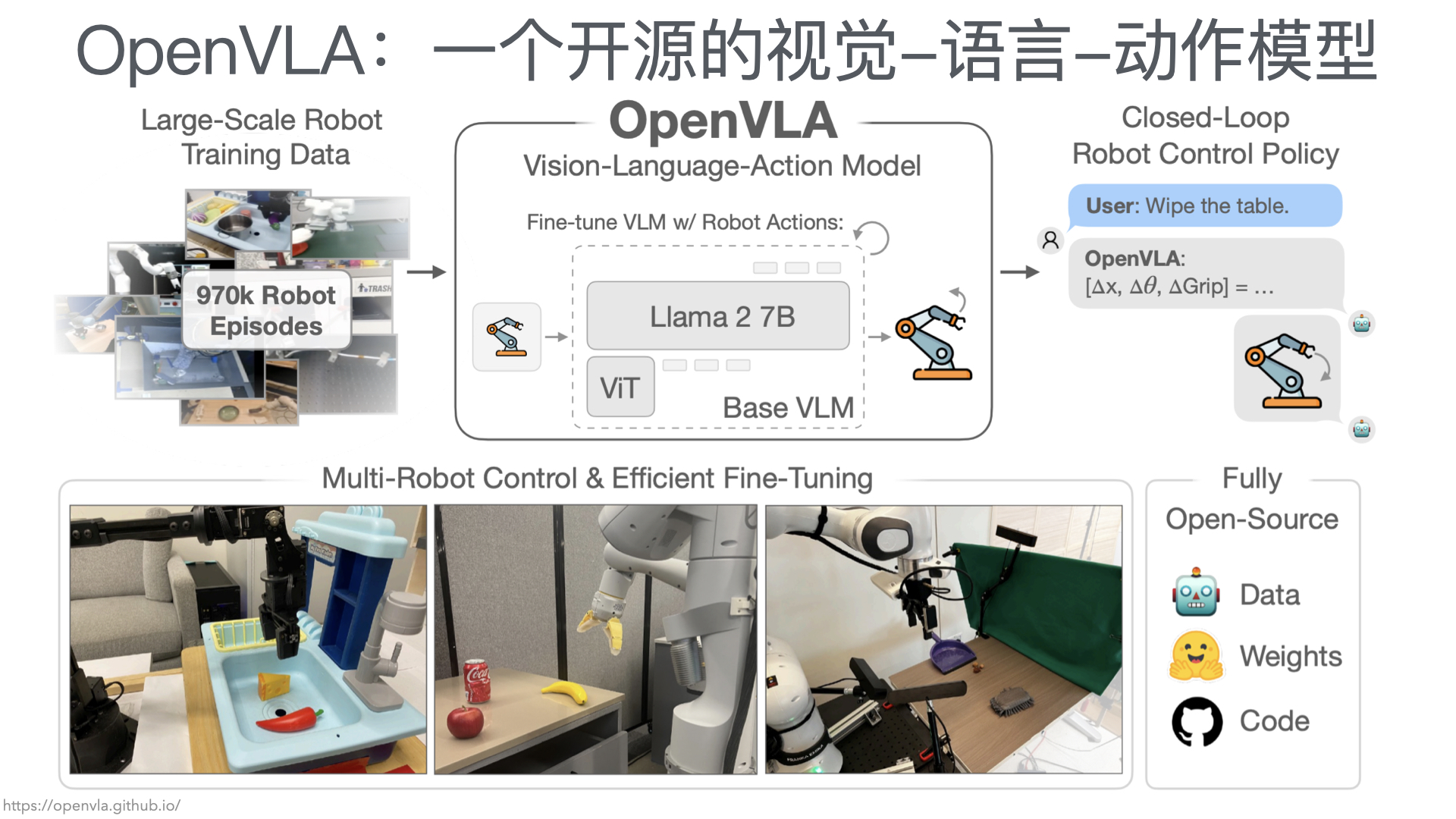

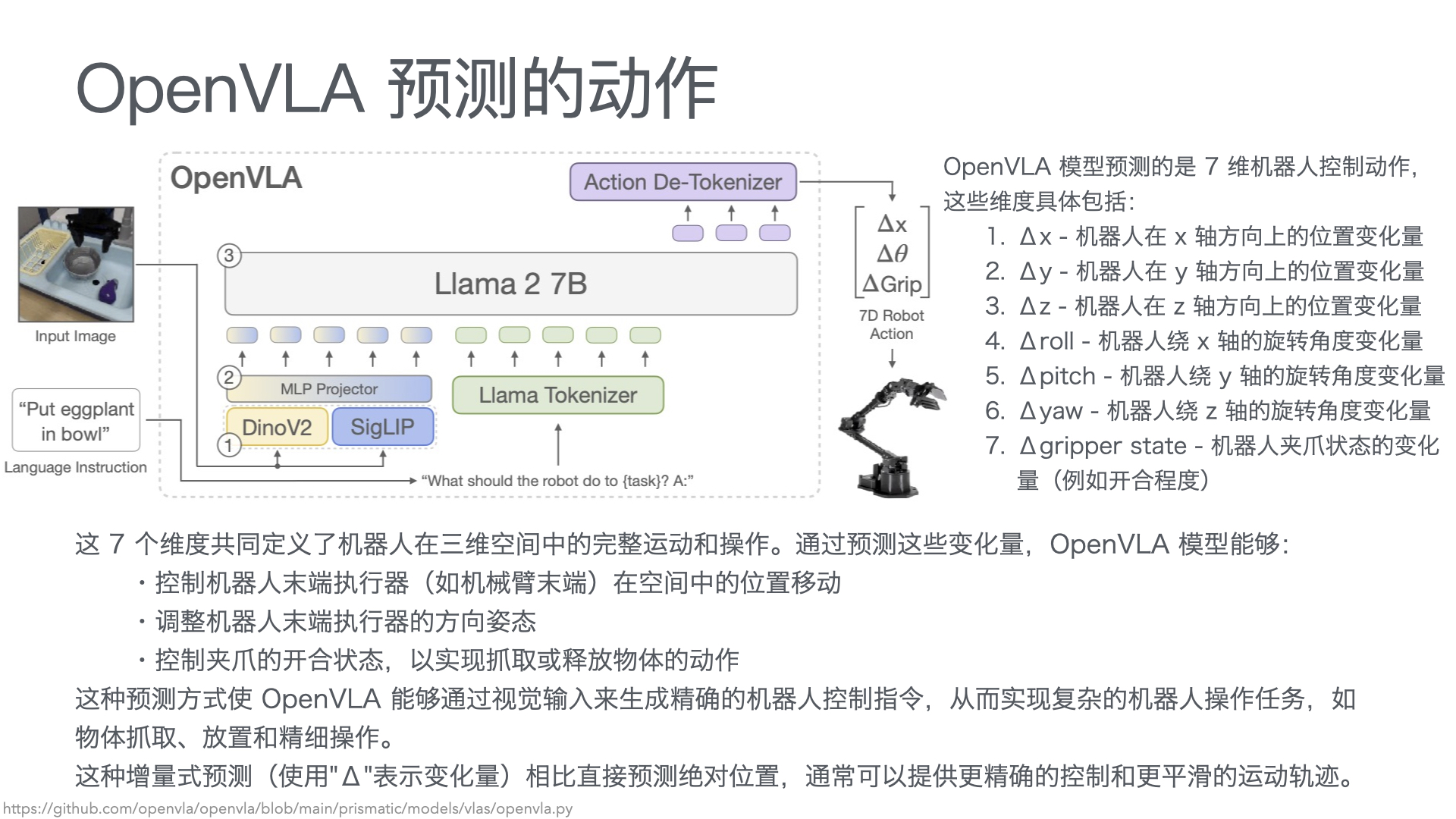

OpenVLA

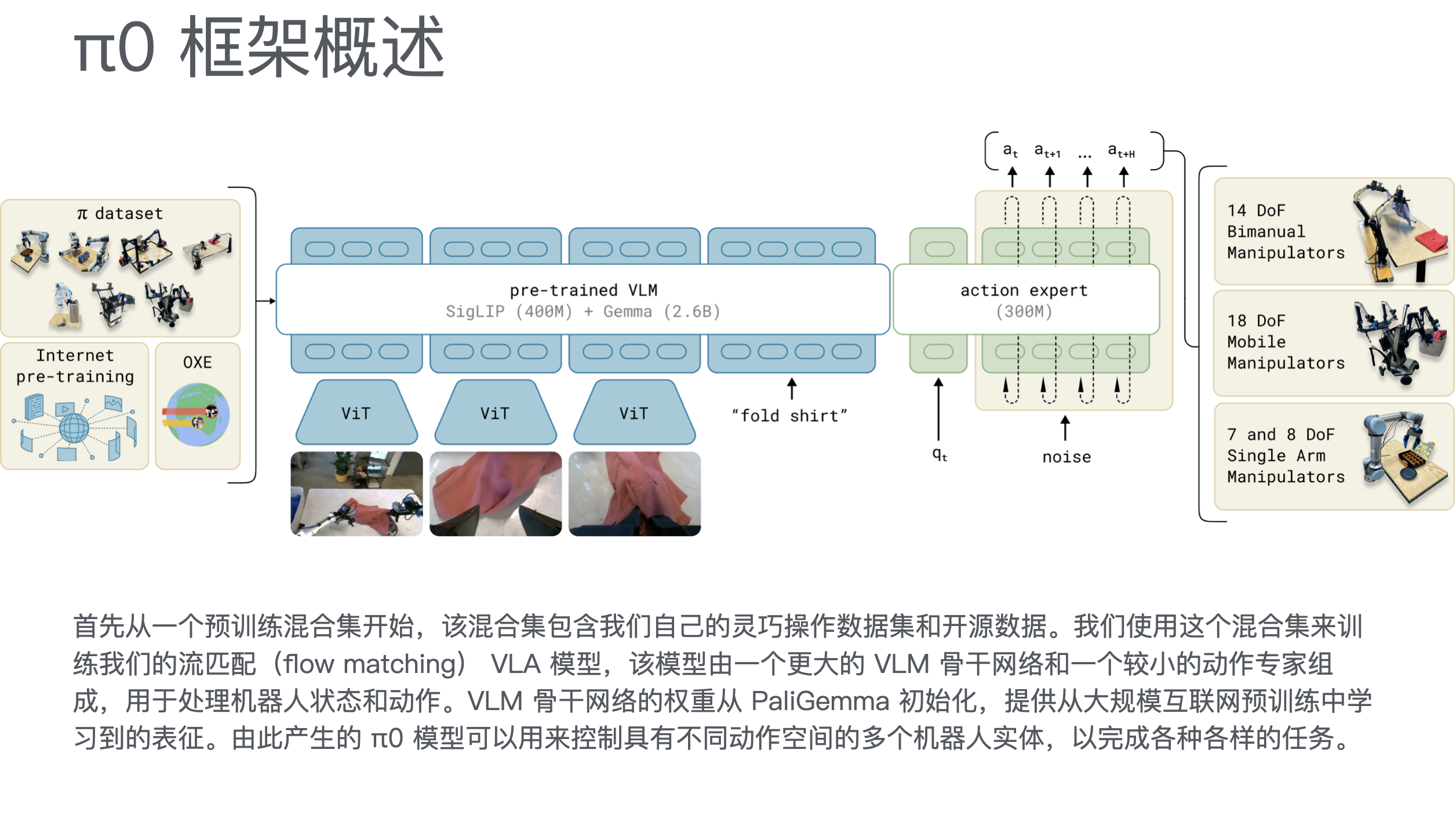

π0

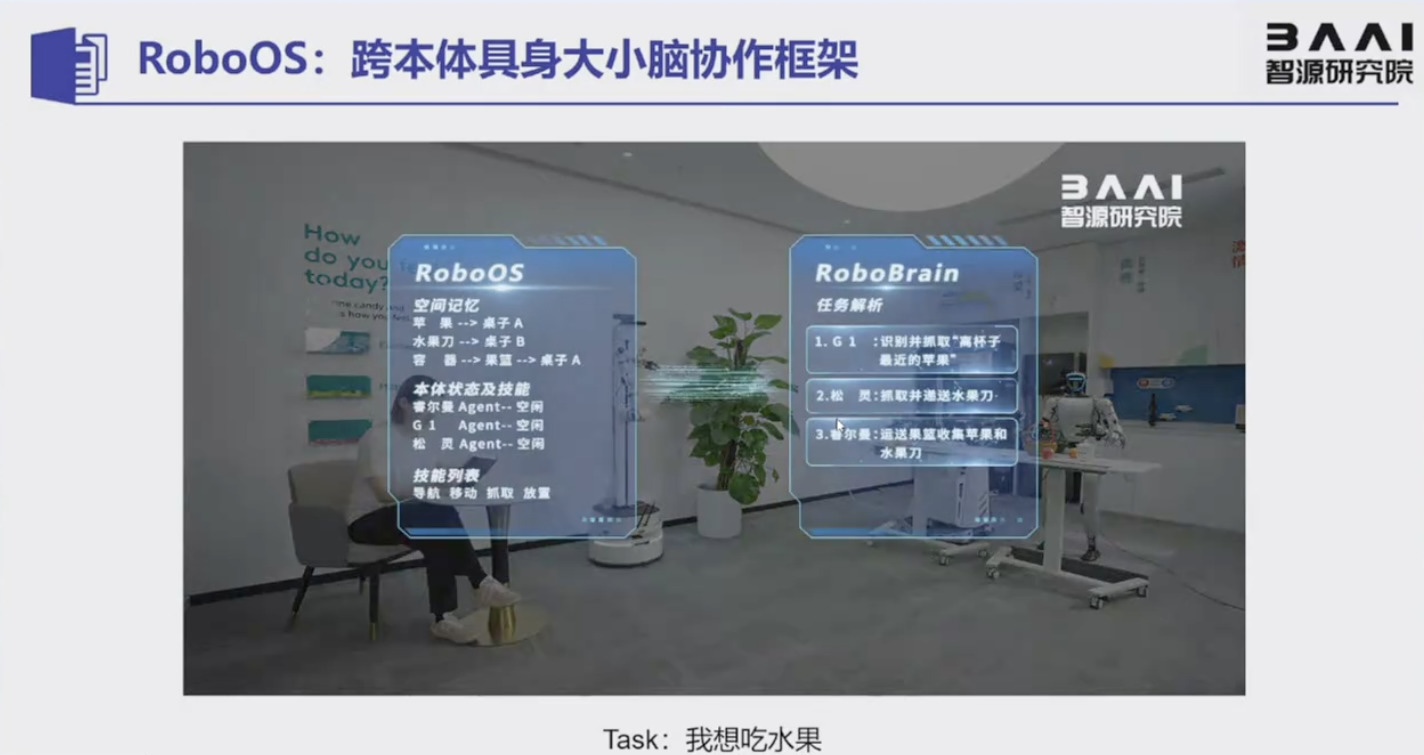

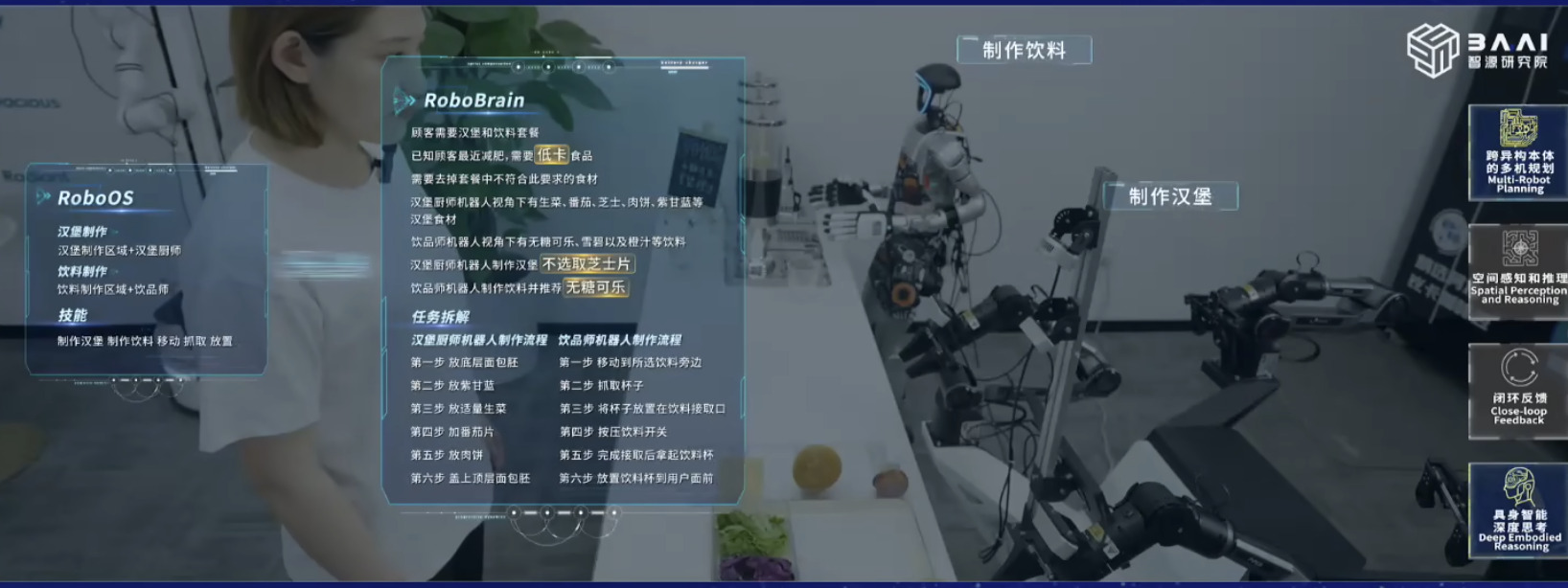

RoboOS & RoboBrain

智能体

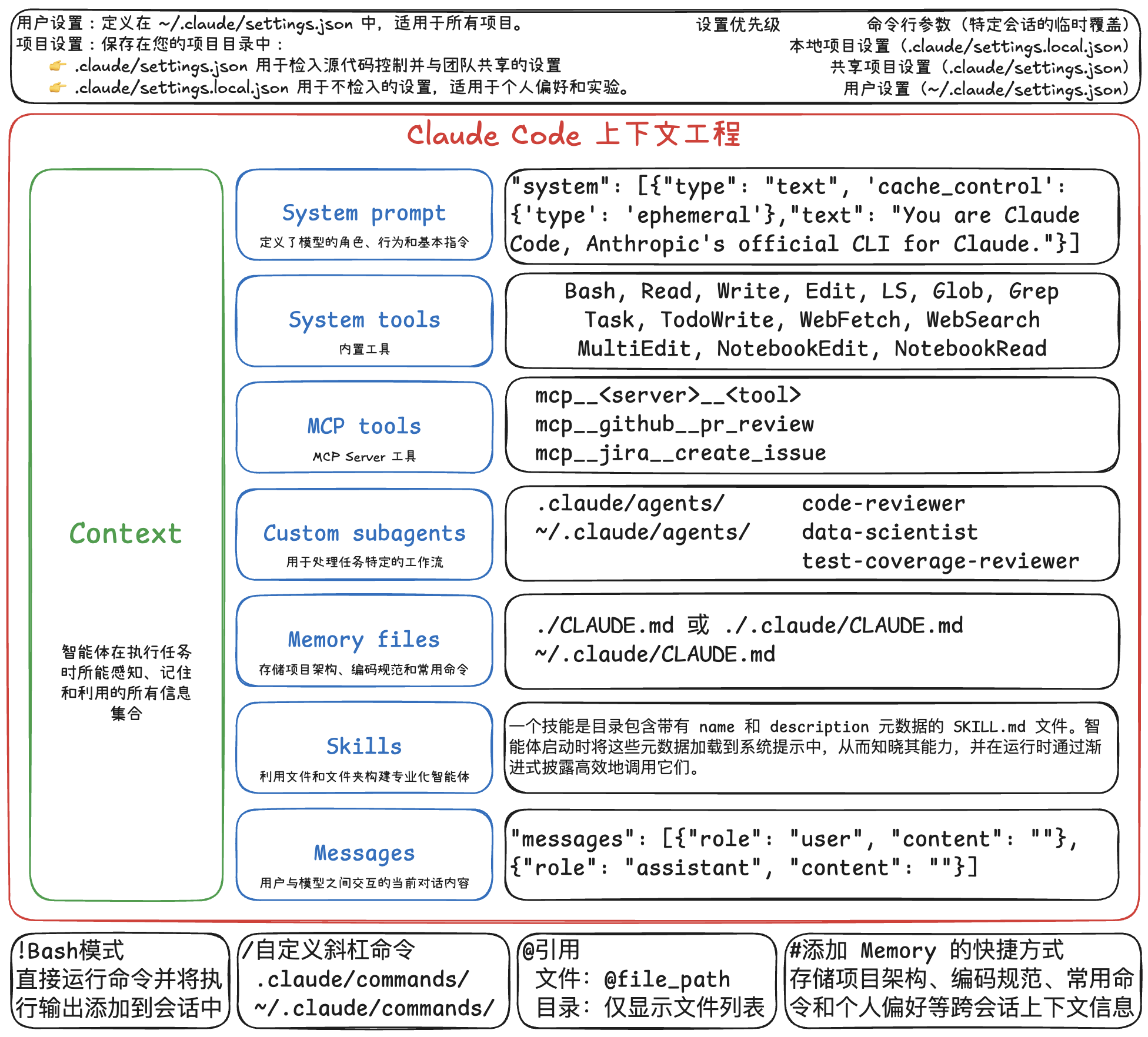

Claude Code 上下文工程

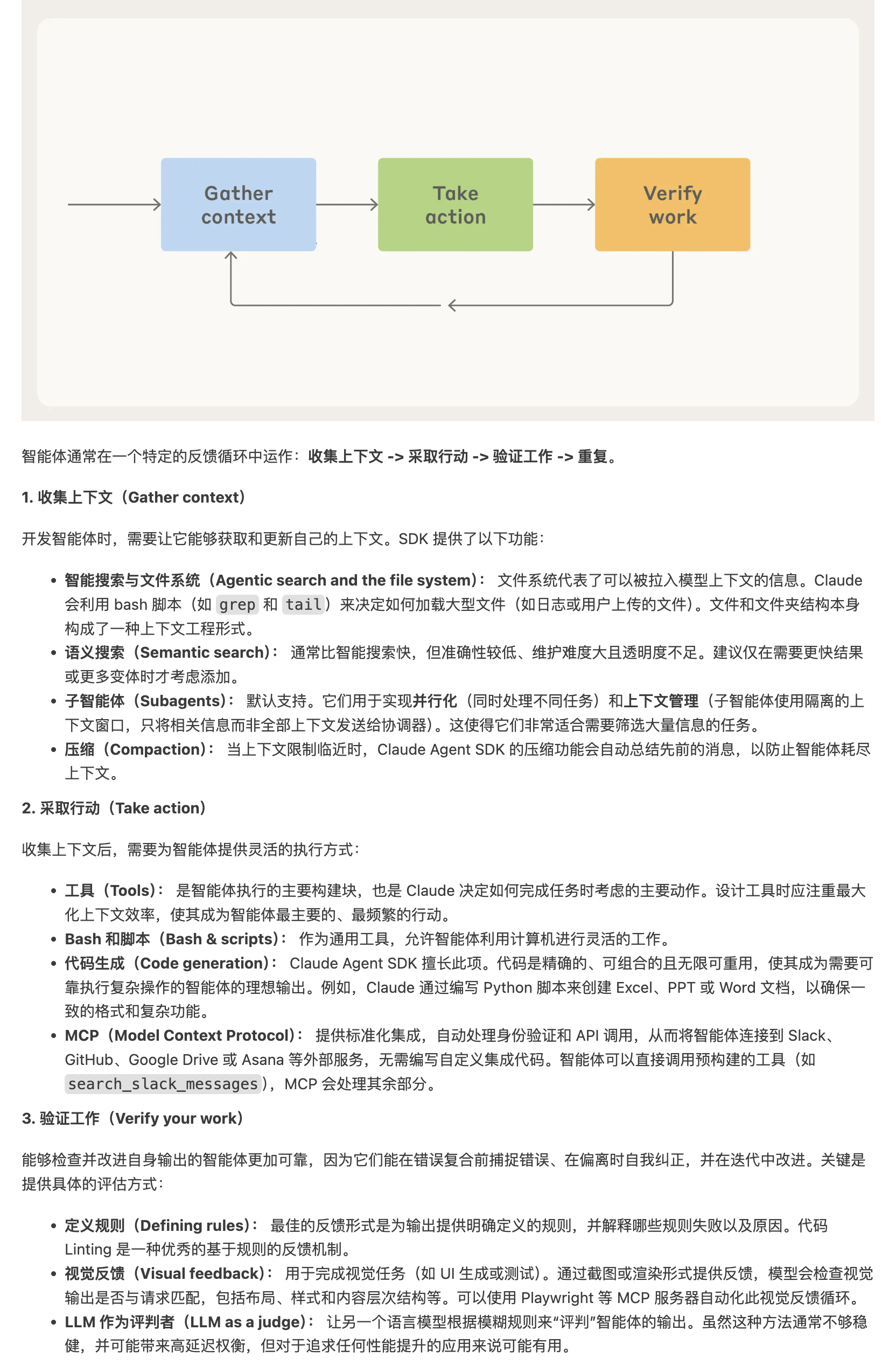

构建智能体循环

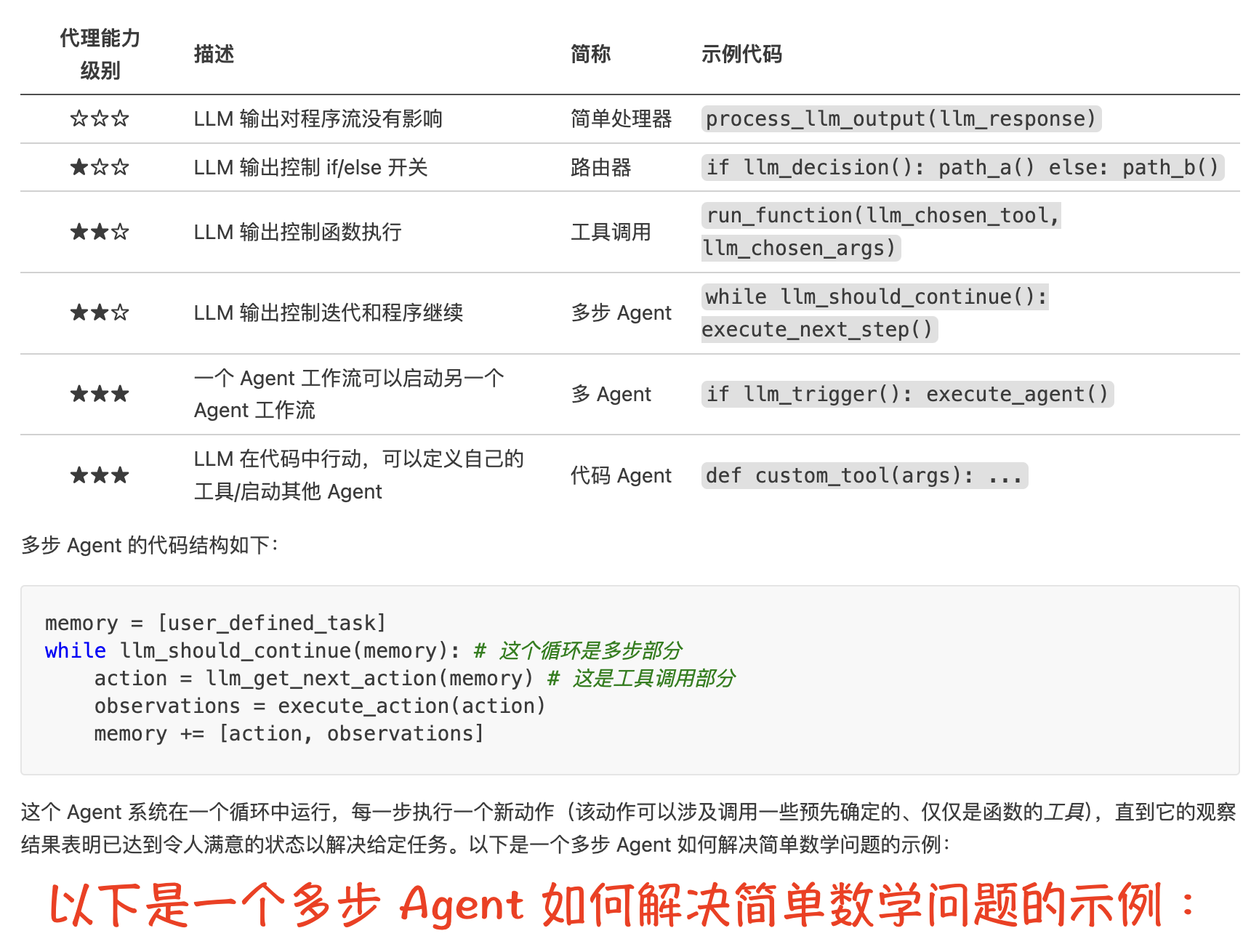

代理能力 (Agency Level)

任何利用大语言模型(LLM)的系统,都会将 LLM 的输出结果整合到实际运行的代码中。LLM 的输入(即 LLM 接收到的信息或指令)对整个代码执行流程的影响程度,就决定了 LLM 在这个系统中所拥有的“代理能力”水平。

简单来说:

- LLM 输出会融入代码:LLM 不仅仅是生成文本,它的输出会直接或间接地被程序使用,成为程序的一部分。

- LLM 的输入影响代码流程:LLM 根据其输入来决定做什么。如果这个决定能影响代码接下来怎么运行(比如是执行 A 任务还是 B 任务,是调用哪个工具,甚至是如何循环执行),那么 LLM 就具有了代理能力。

- 代理能力是个程度问题:这种影响越大,LLM 的代理能力就越强。

- 低代理能力:例如,LLM 只是生成一段文字供人参考。

- 高代理能力:如果它能决定调用哪个函数来解决问题,甚至能自己编写和执行代码。

这段话强调了 LLM 不再只是一个被动的信息处理工具,它可以通过其输出来主动影响和控制程序的行为,而这种“控制力”就是文档后续深入探讨的“代理能力”。

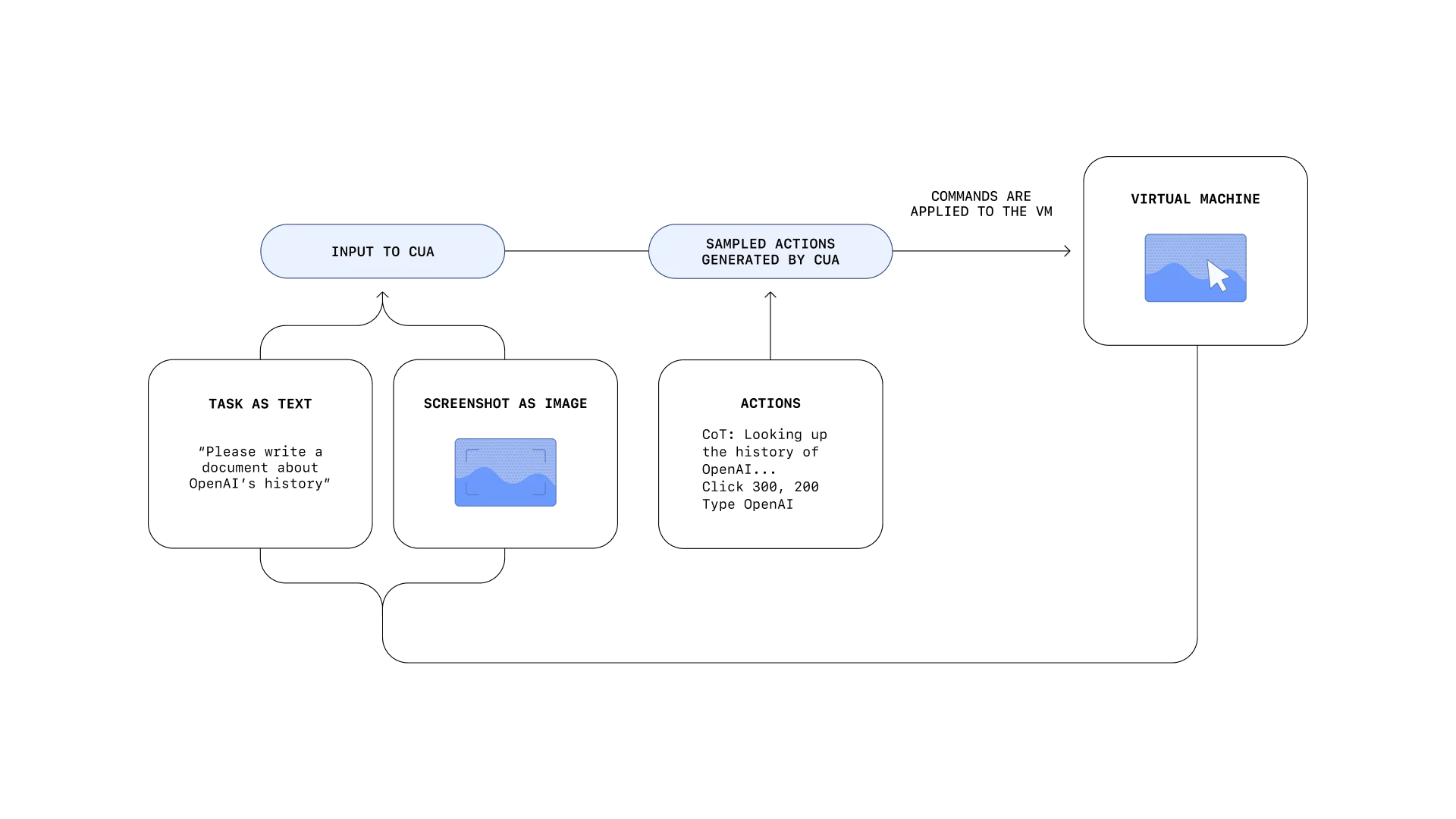

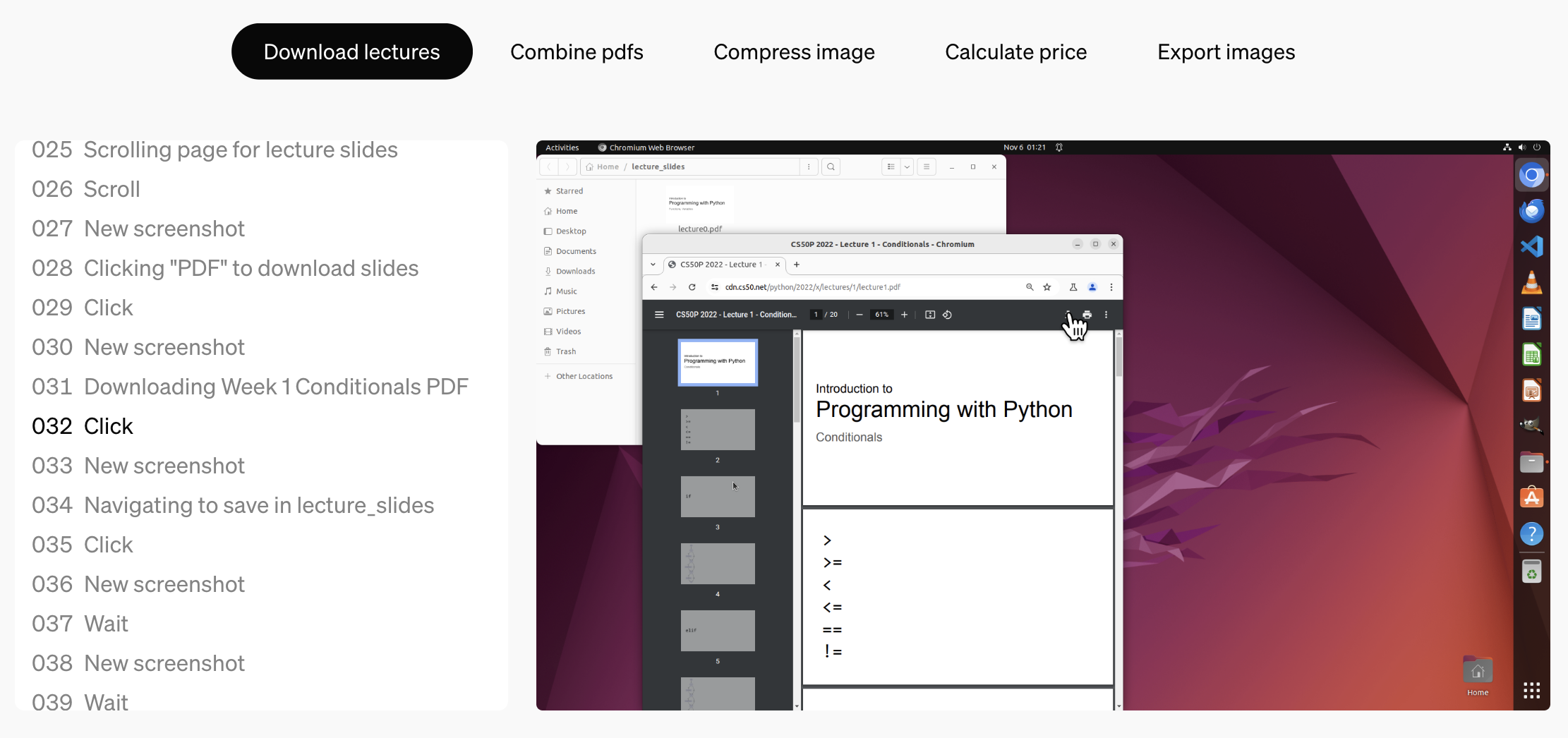

OpenAI CUA (Computer-Using Agent)

CUA 被训练为与图形用户界面(GUI)进行交互——这是人们在屏幕上看到的按钮、菜单和文本字段——就像人类一样。这使它能够执行数字任务,而无需使用特定于 OS 或 Web 的 API。

字节 UI-TARS

UI-TARS 是一种原生的GUI智能体模型,仅通过感知截图作为输入并执行类似人类的交互(例如键盘和鼠标操作)。

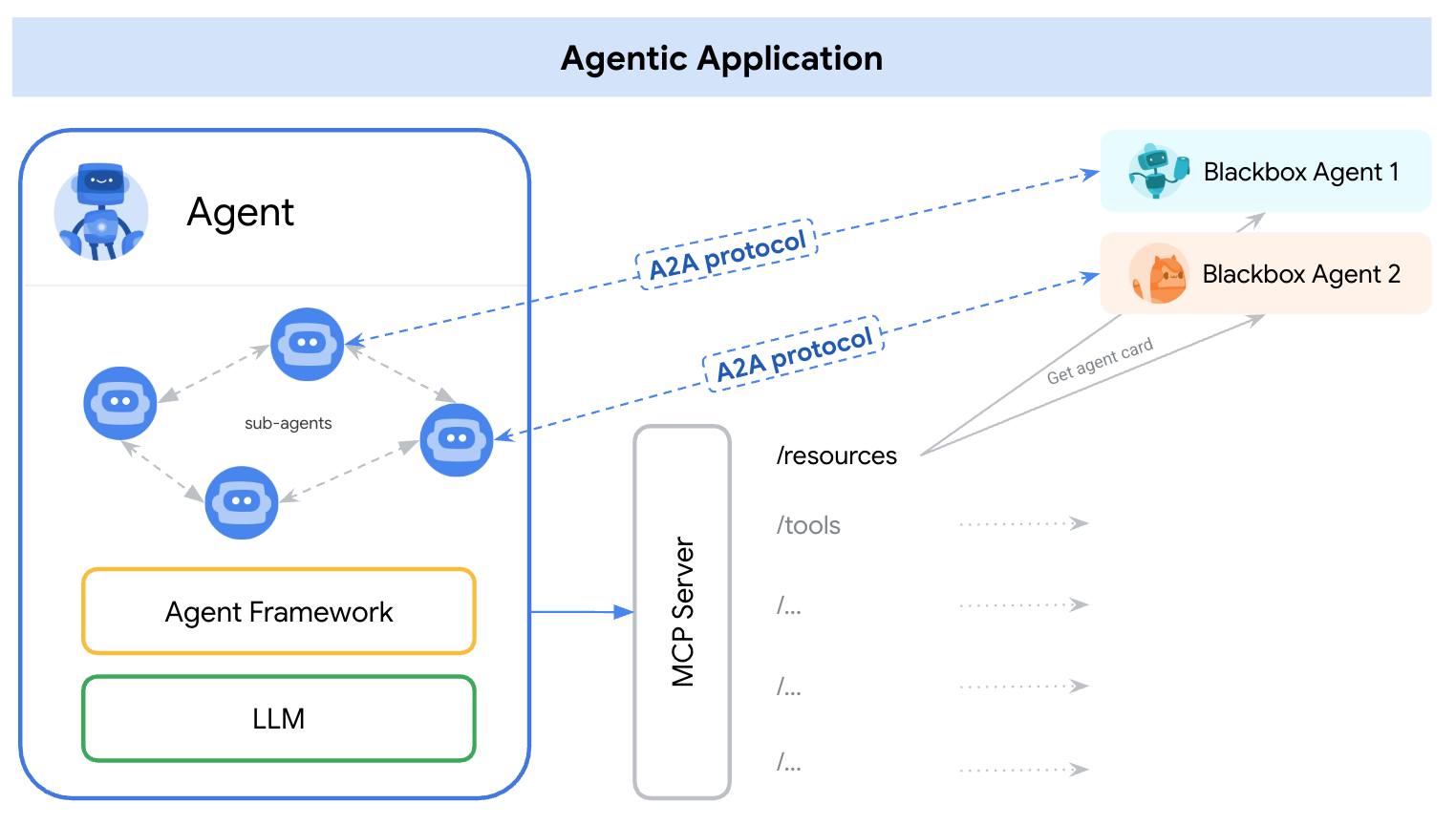

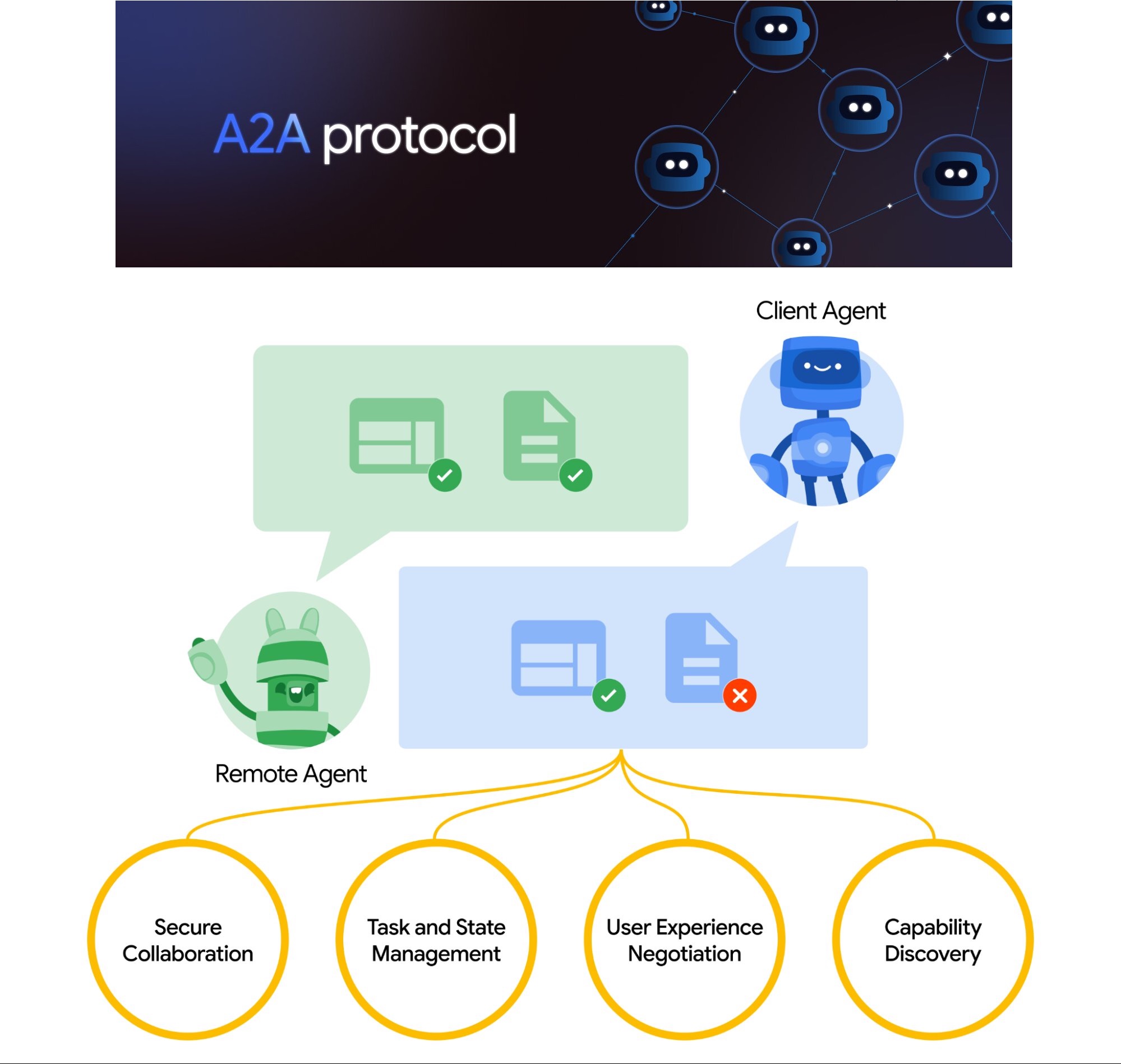

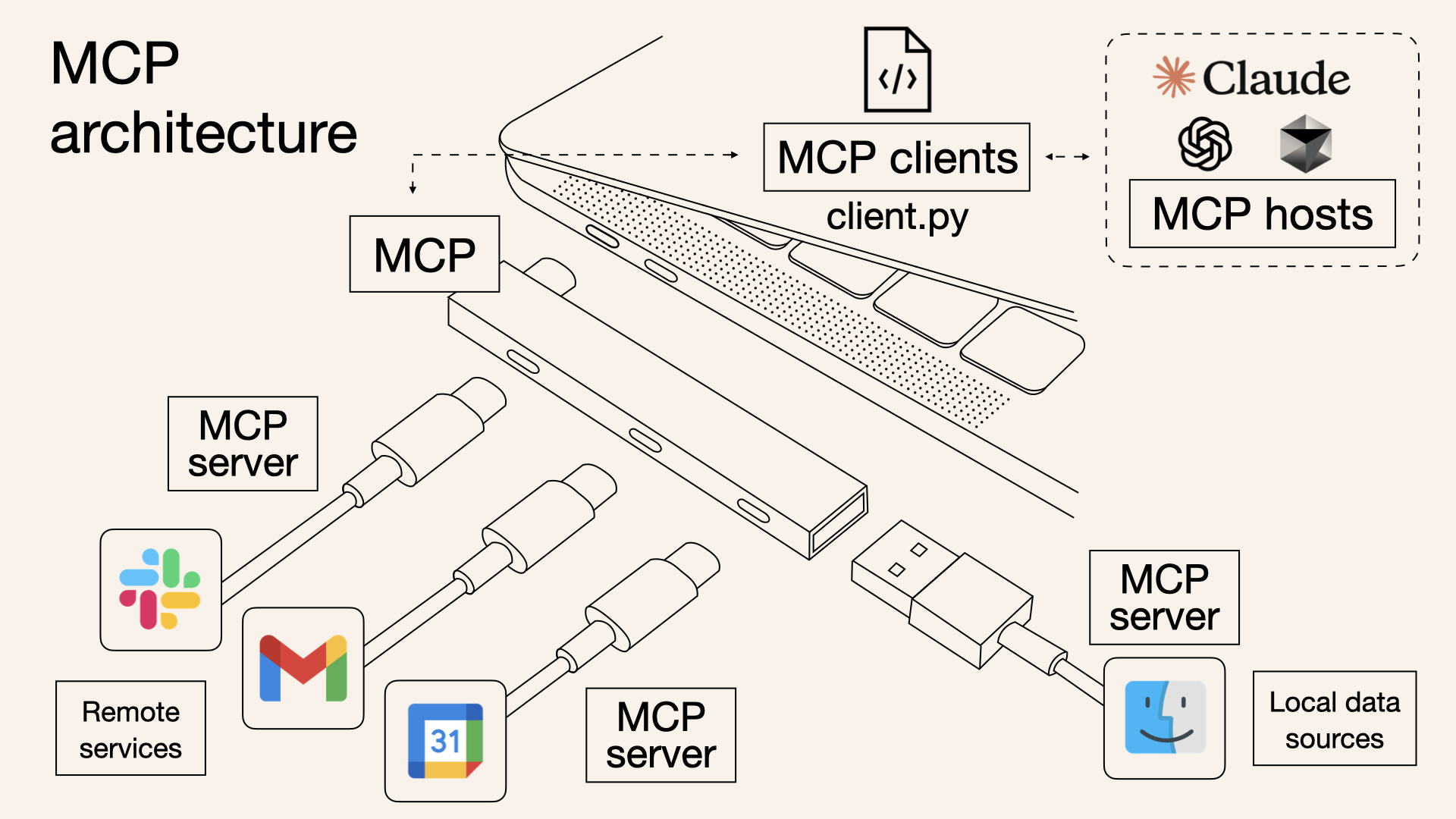

A2A & MCP

氛围编程(Vibe Coding)

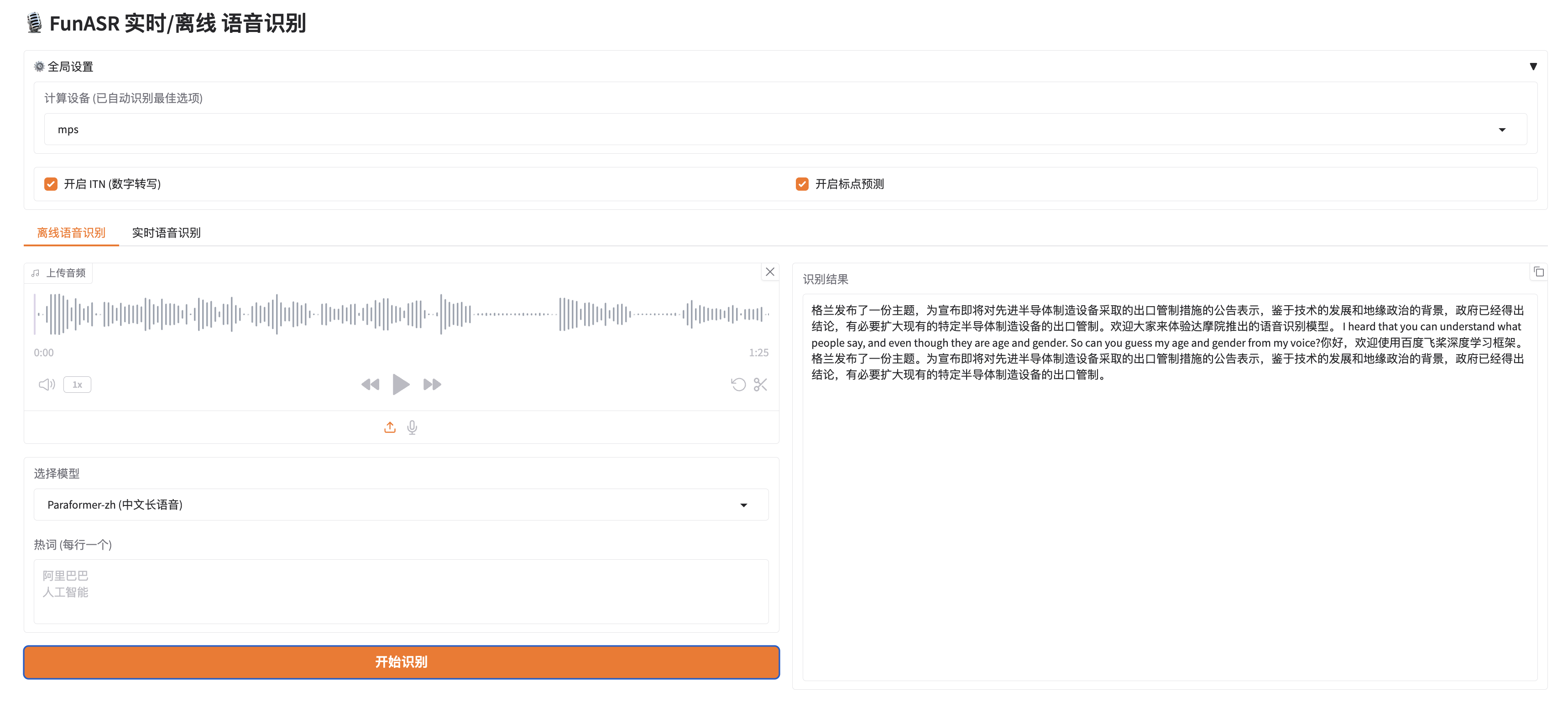

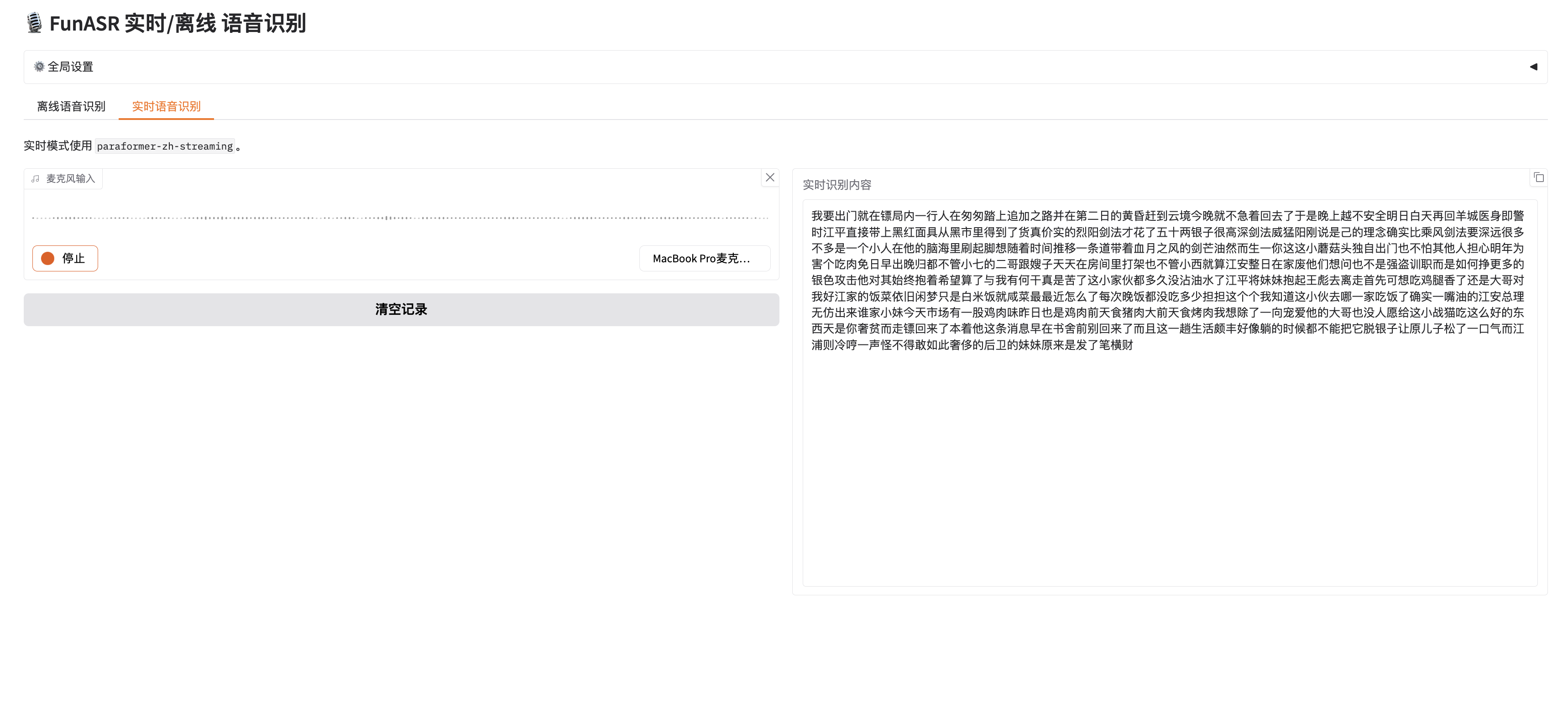

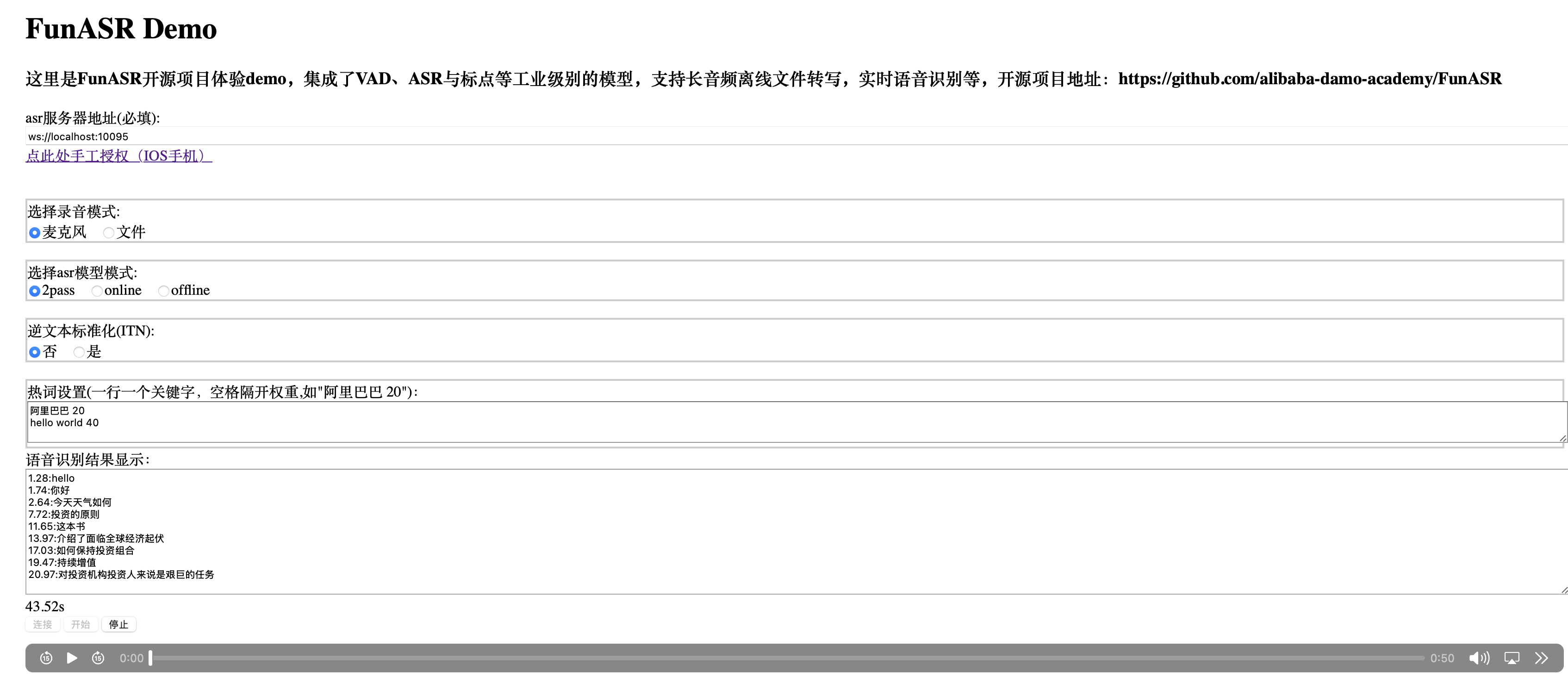

FunASR 实时/离线 语音识别

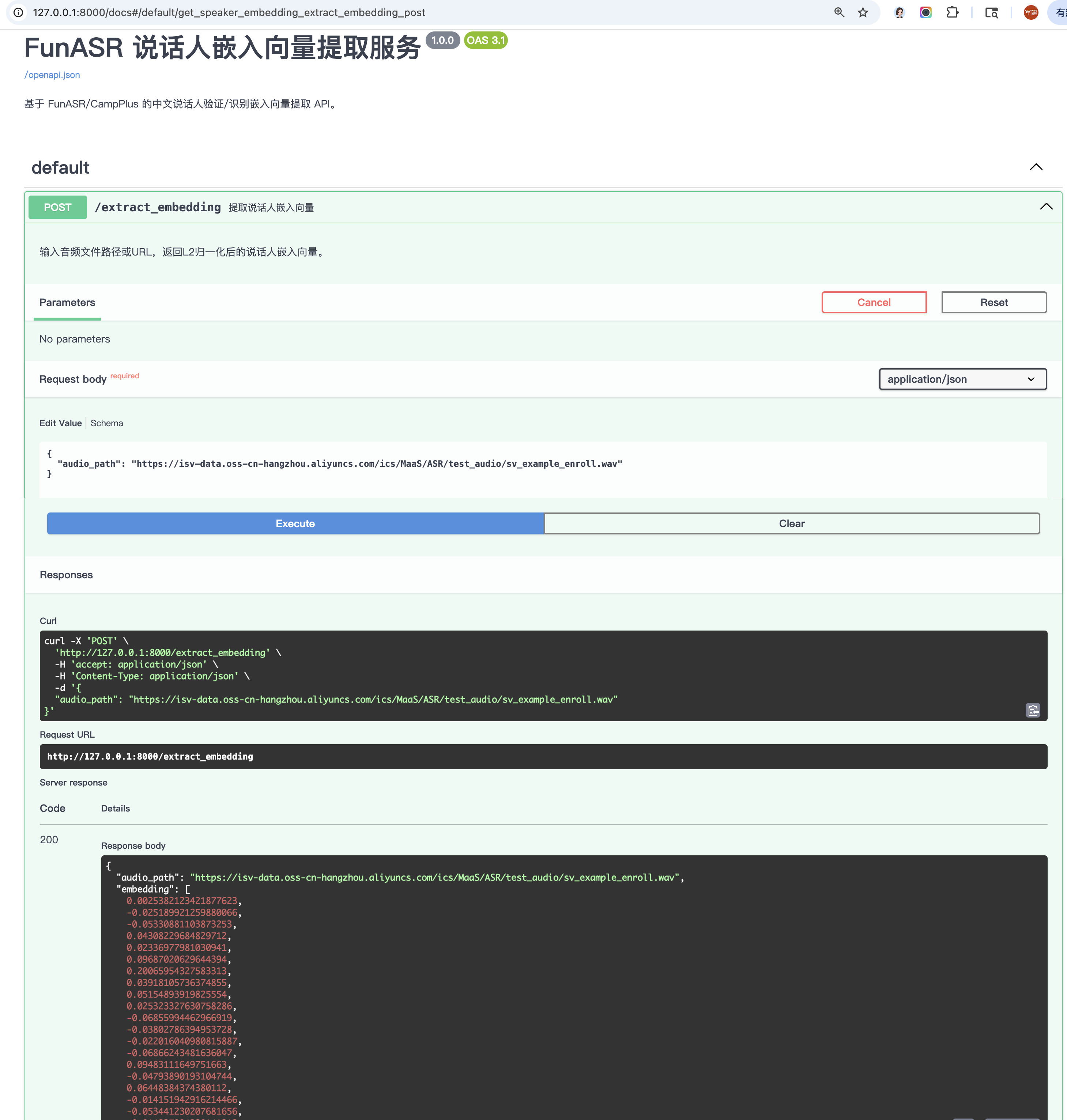

FunASR 说活人嵌入向量提取服务

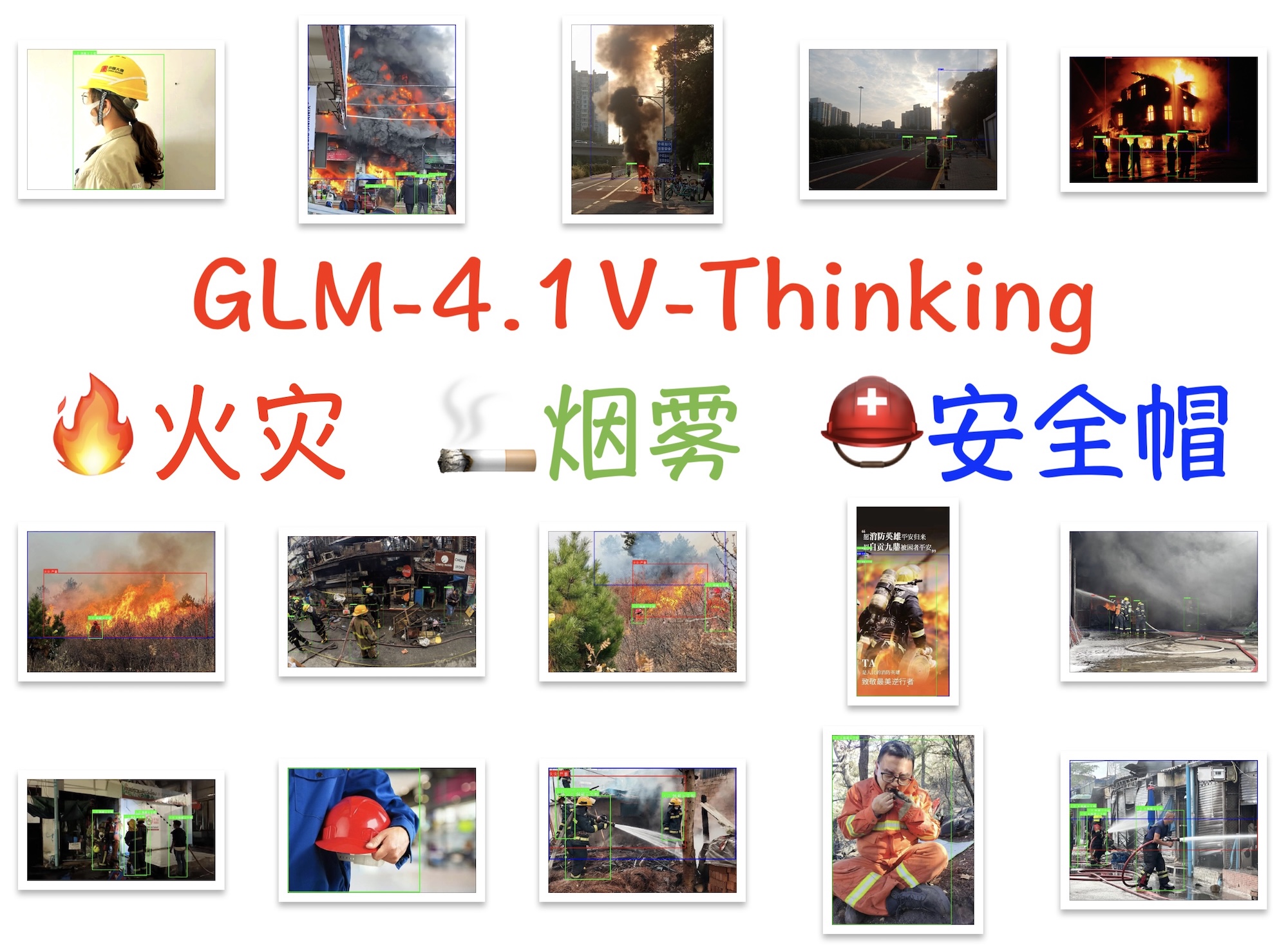

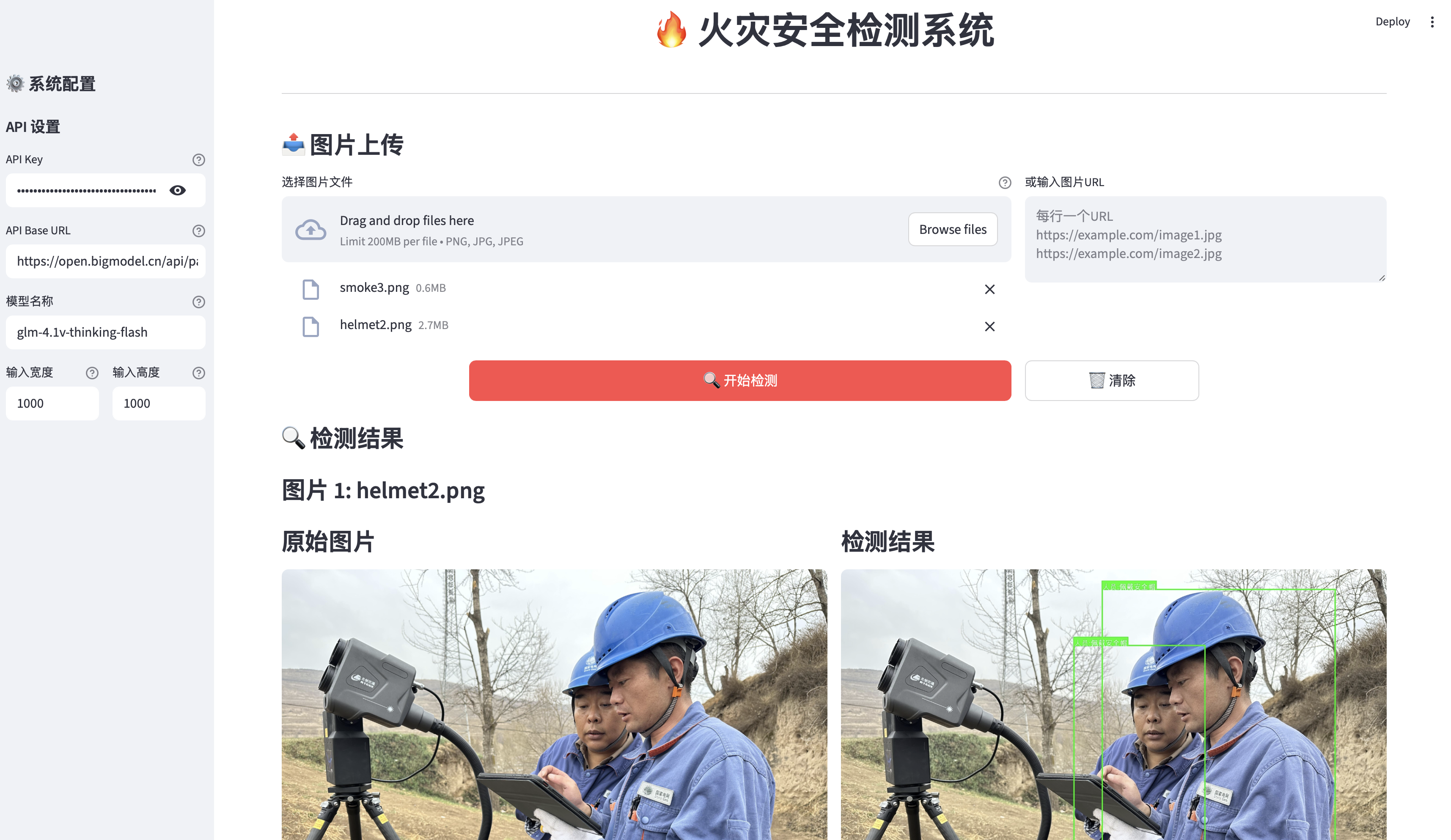

火灾安全检测系统

WallE 人工智能助手

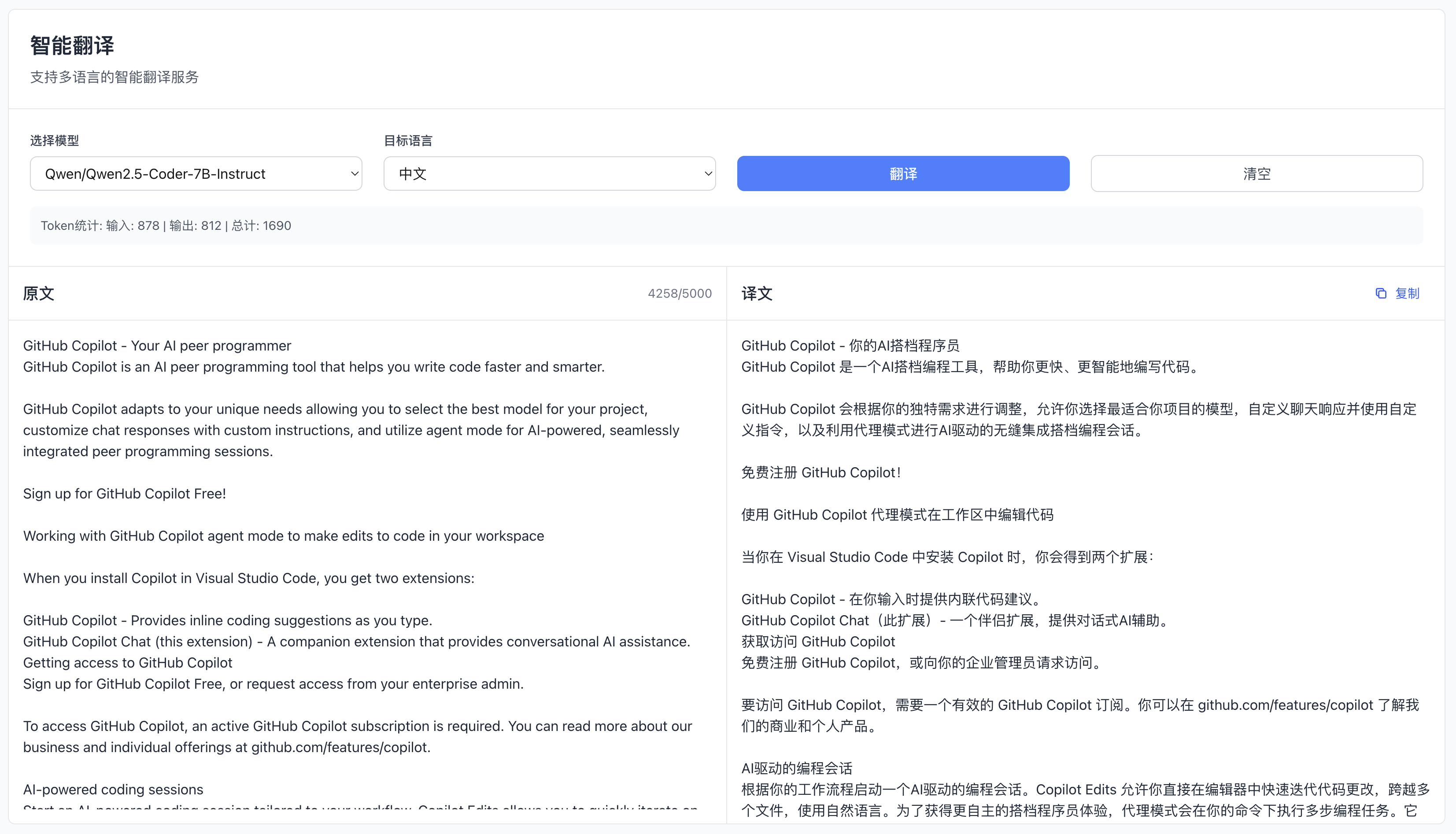

智能翻译

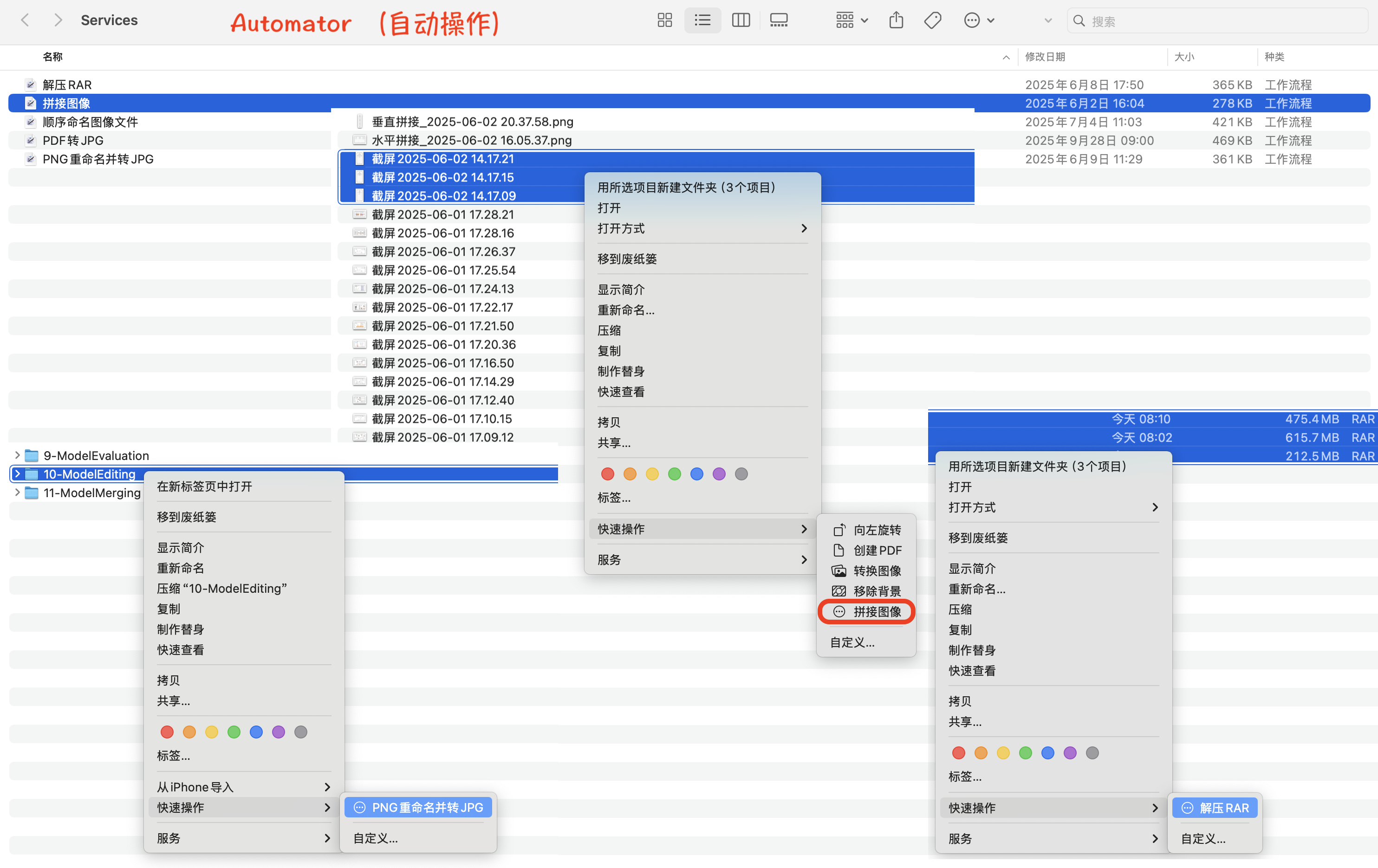

Automator(自动操作)

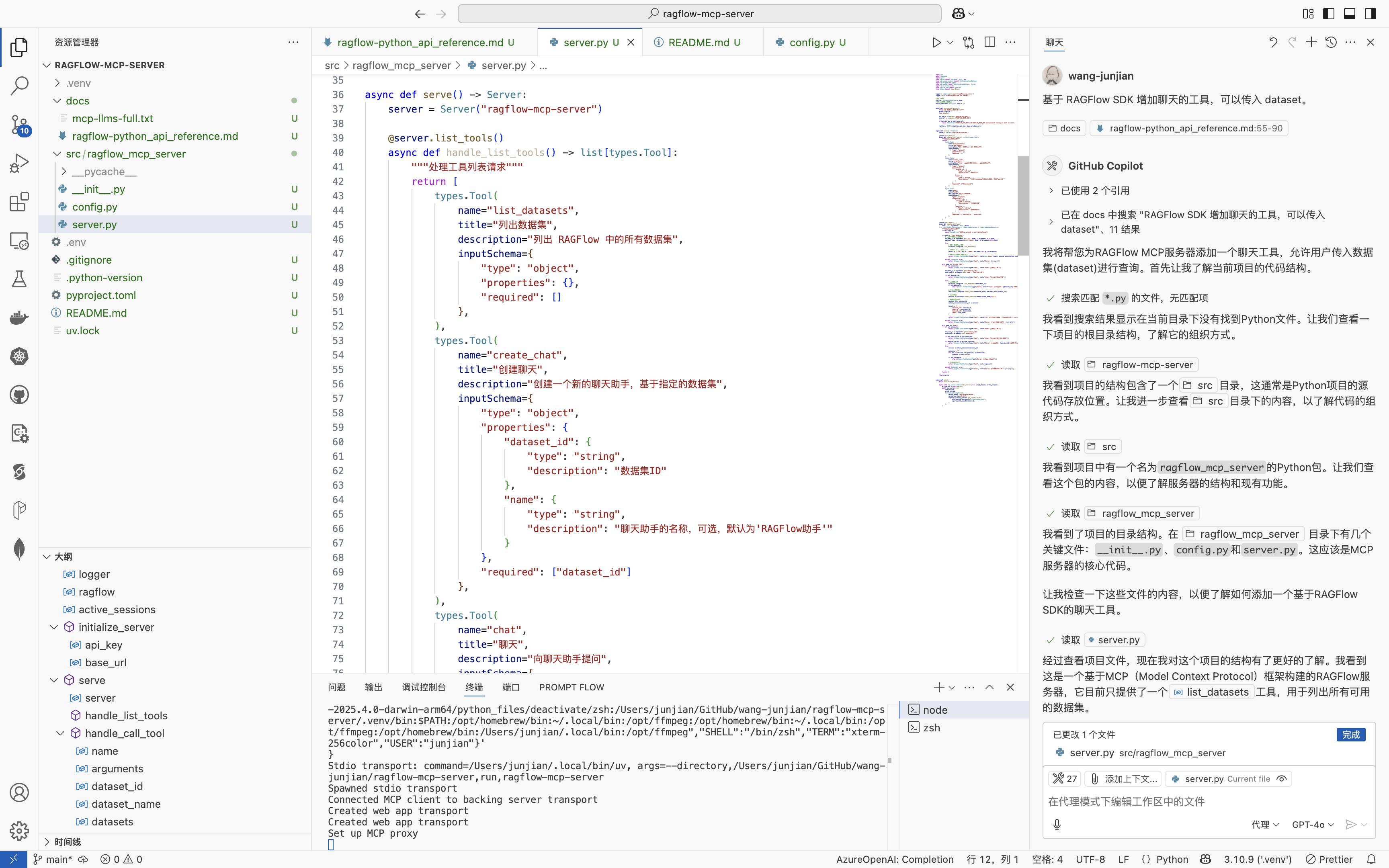

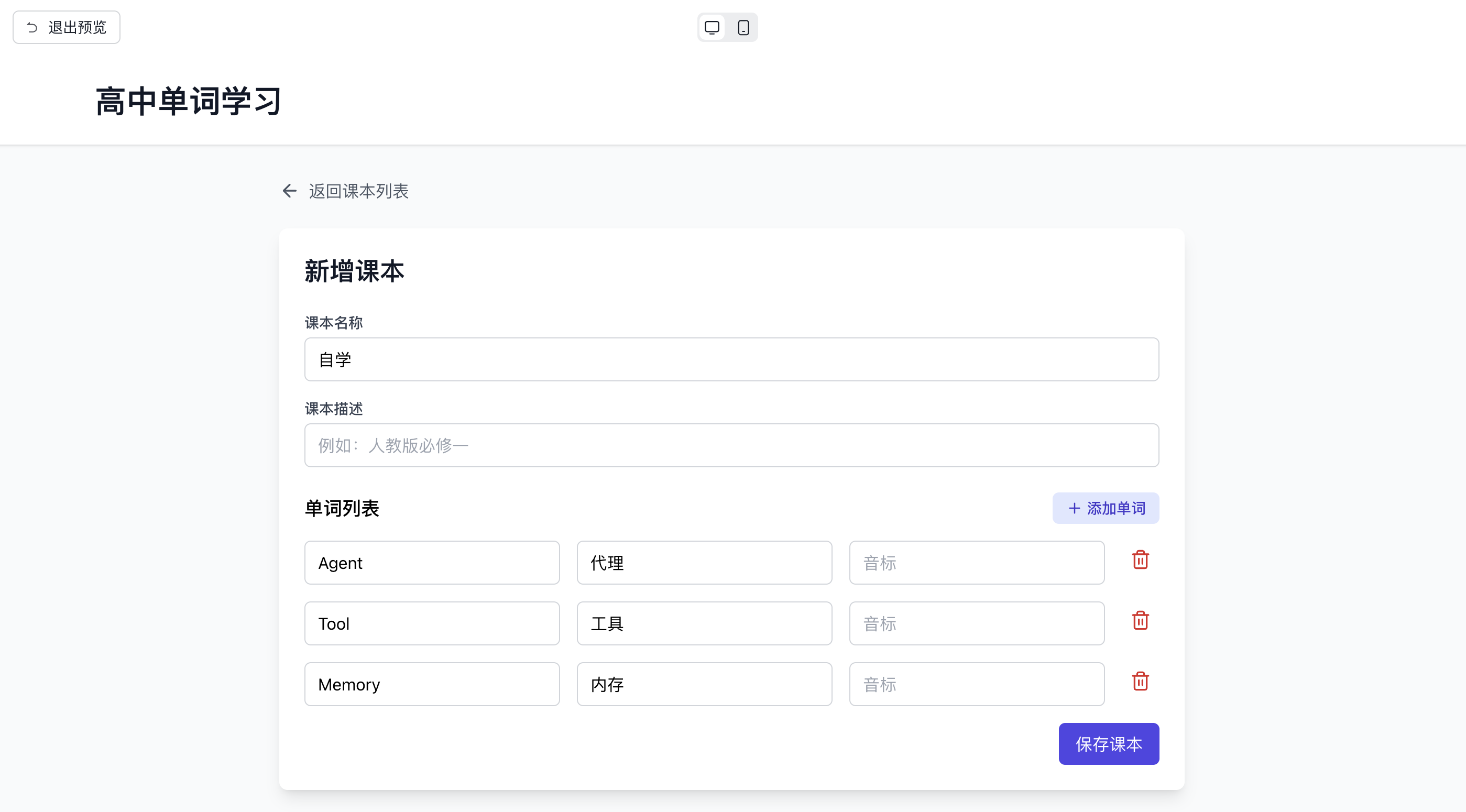

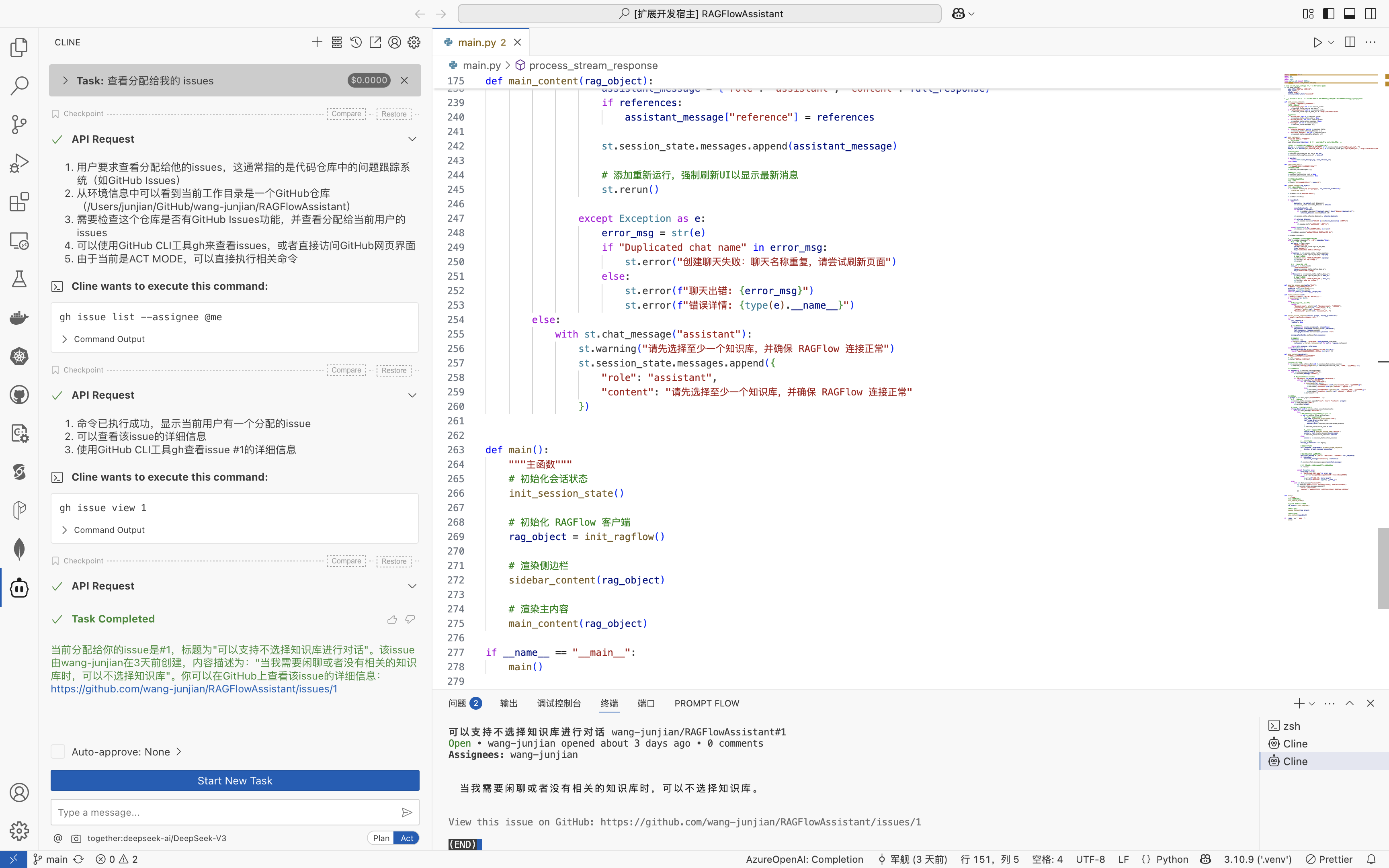

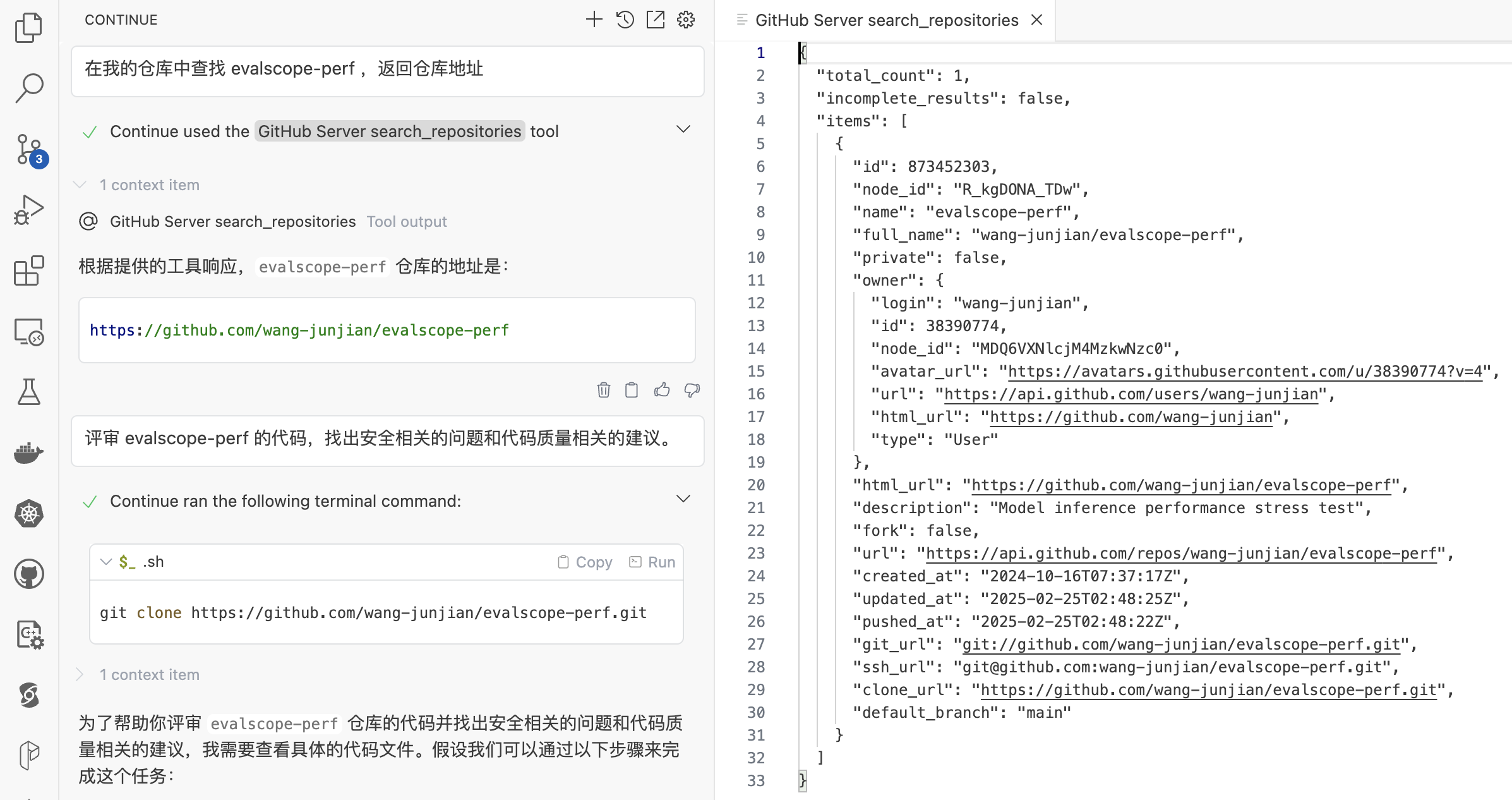

RAGFlow MCP Server

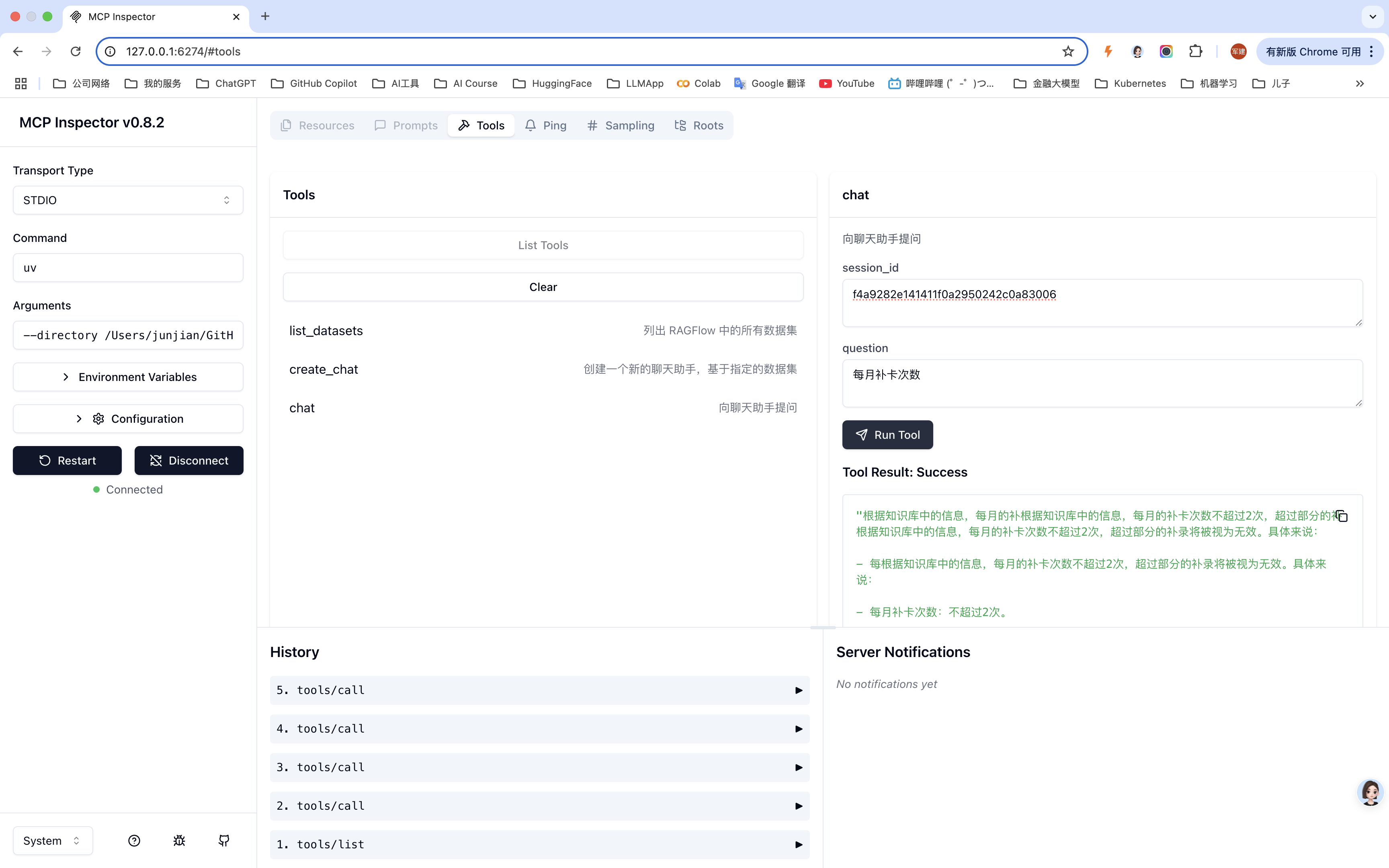

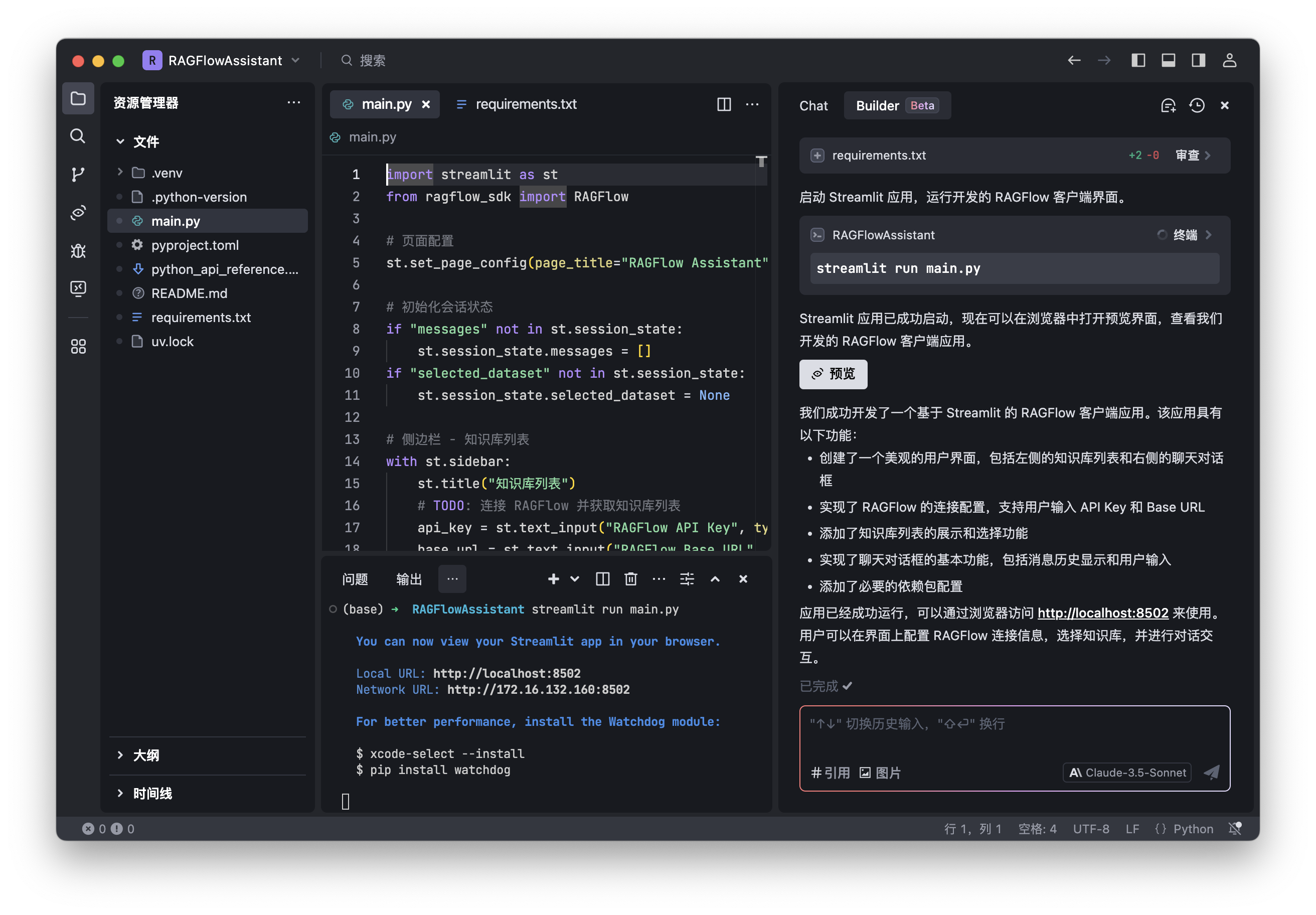

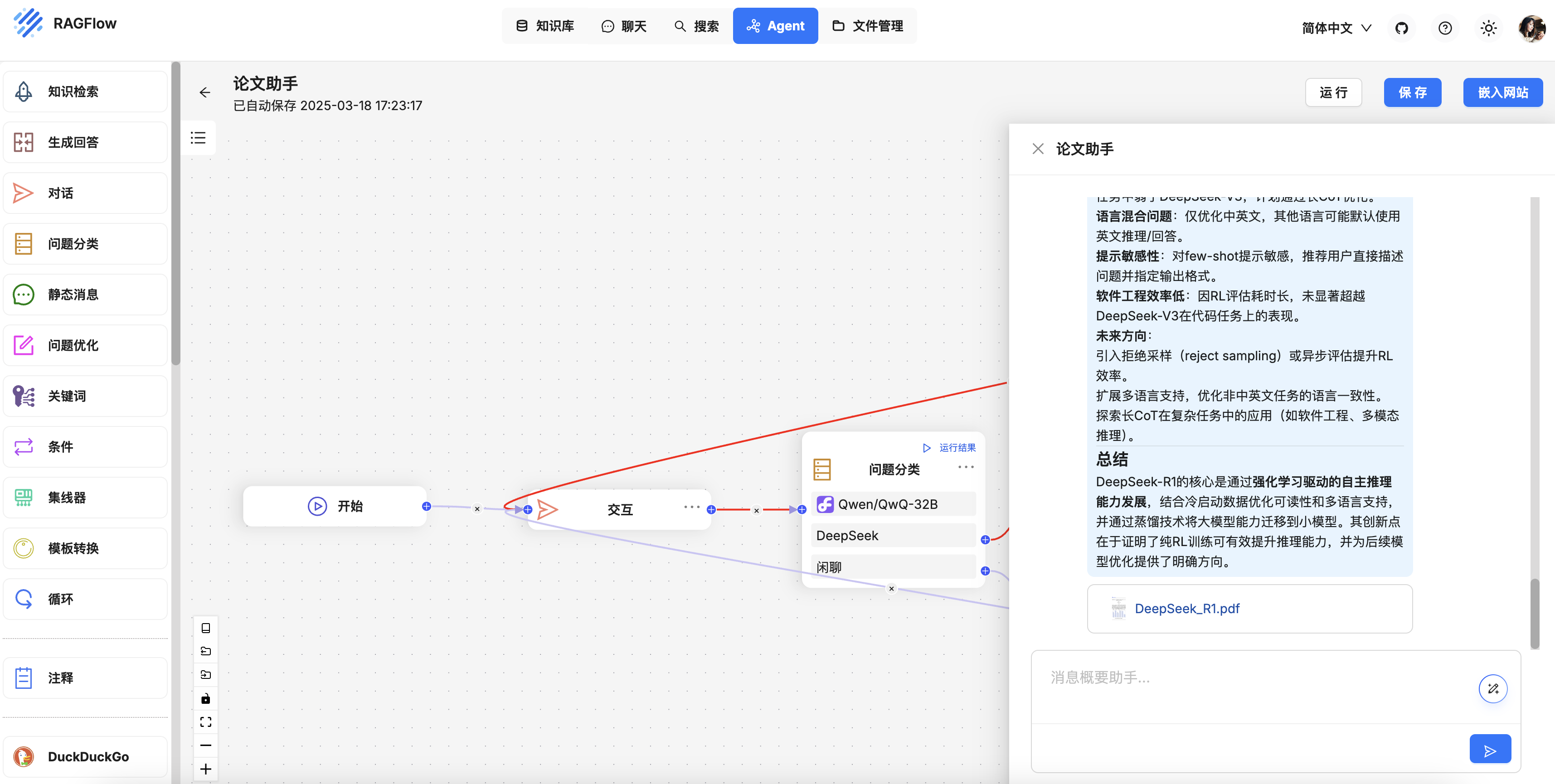

RAGFlow 聊天助手

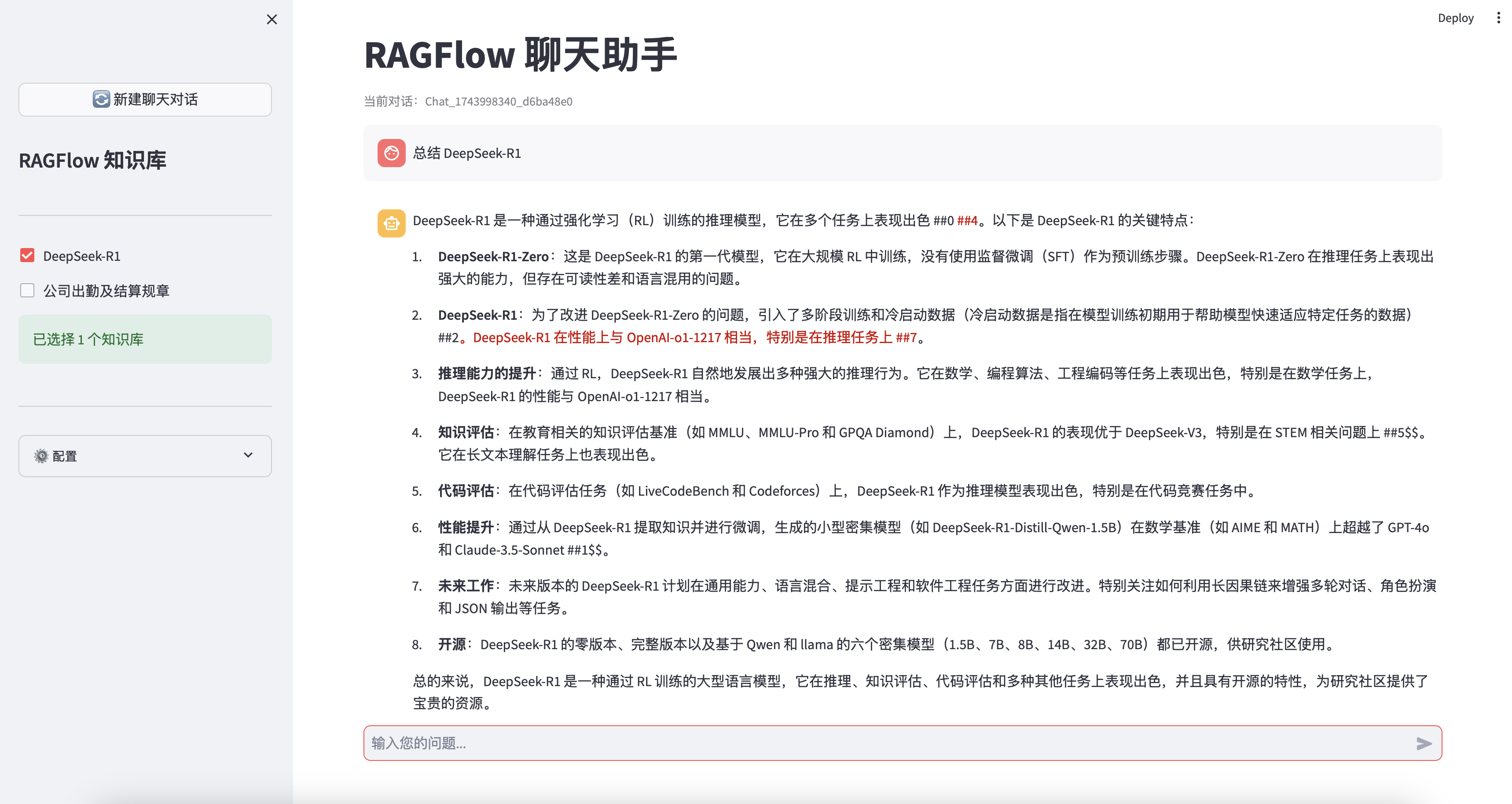

高中单词学习

AI 实践

京东健康核心数据成长 (2020年 - 2025年H1)

| 时间 | 年度活跃用户数 | 非国际财务报告准则盈利 (亿) | 标准盈利 (亿) | 商品收入 (亿) | 服务收入 (亿) | 第三方商户数量 | 日均在线问诊量 |

|---|---|---|---|---|---|---|---|

| 2020年 | 8,980万 | 7.49 | -172.35 | 168 | 26 | > 1.2万 | > 10万 |

| 2021年 | 1.233亿 (↑ 37.3%) |

14.02 (↑ 87.2%) |

-10.73 (亏损收窄) |

262 (↑ 56.1%) |

45 (↑ 72.7%) |

> 1.8万 | > 19万 |

| 2022年 | 1.543亿 (↑ 25.1%) |

26.16 (↑ 86.6%) |

3.83 (扭亏为盈) |

404 (↑ 54.2%) |

64 (↑ 41.4%) |

> 2万 | > 30万 |

| 2023年 | 1.723亿 (↑ 11.7%) |

41.35 (↑ 58.1%) |

21.43 (↑ 459.2%) |

457 (↑ 13.1%) |

79 (↑ 23.7%) |

> 5万 | > 45万 |

| 2024年 | 1.836亿 (↑ 6.6%) |

47.92 (↑ 15.9%) |

41.57 (↑ 94.0%) |

488 (↑ 6.9%) |

94 (↑ 18.9%) |

> 10万 | > 49万 |

| 2025年H1 | 突破2亿 | 35.70 (半年) (↑ 35.0%) |

25.91 (半年) (↑ 27.4%) |

293 (半年) (↑ 22.7%) |

60 (半年) (↑ 34.4%) |

> 15万 | > 50万 |

- 履约与配送能力:全国拥有33个药品仓(其中22个为专业冷链仓),即时零售送达时效最快9分钟,平均30分钟送药上门。

- AI京医赋能:截至2025年6月30日,“AI京医”智能体累计服务用户数已超过5,000万,实现了健康管理服务的智能化升级。

- 到家快检服务:2024年居家检测覆盖12个核心城市,到2025年上半年已扩展至23个城市,提供超过160款检测服务。

- 技术与服务闭环:该履约体系深度融入其“医、检、诊、药”的一站式健康服务中。例如,在线医生开具处方后,药品可通过上述网络快速配送到家。

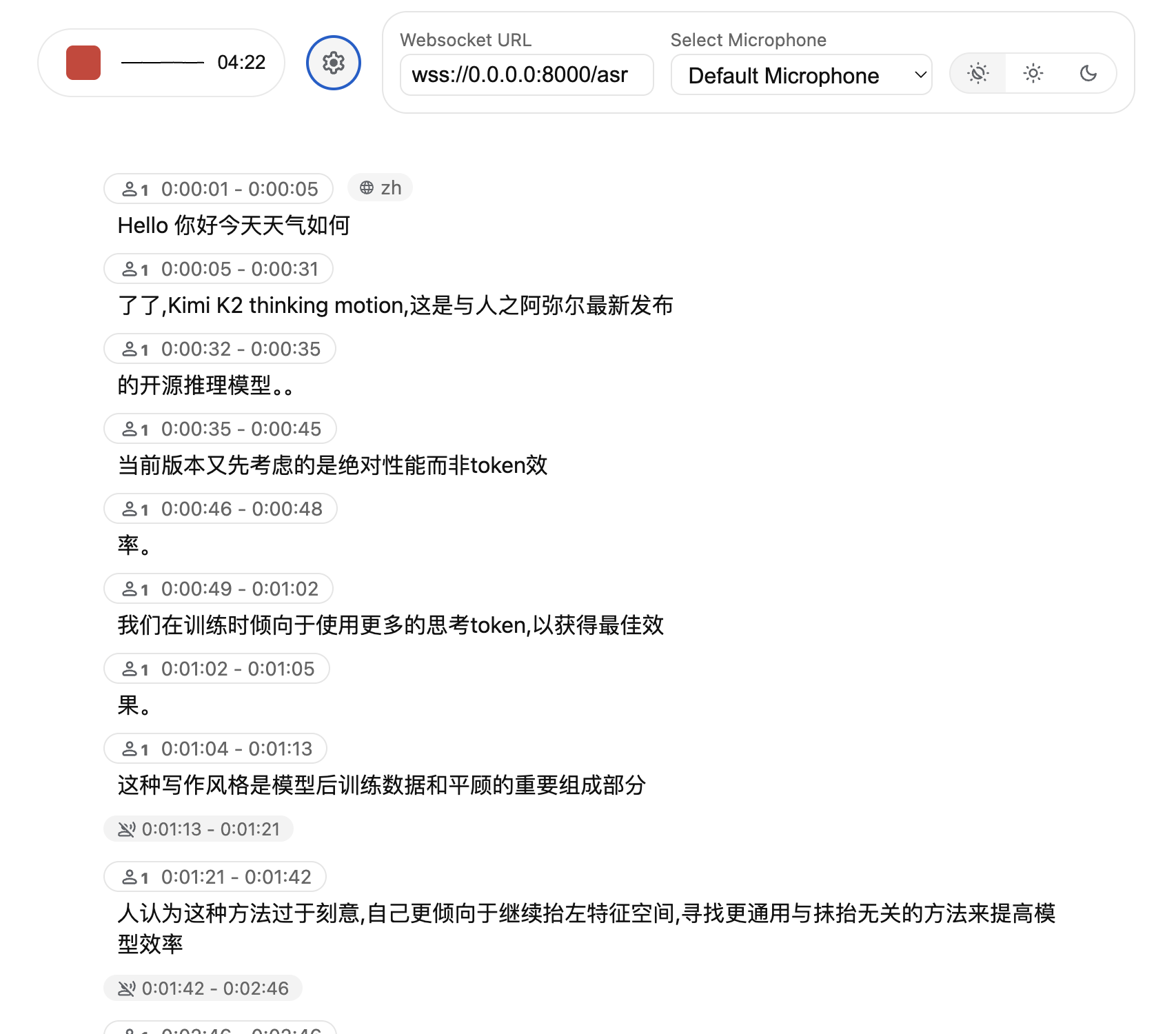

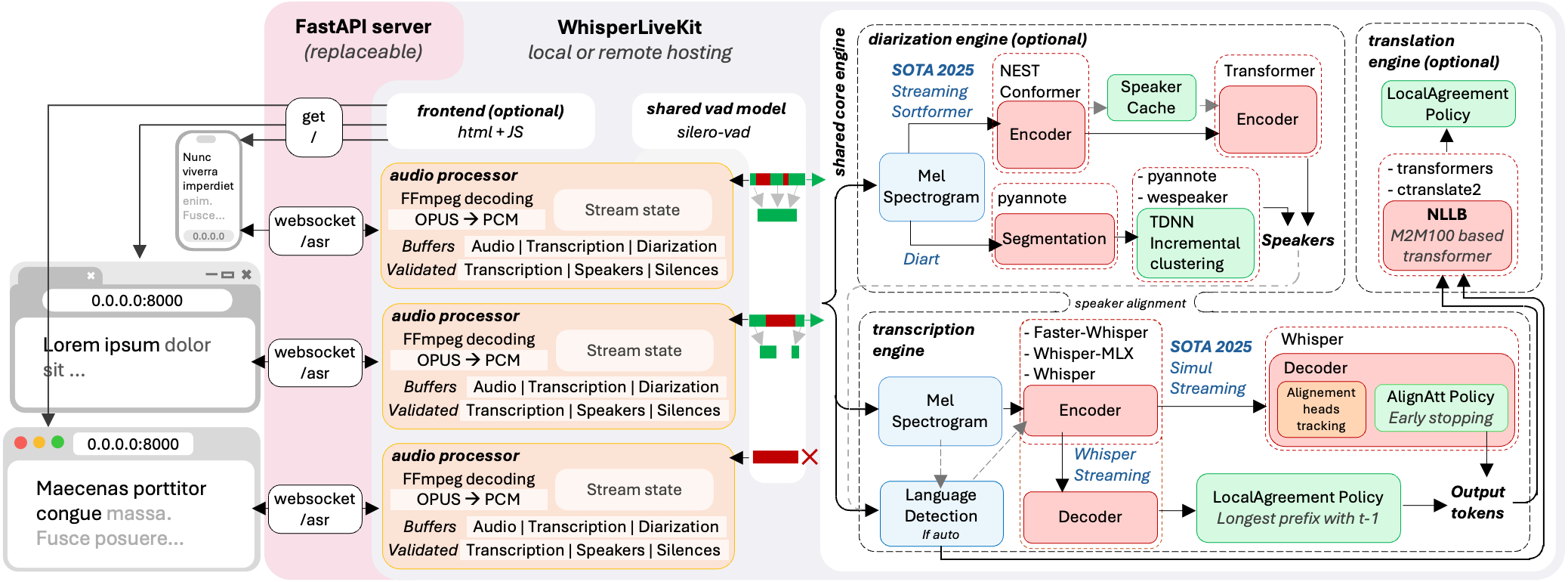

实时语音识别

FunASR

WhisperLiveKit

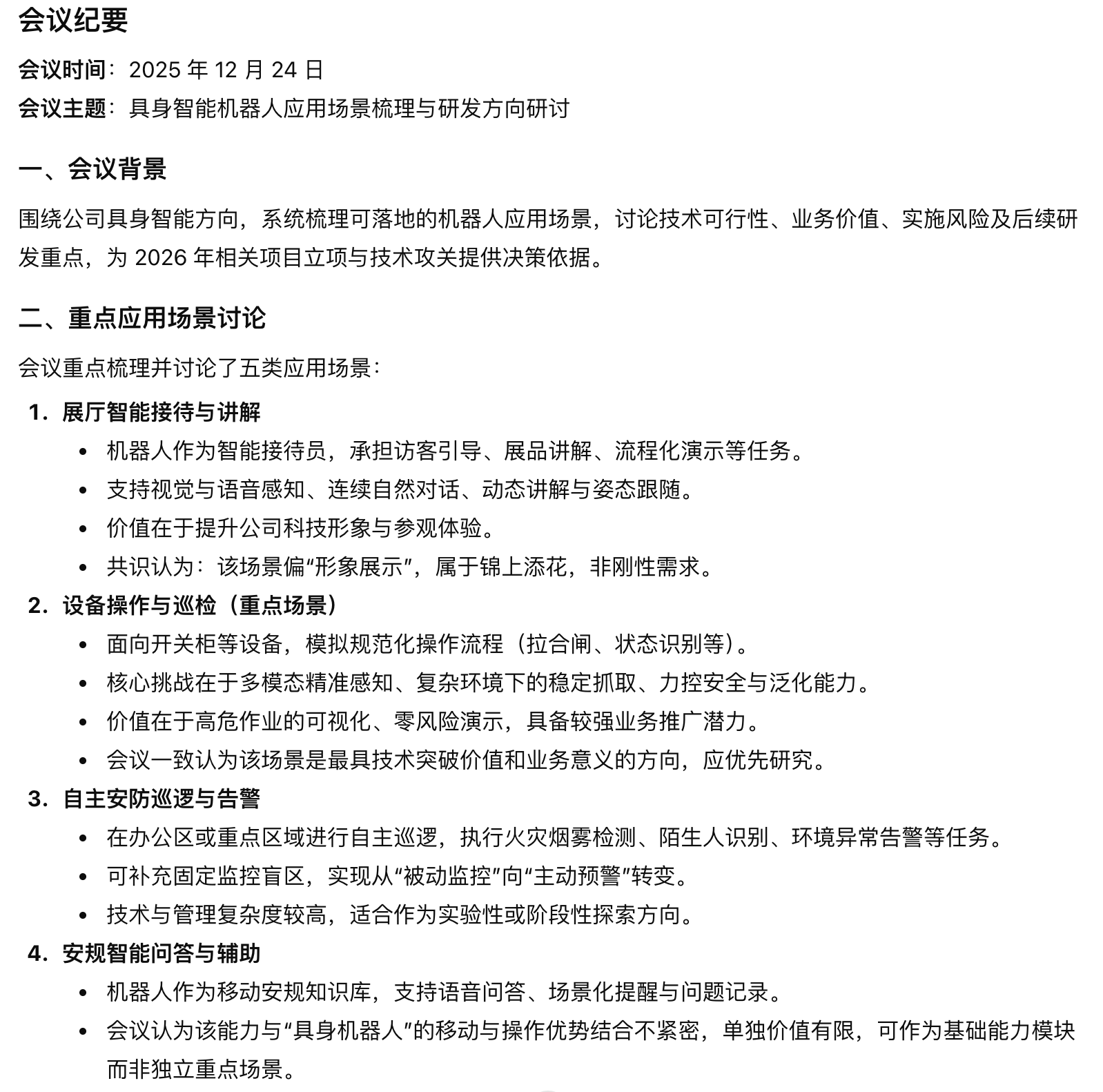

会议纪要助手(Qwen3-30B-A3B-GGUF)

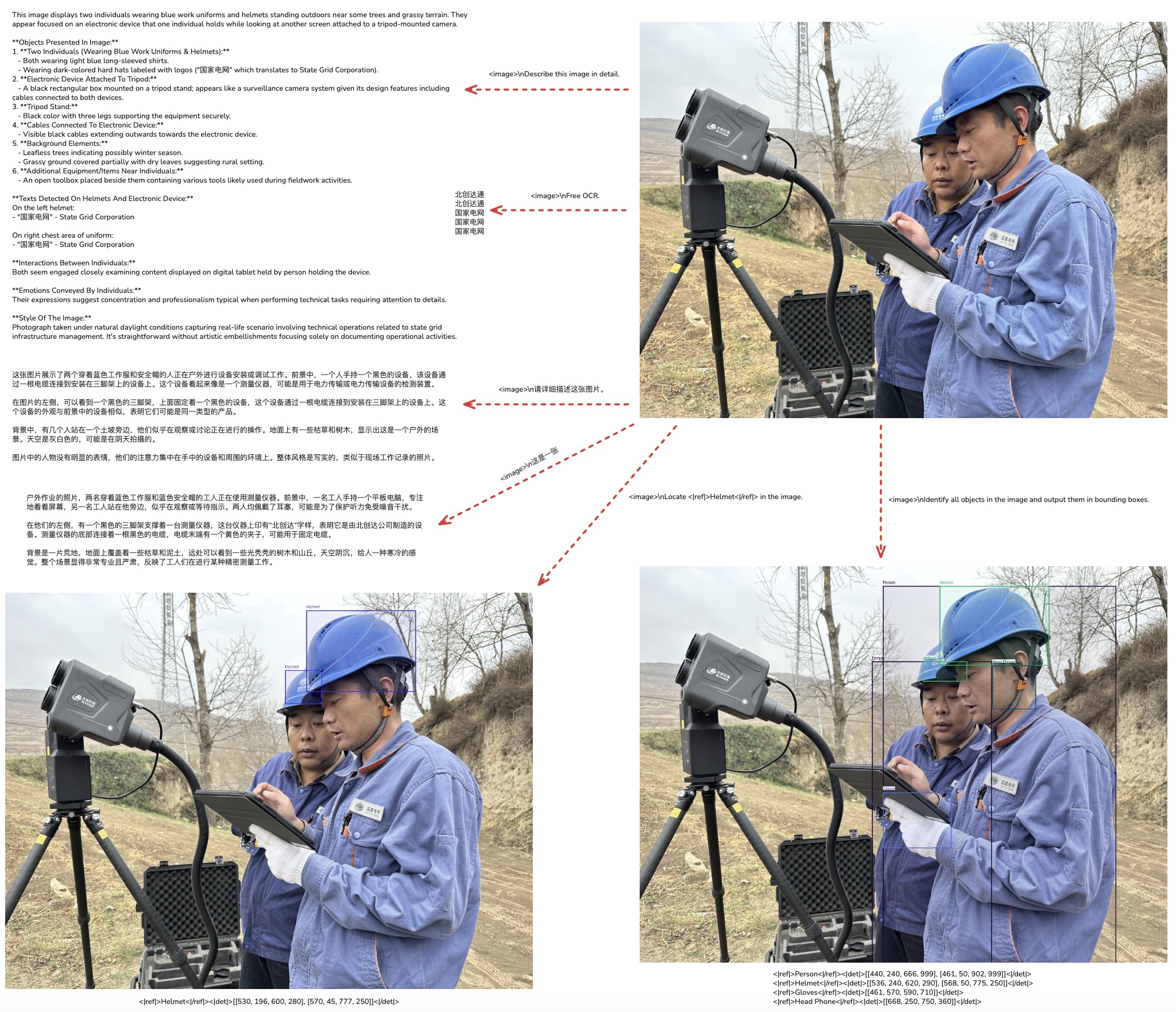

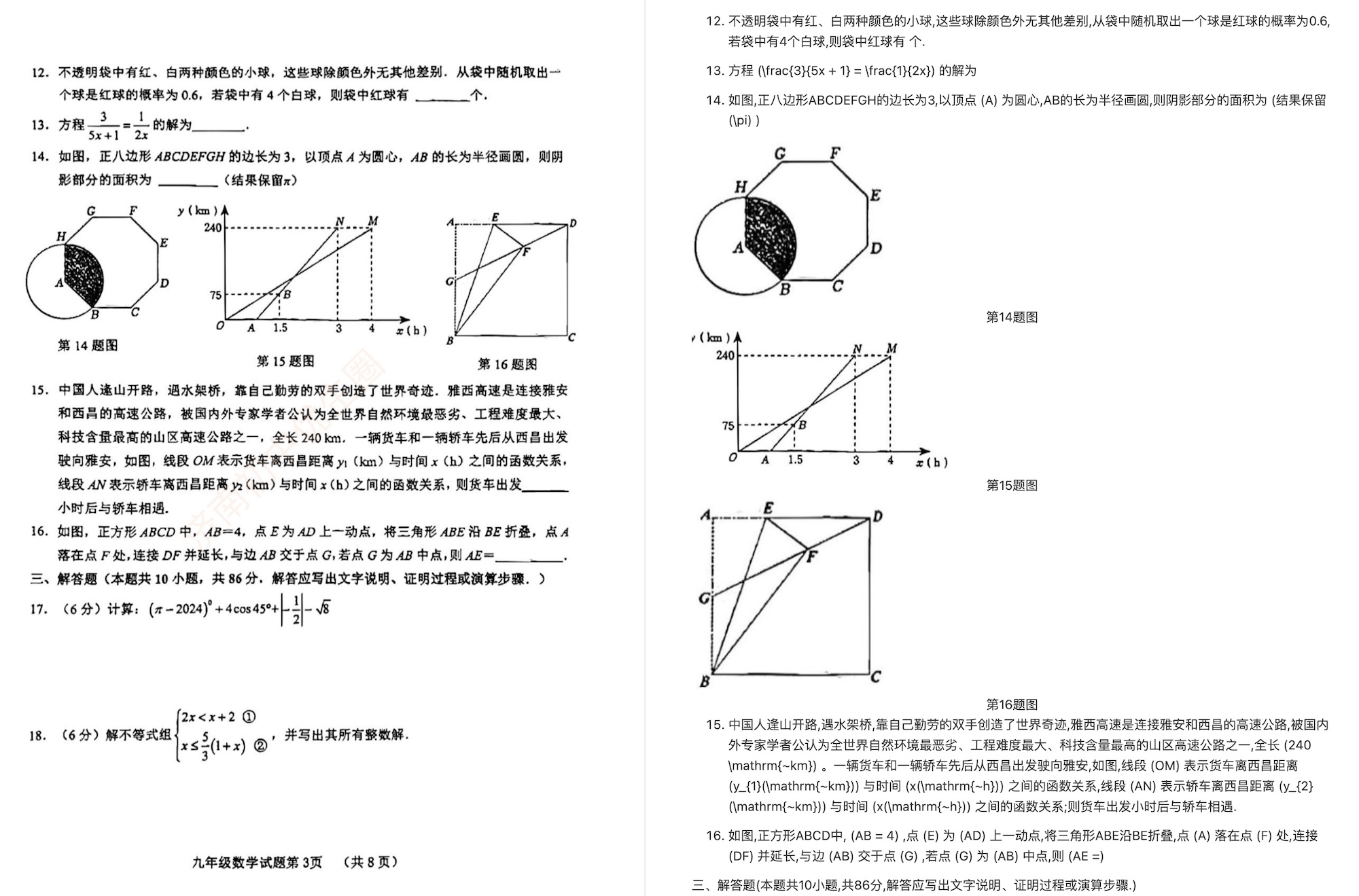

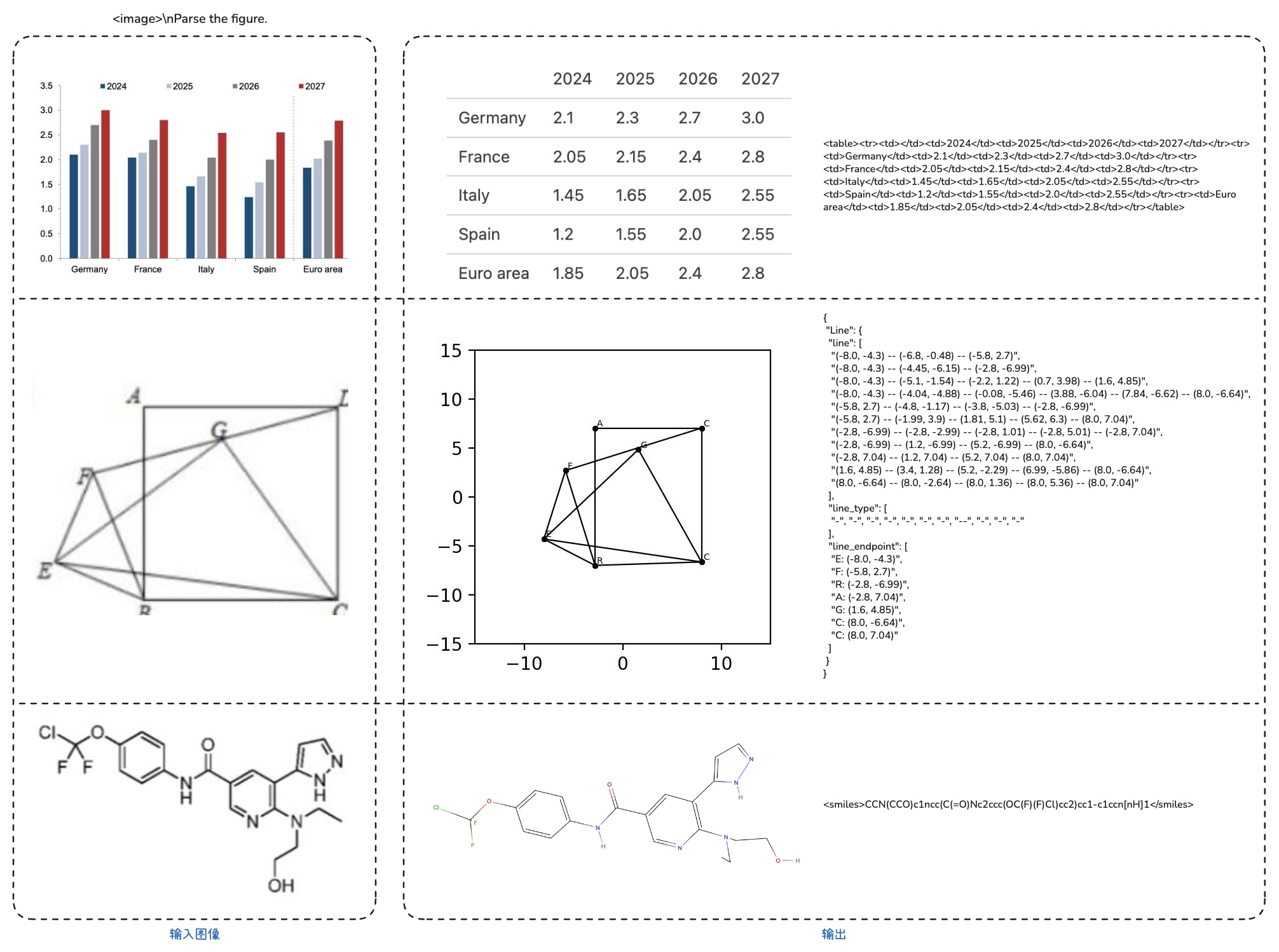

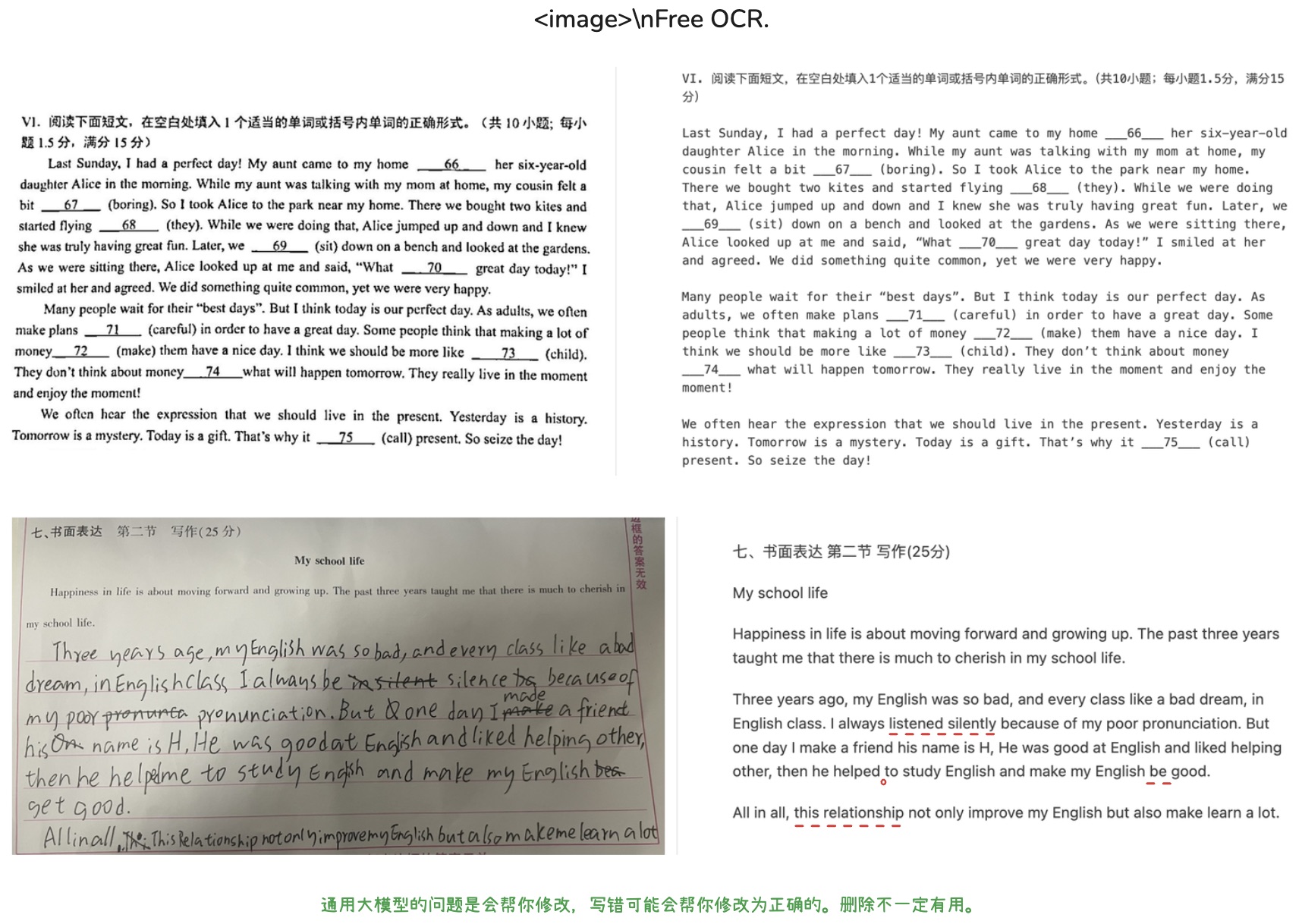

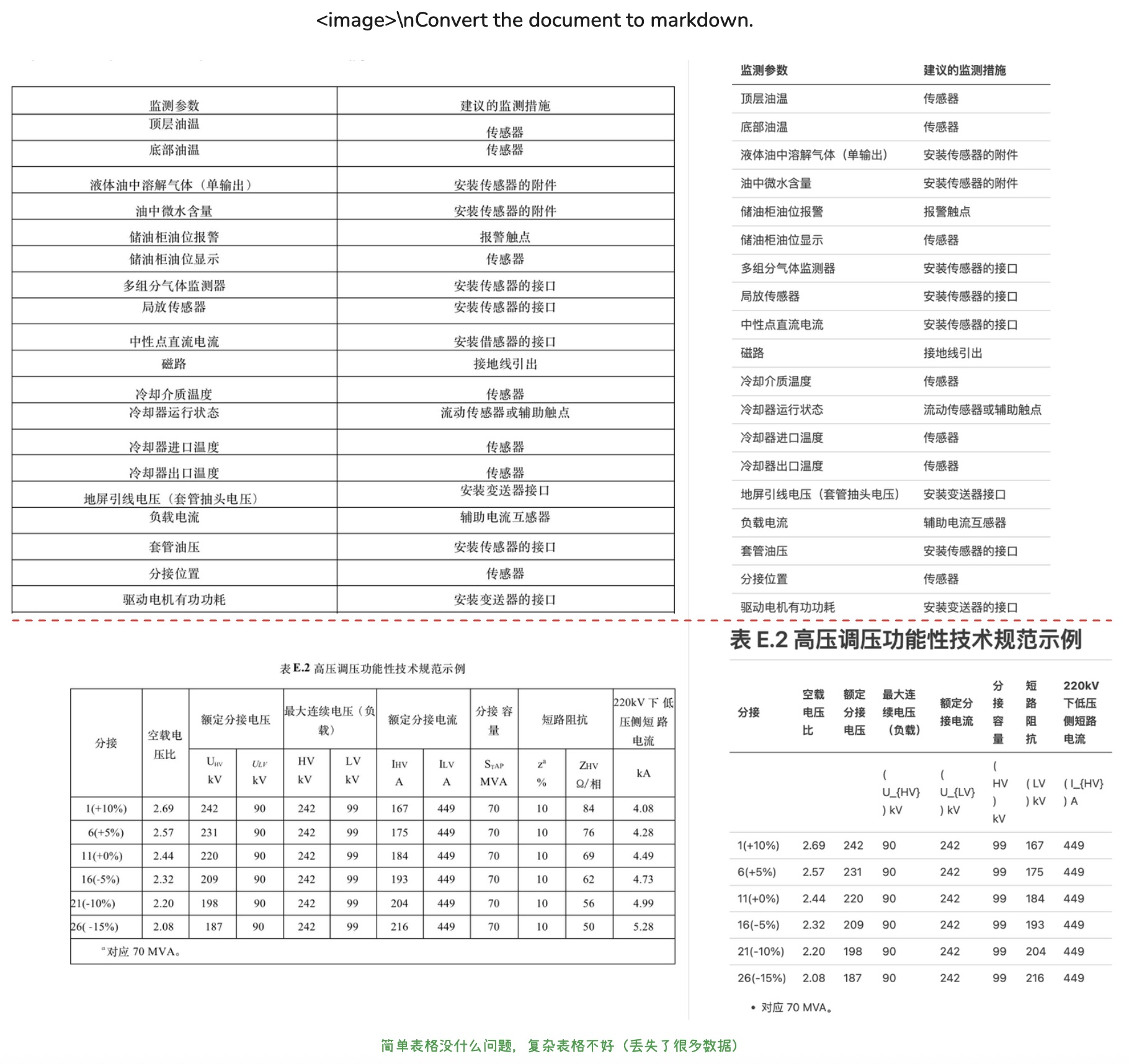

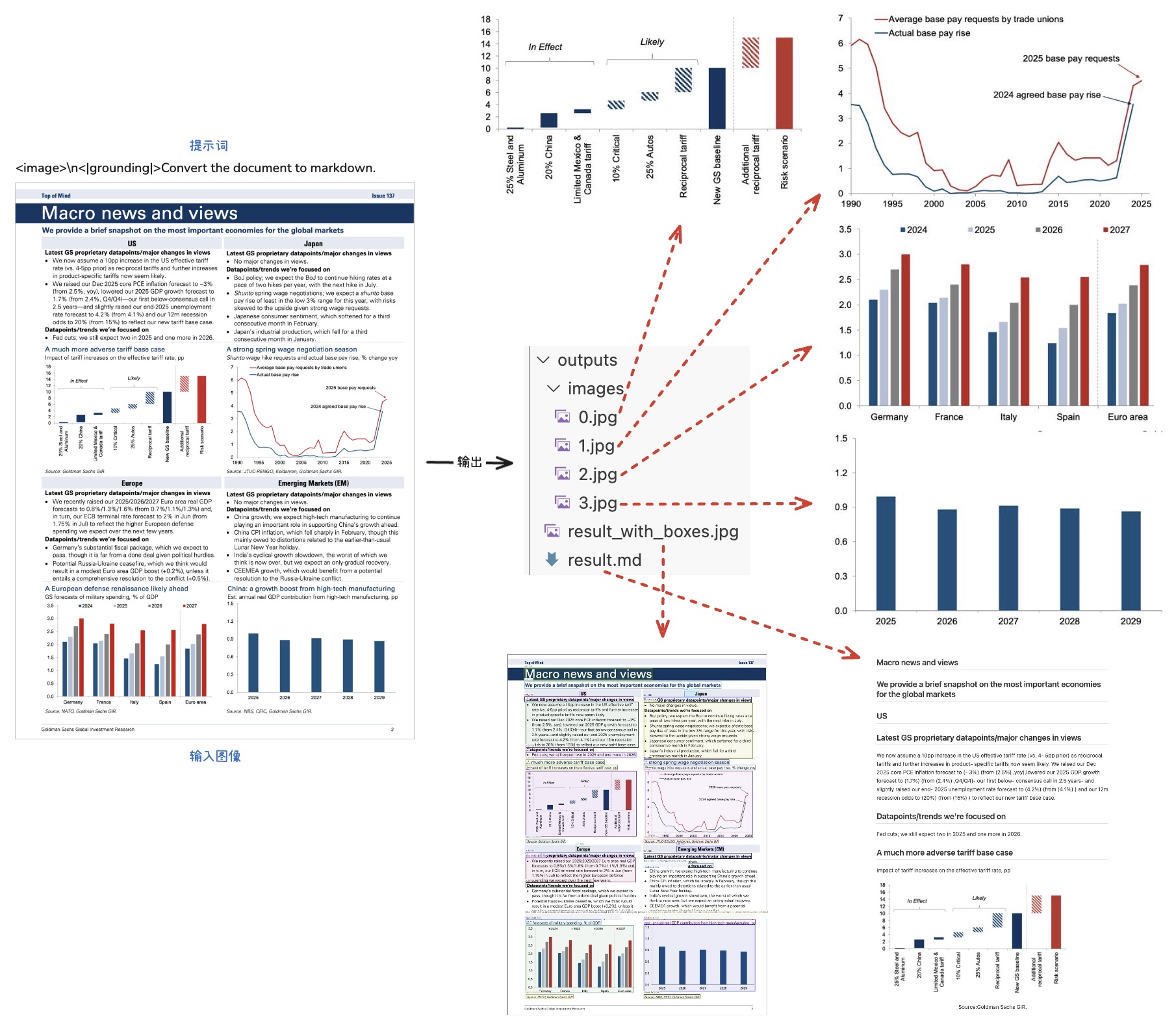

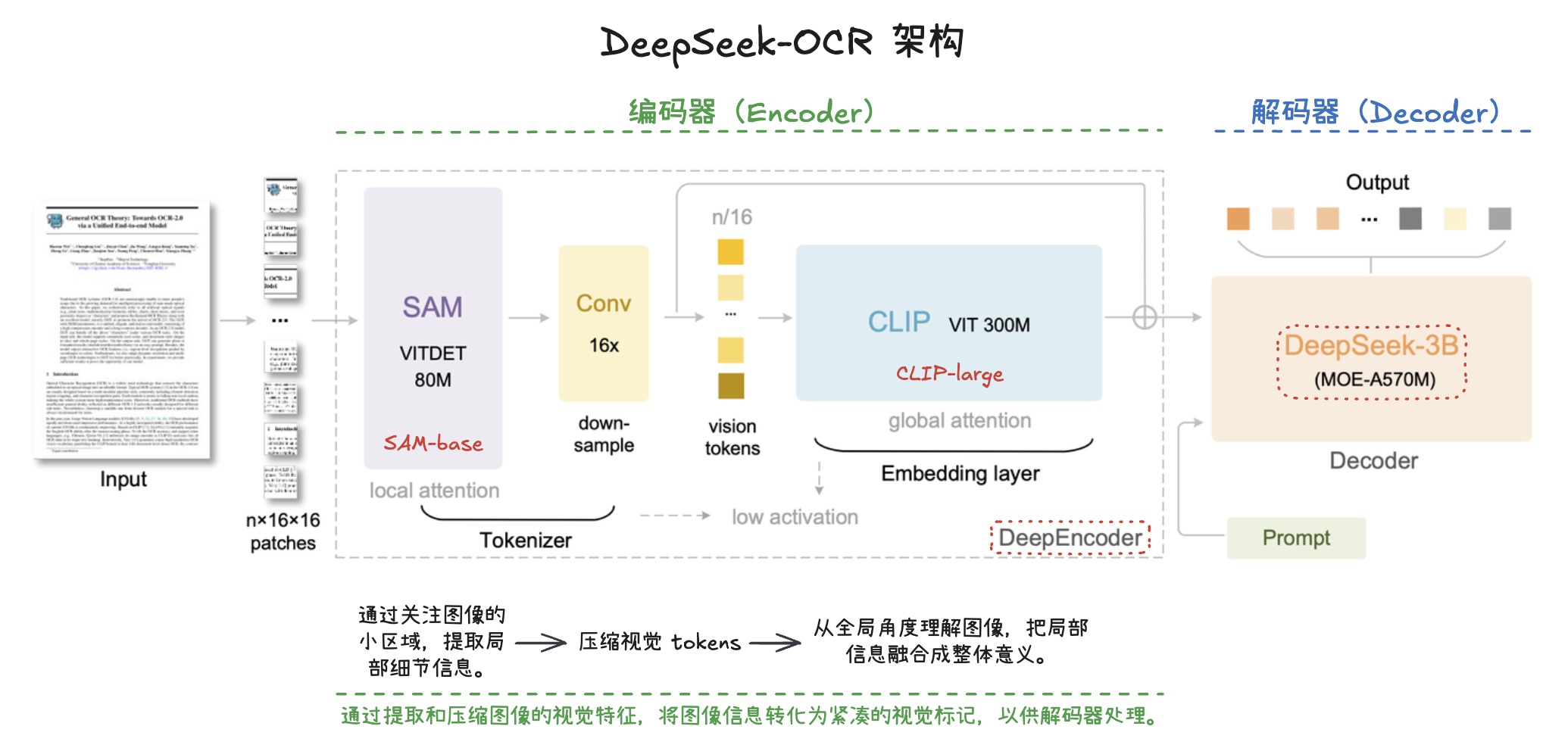

DeepSeek-OCR

视觉理解

数学公式识别

表格识别

英文OCR

图像转 Markdown Table

图像转 Markdown

图像生成与编辑(Nano Banana)

图像生成

换装

样本生成(绝缘子缺陷)

样本生成(鸟窝)

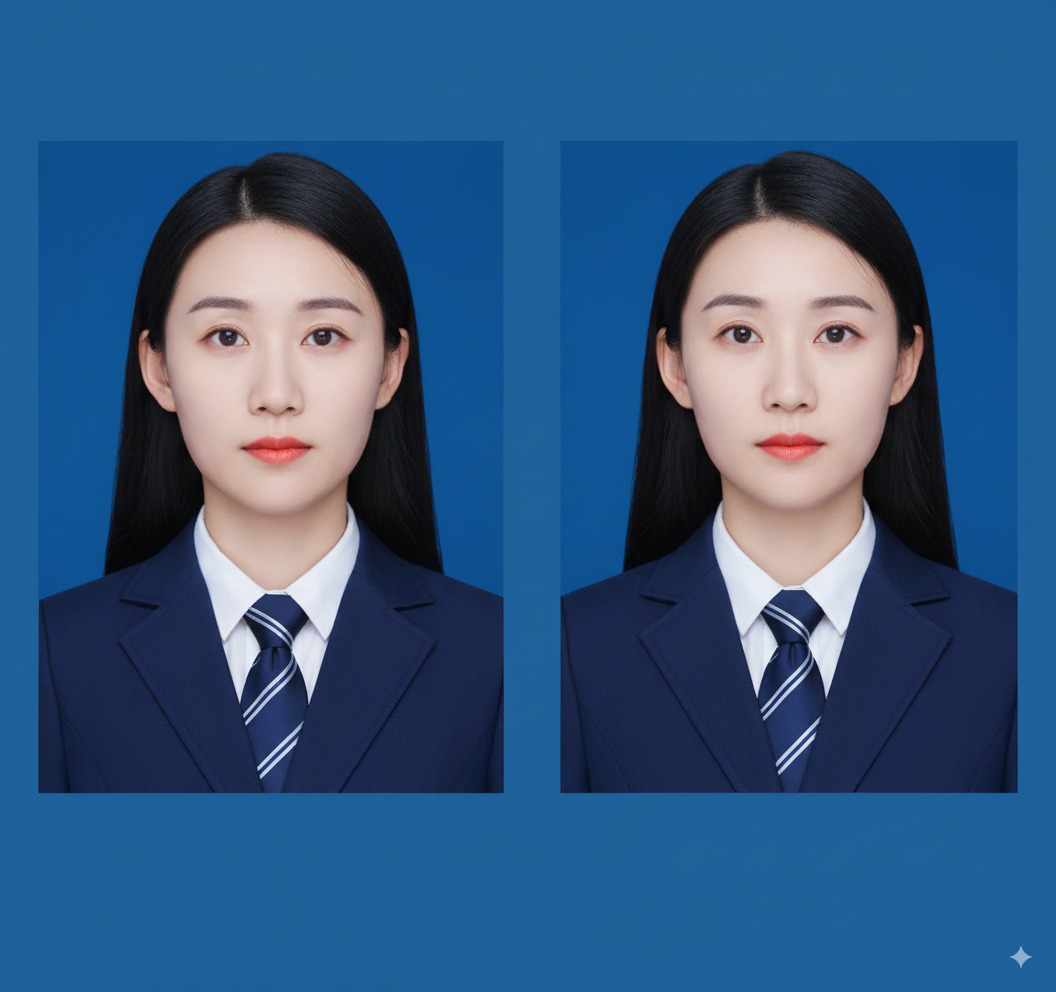

生成学生证照片

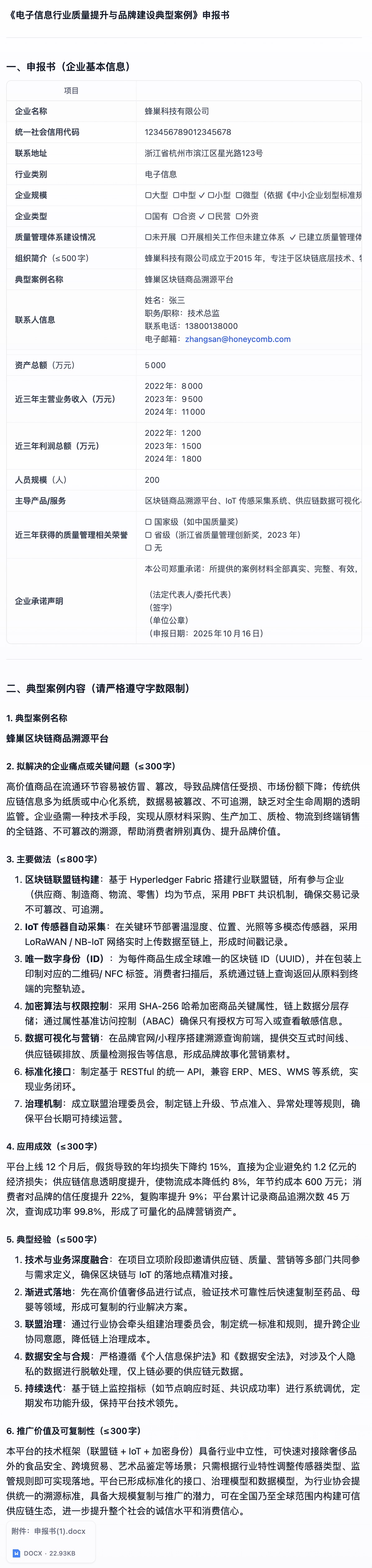

根据项目和要求生成申报书(智能体)

代码分析生成 Web 应用(Claude Code)

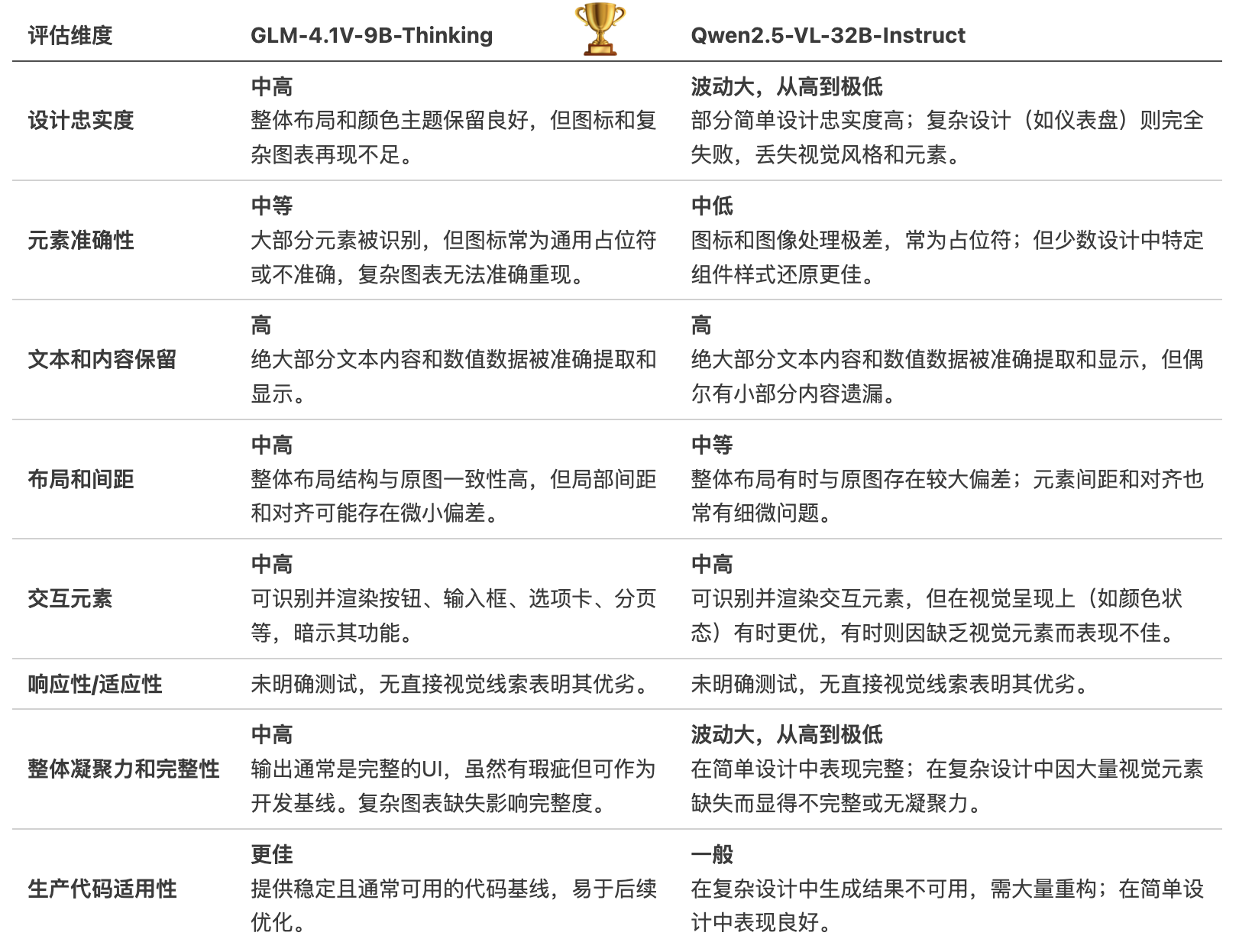

从设计稿生成代码(Design2Code)

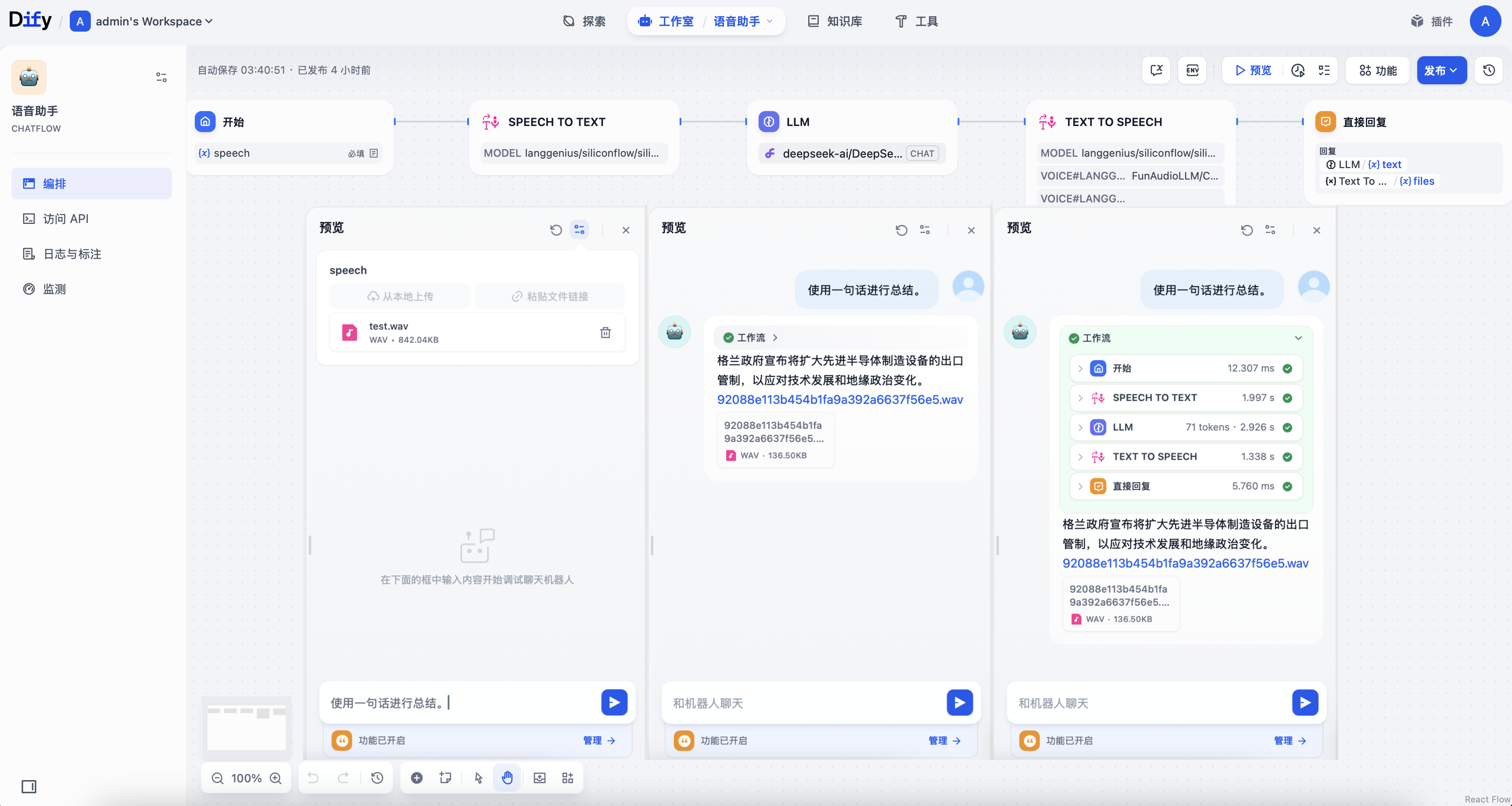

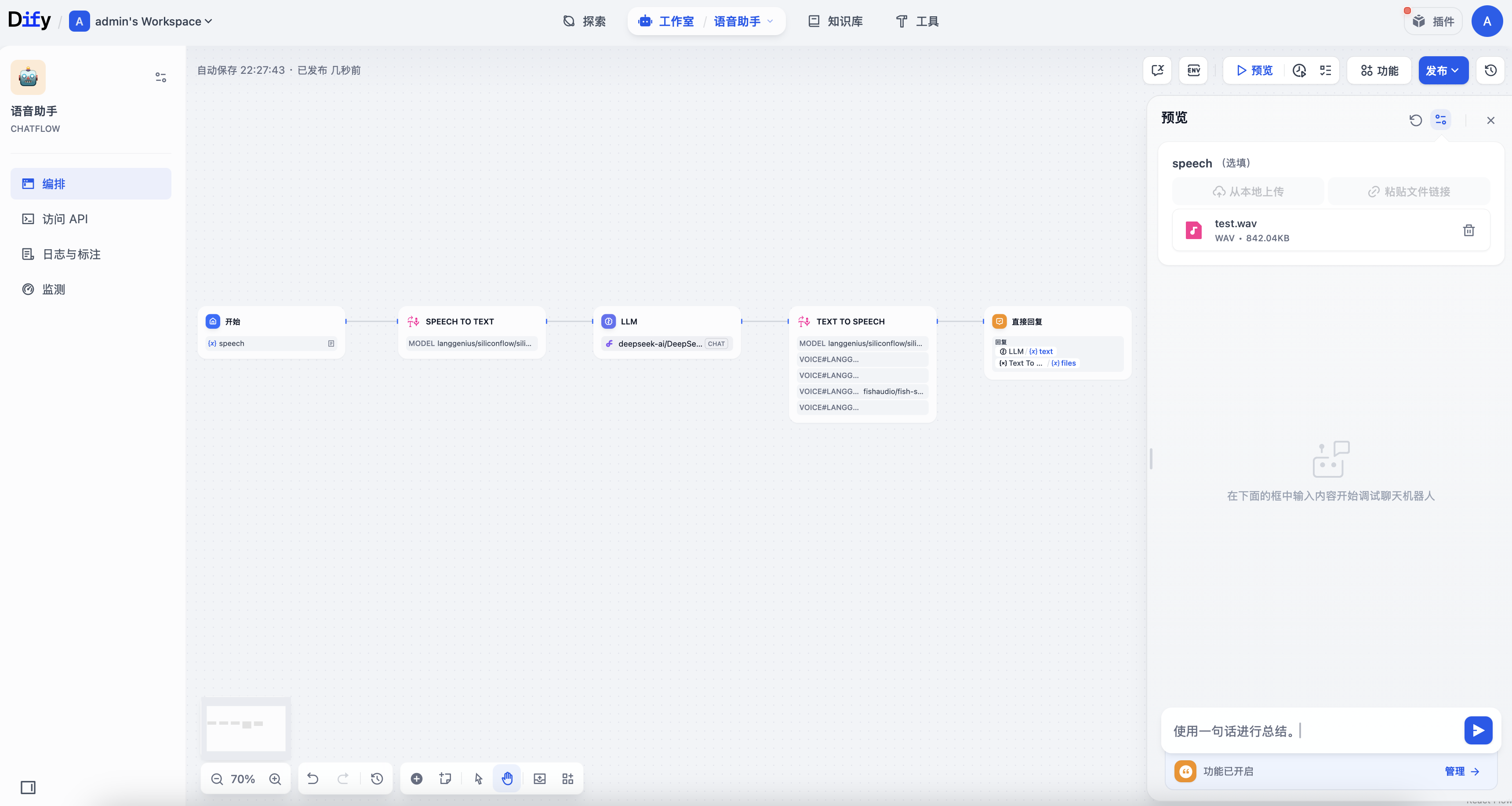

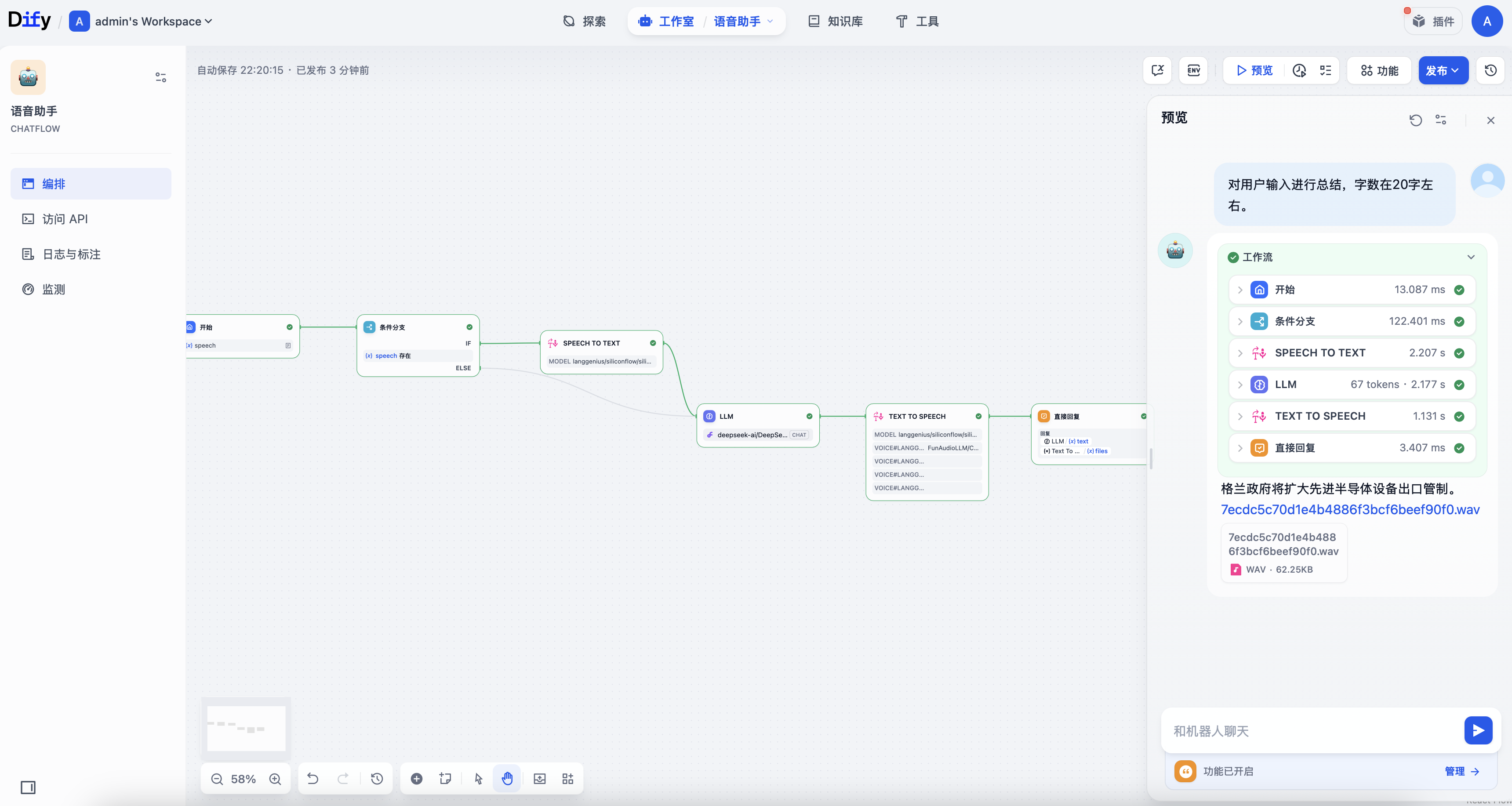

语音智能体

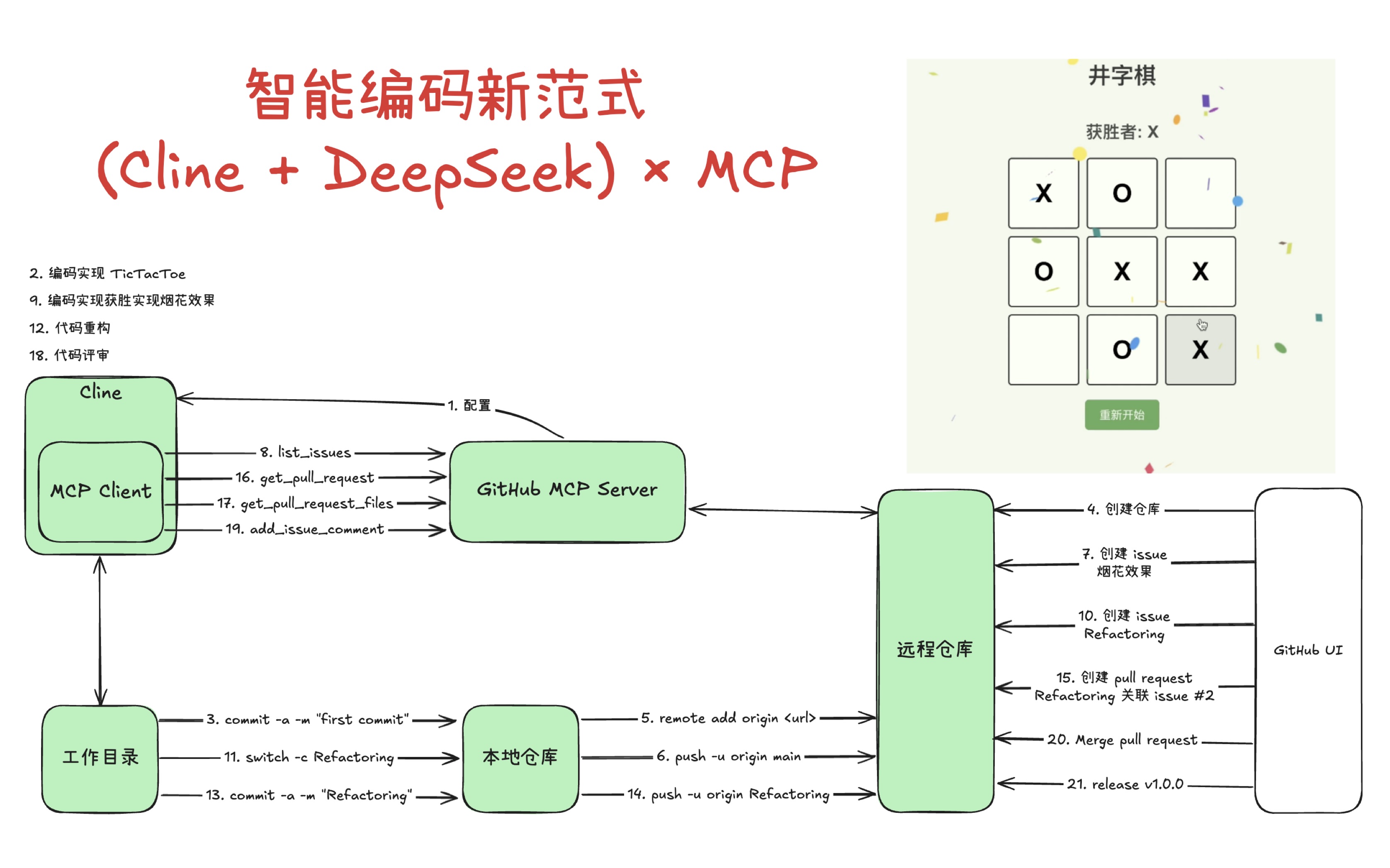

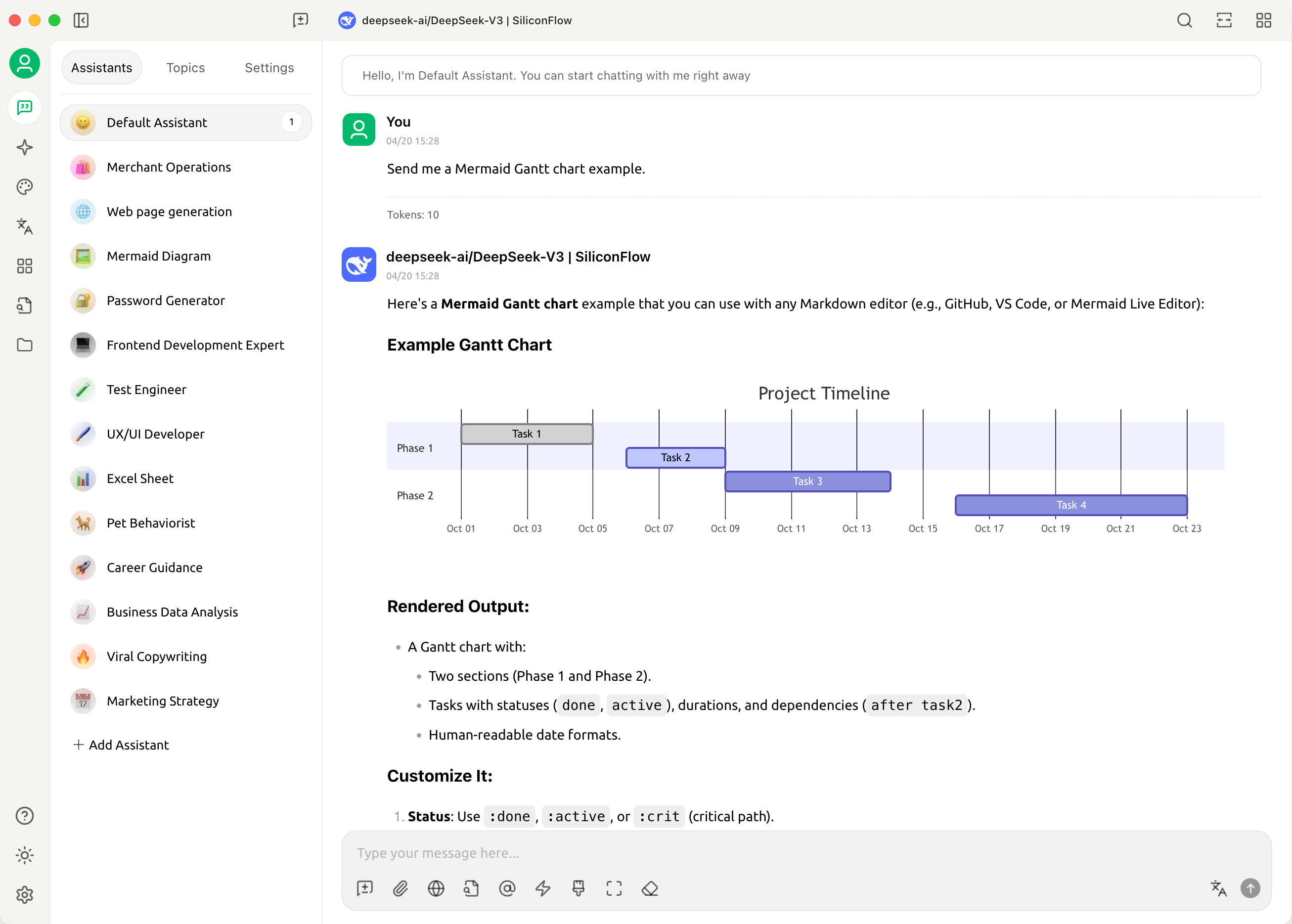

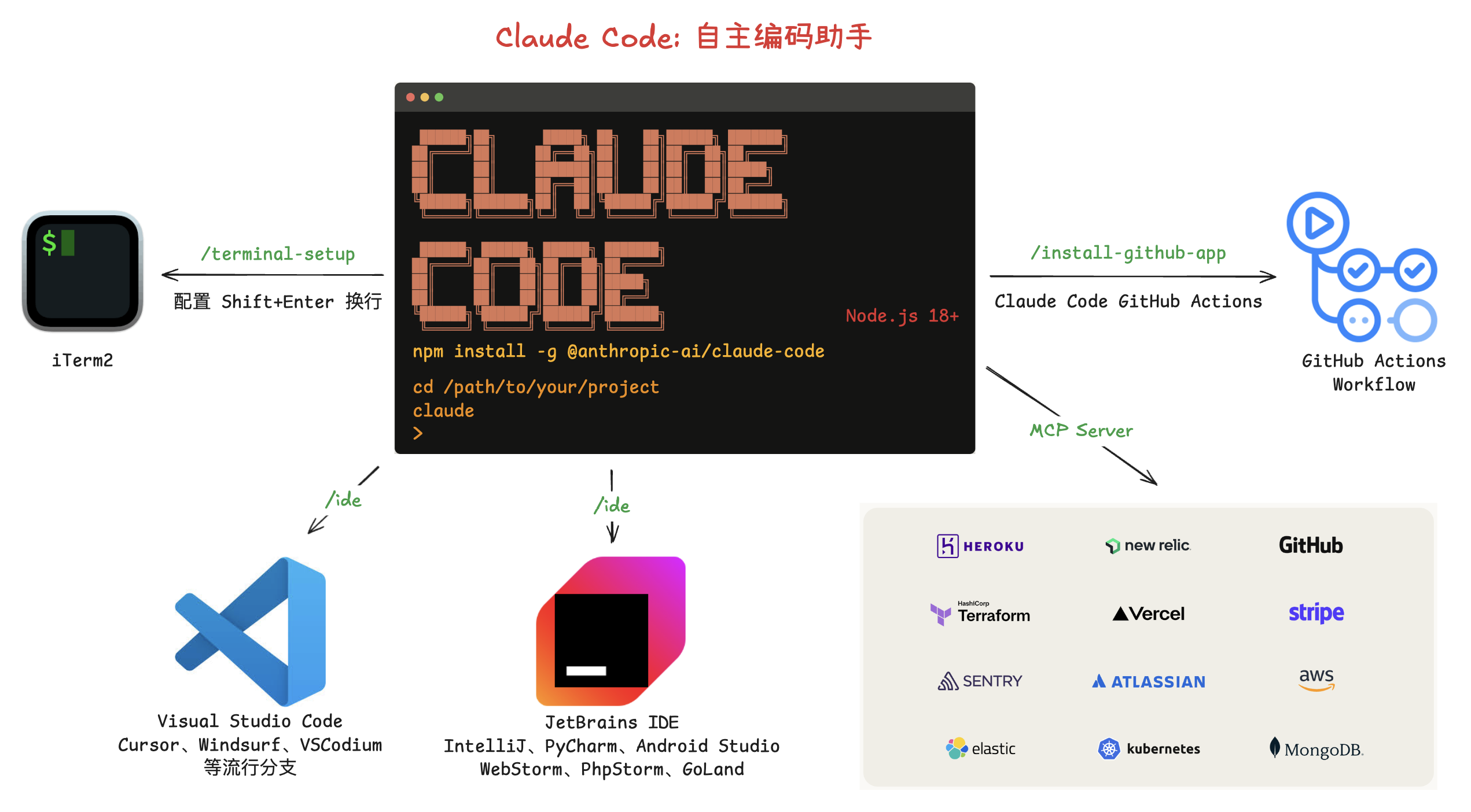

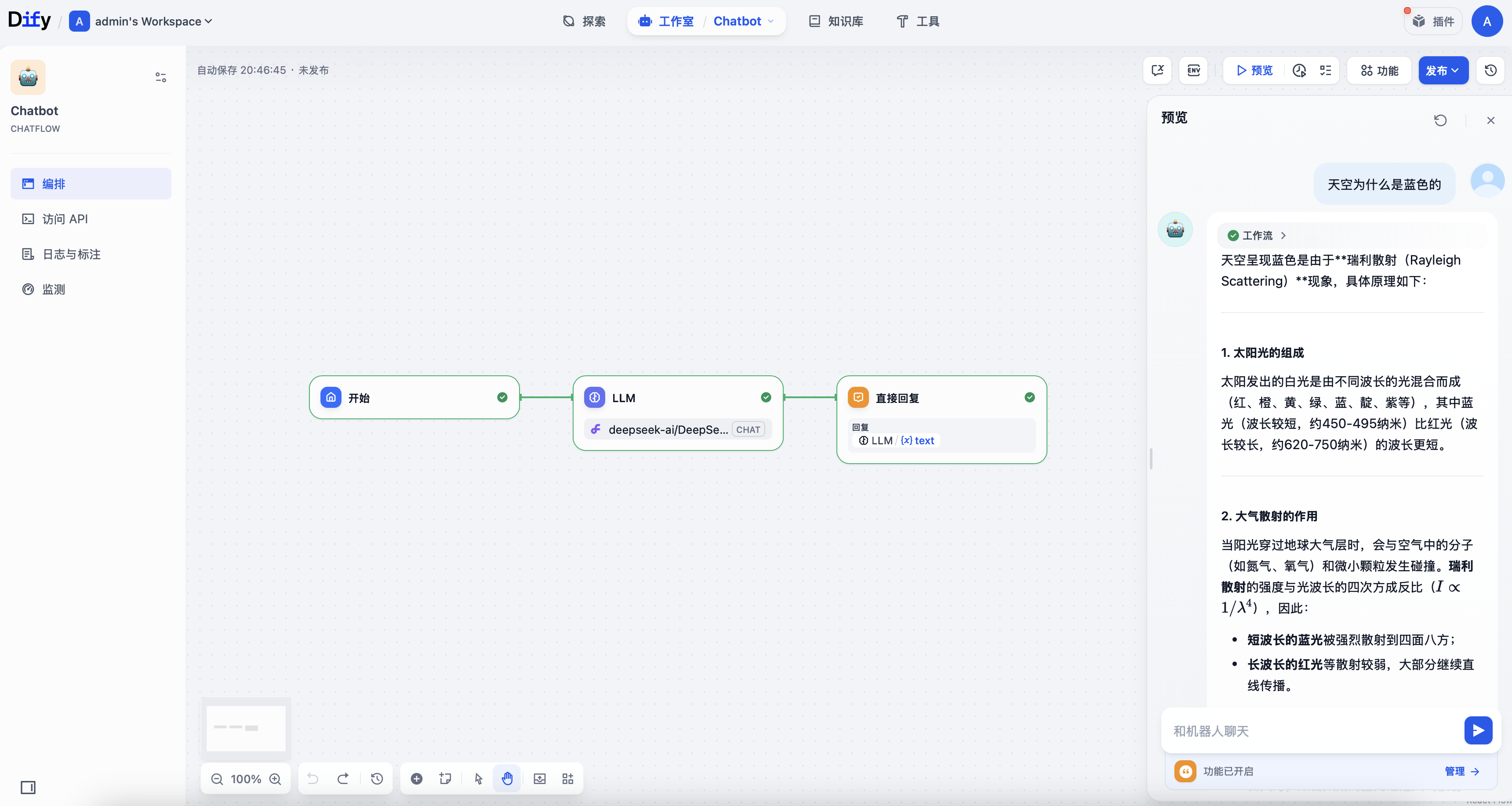

智能编码新范式 (cline + DeepSeek) × MCP

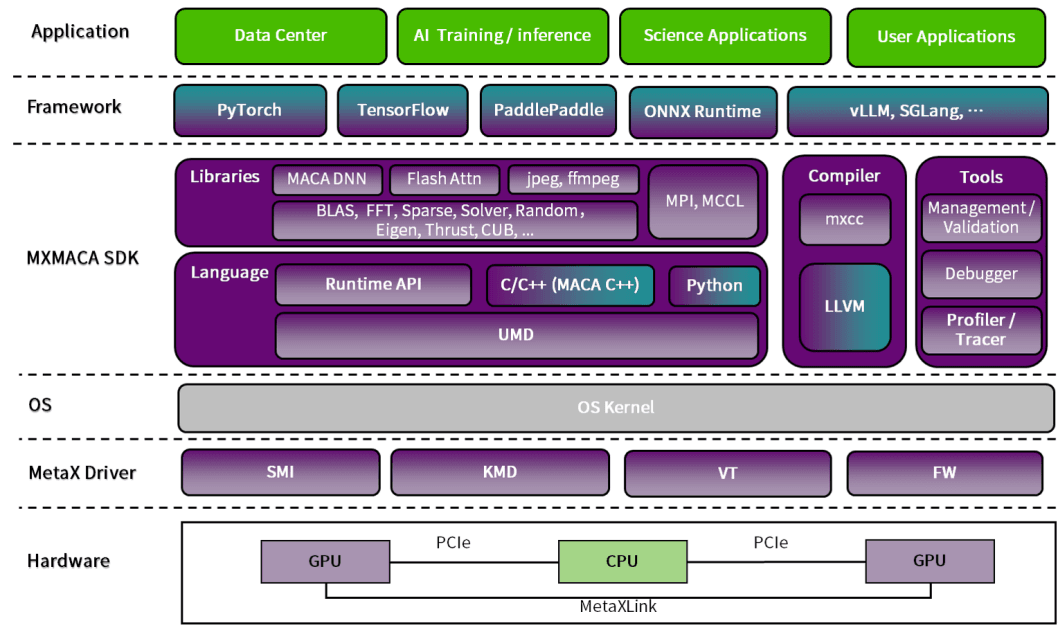

模型 & 系统架构

DeepSeek-OCR

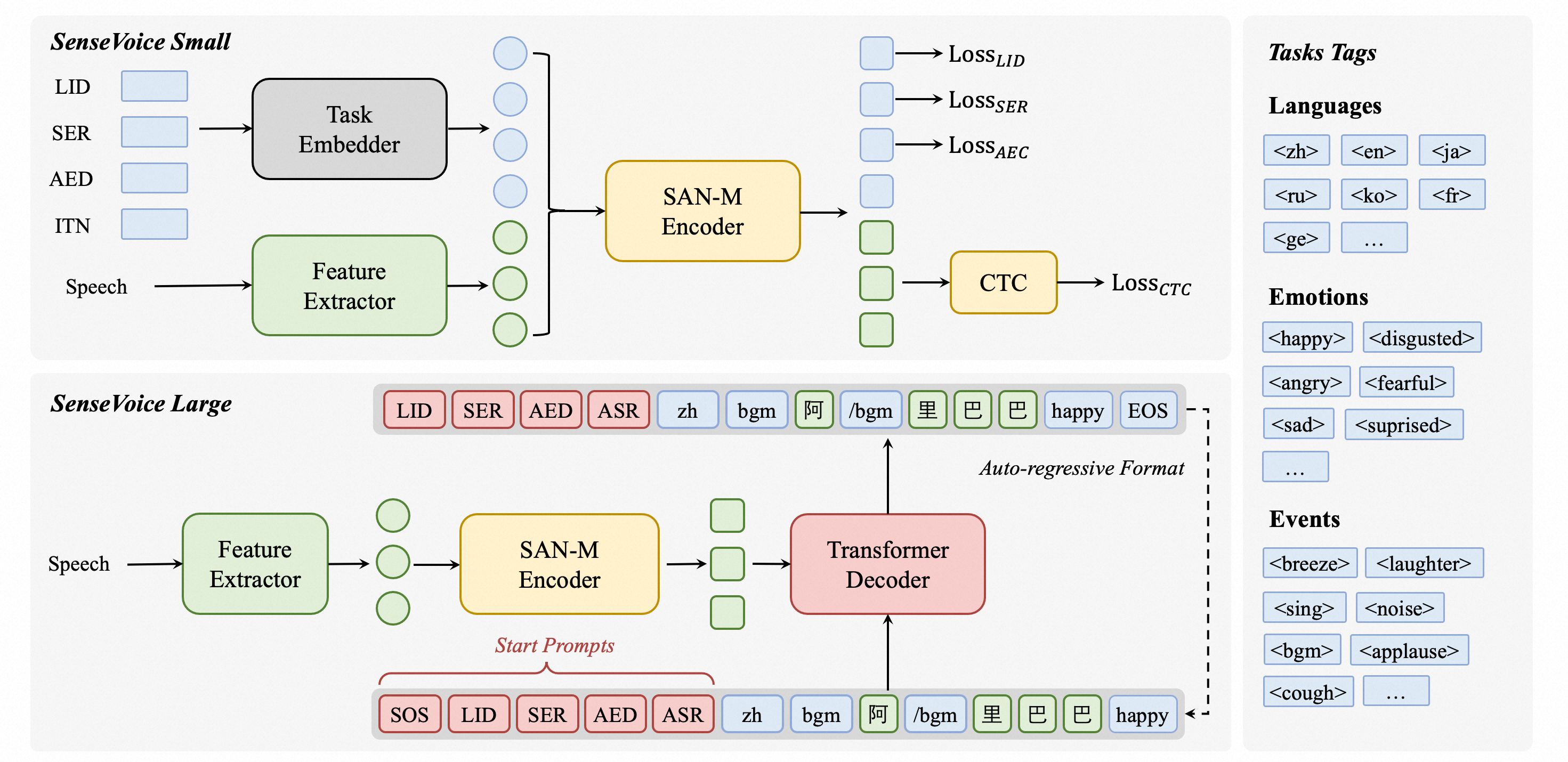

SenseVoice2

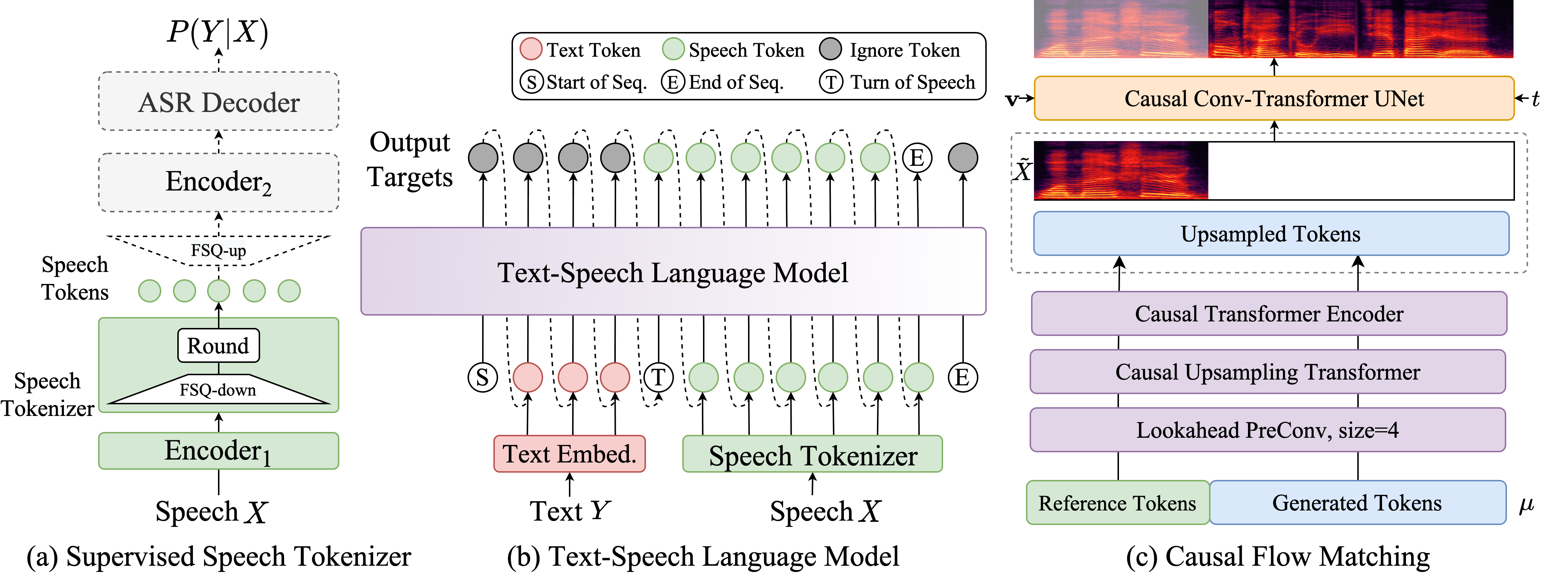

CosyVoice2

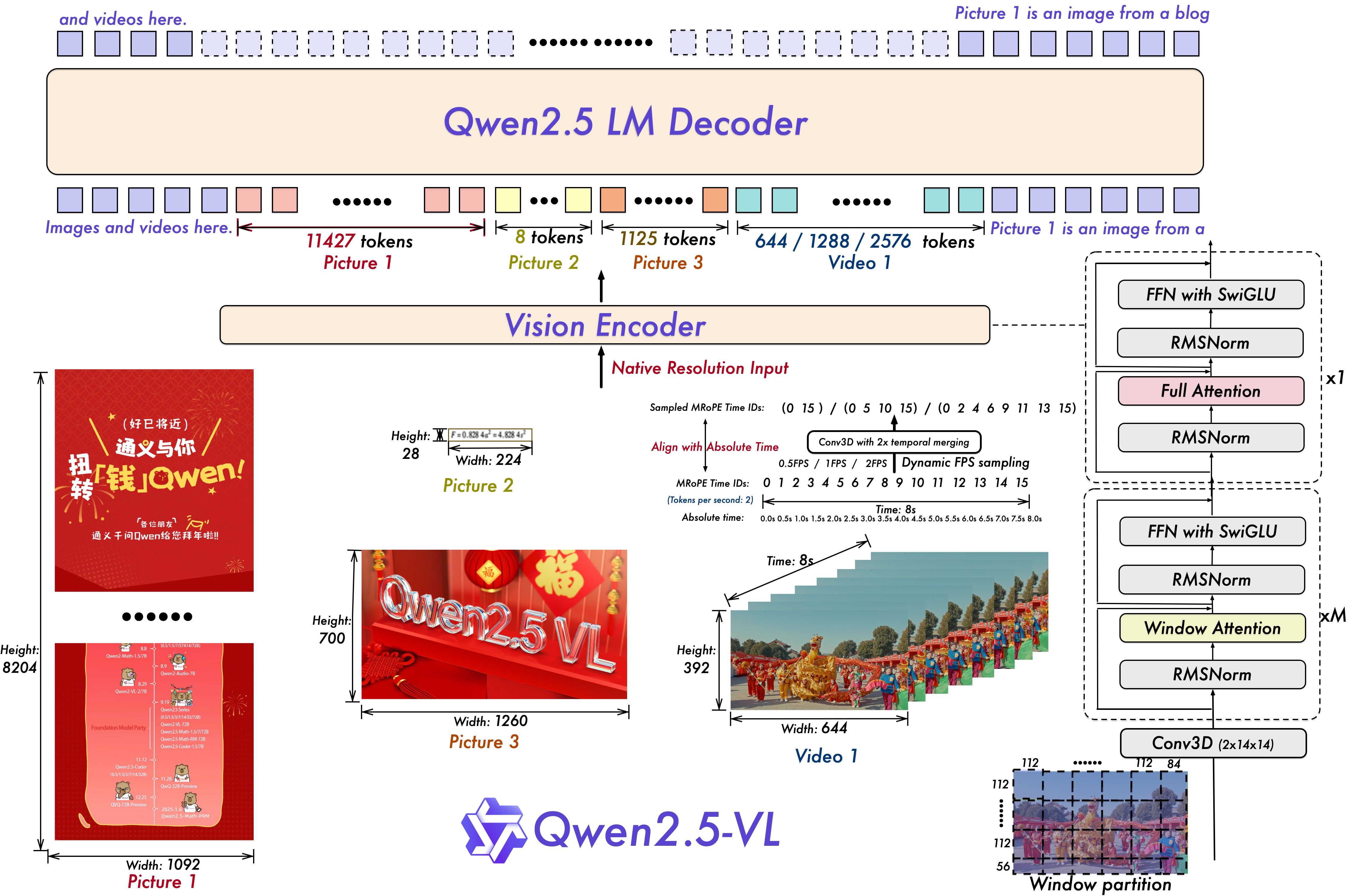

Qwen2.5-VL

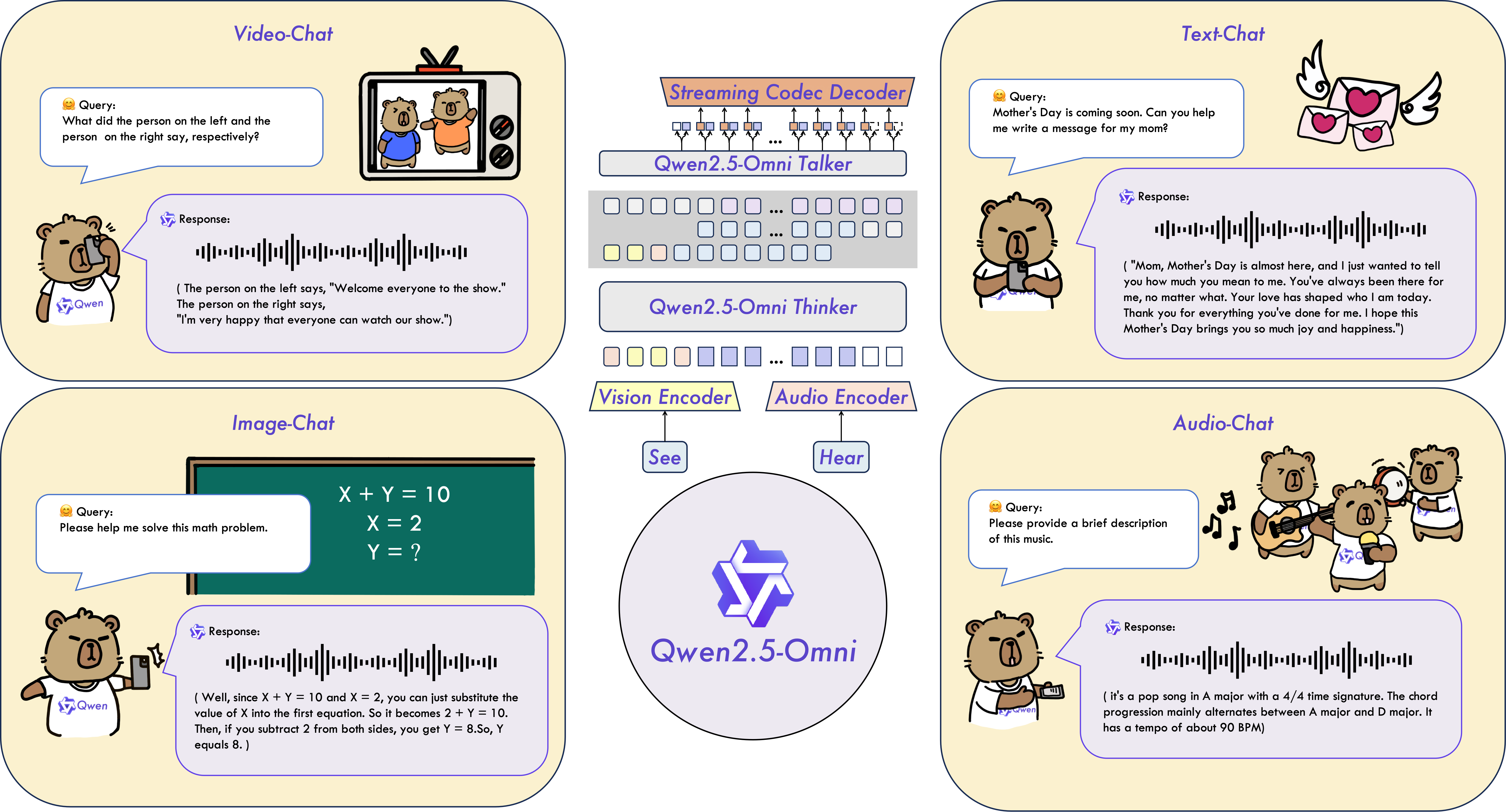

Qwen2.5-Omni

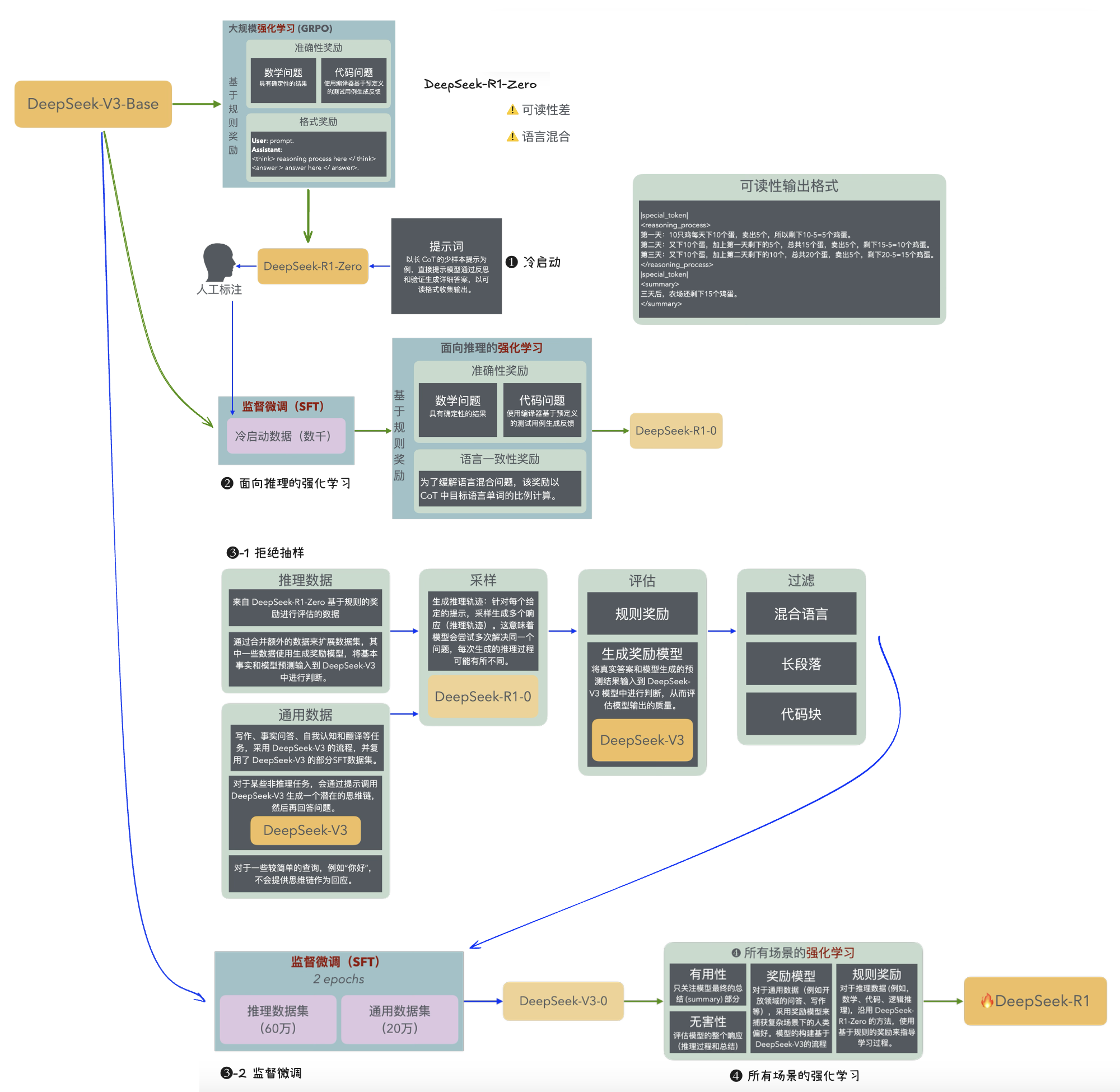

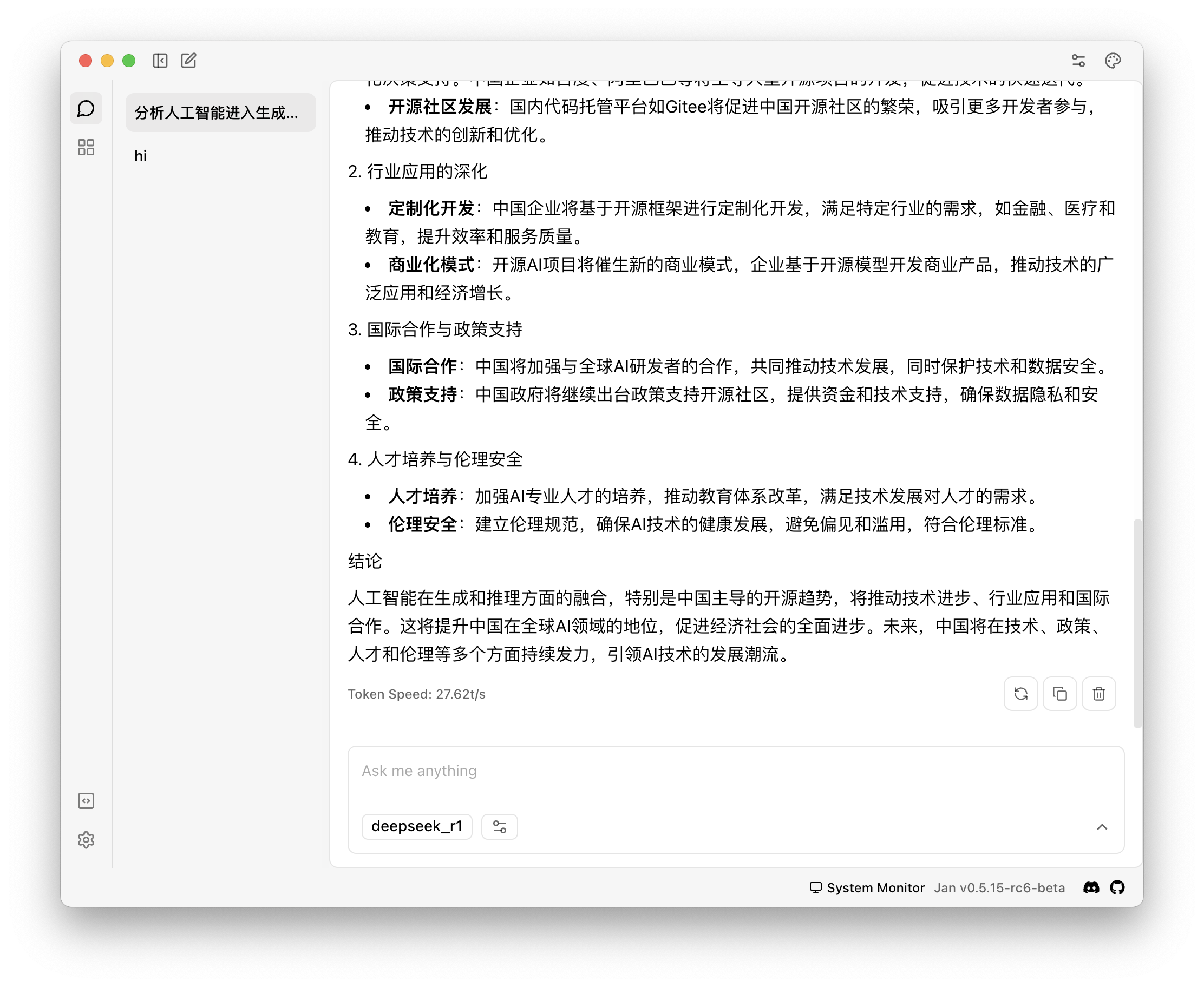

Deepseek-R1

WhisperLiveKit

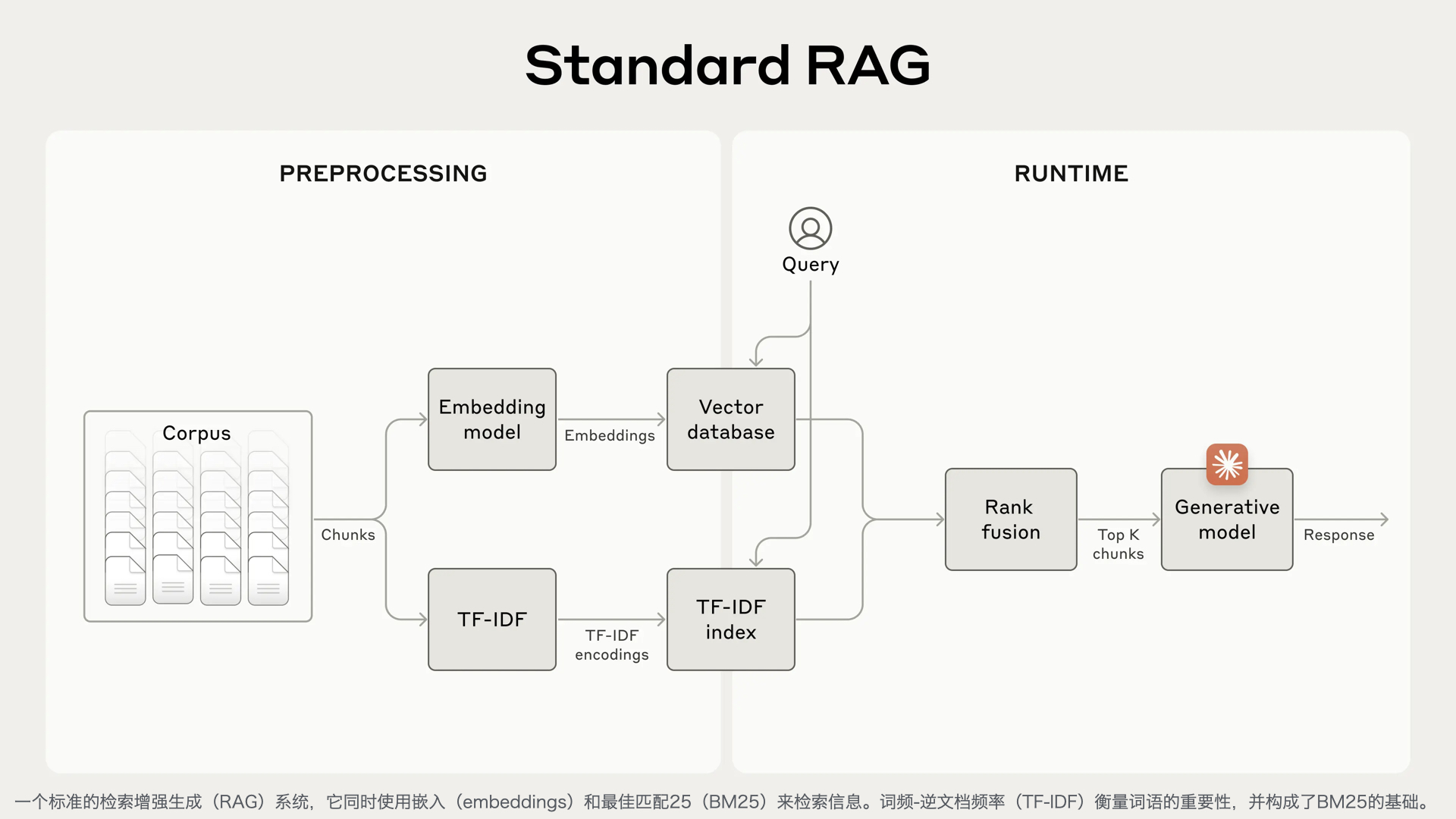

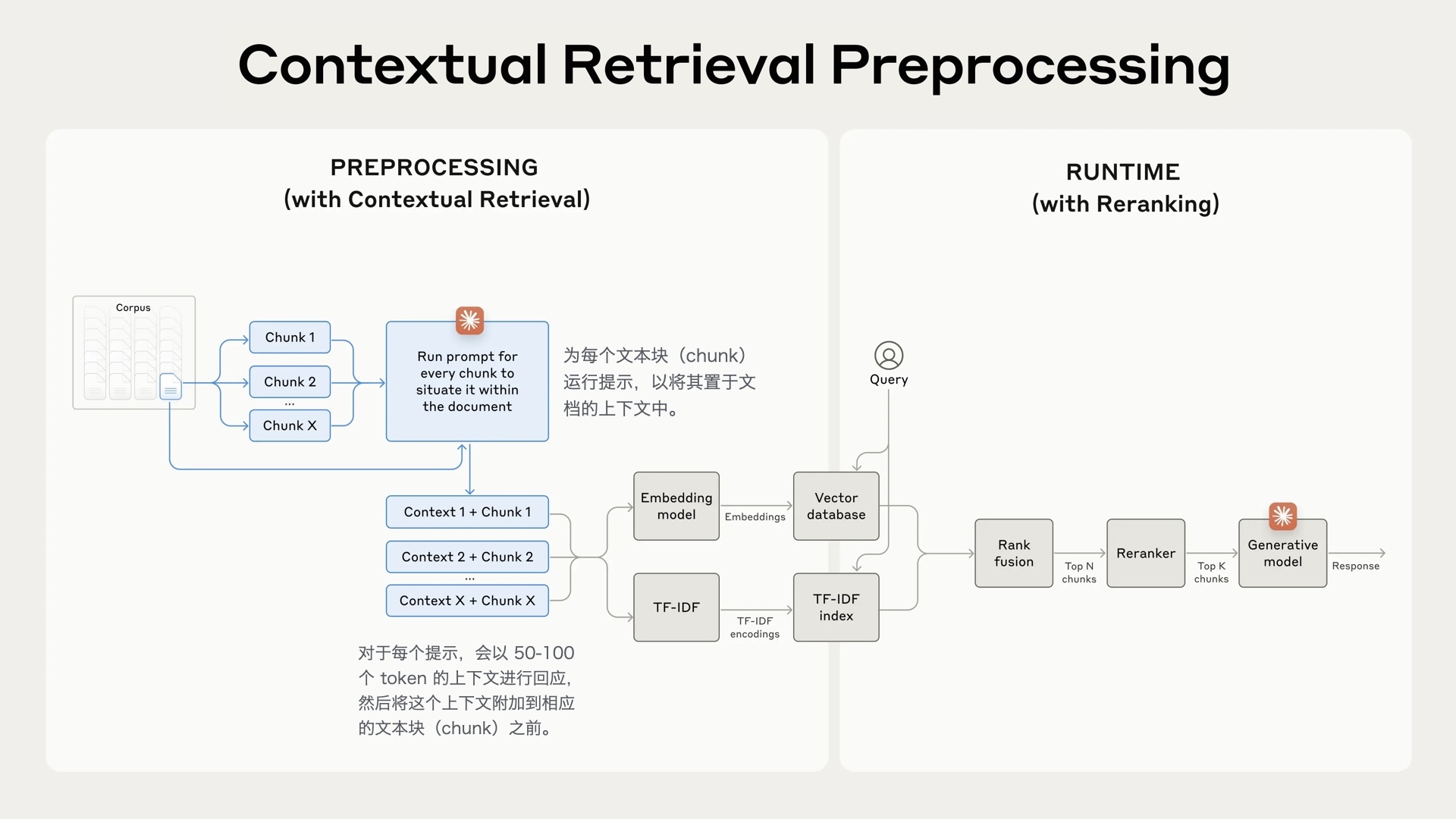

RAG

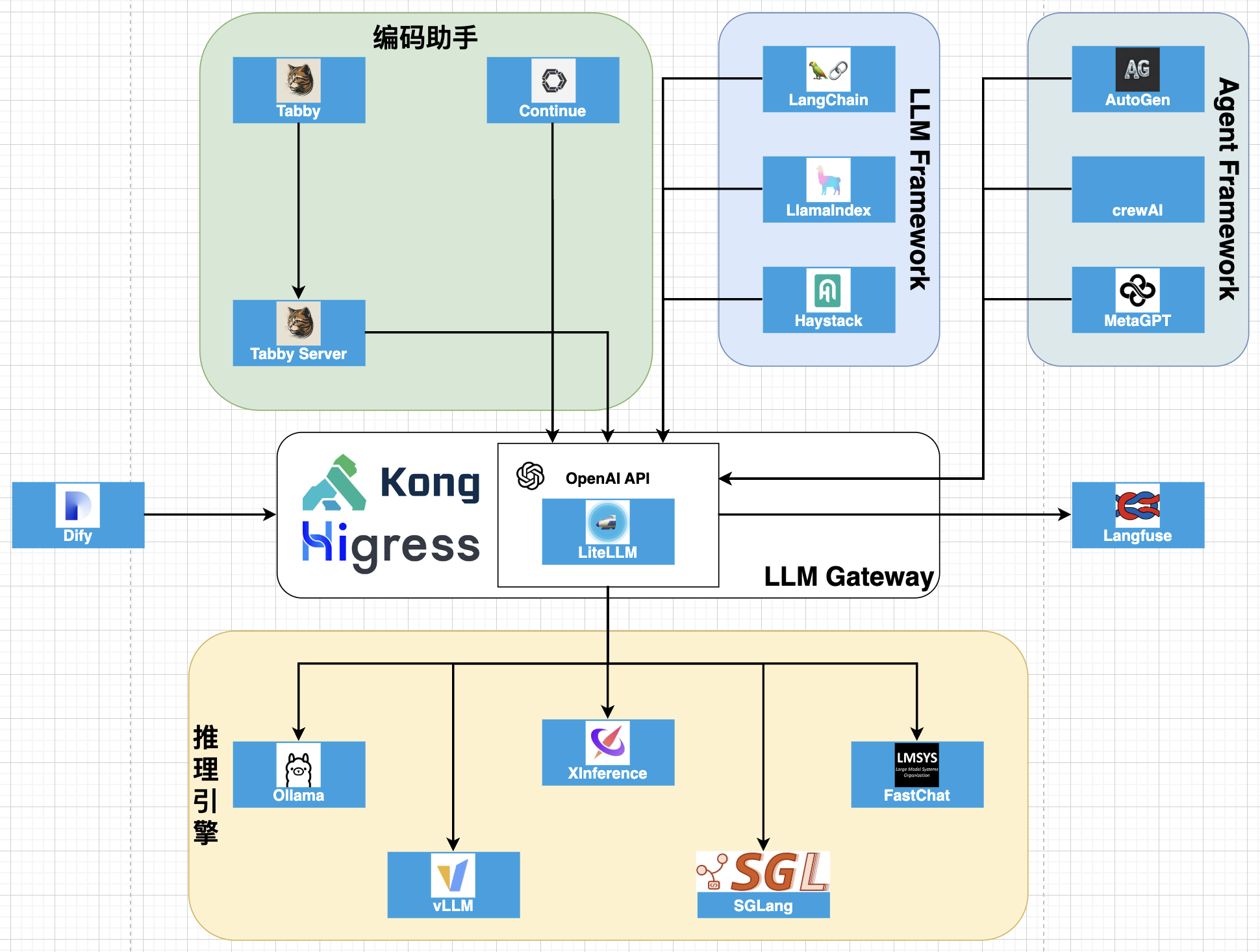

LLM 技术栈

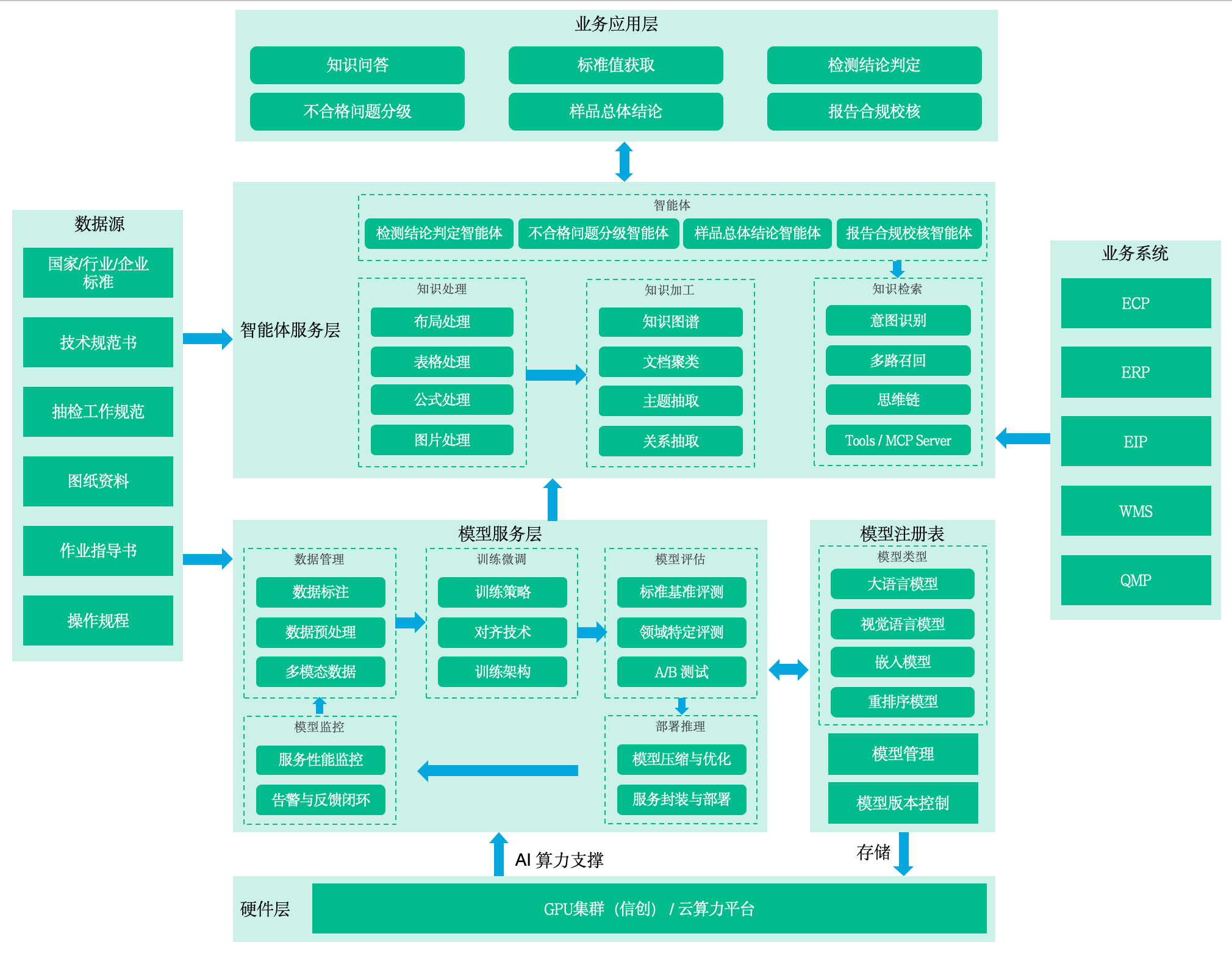

企业大模型架构

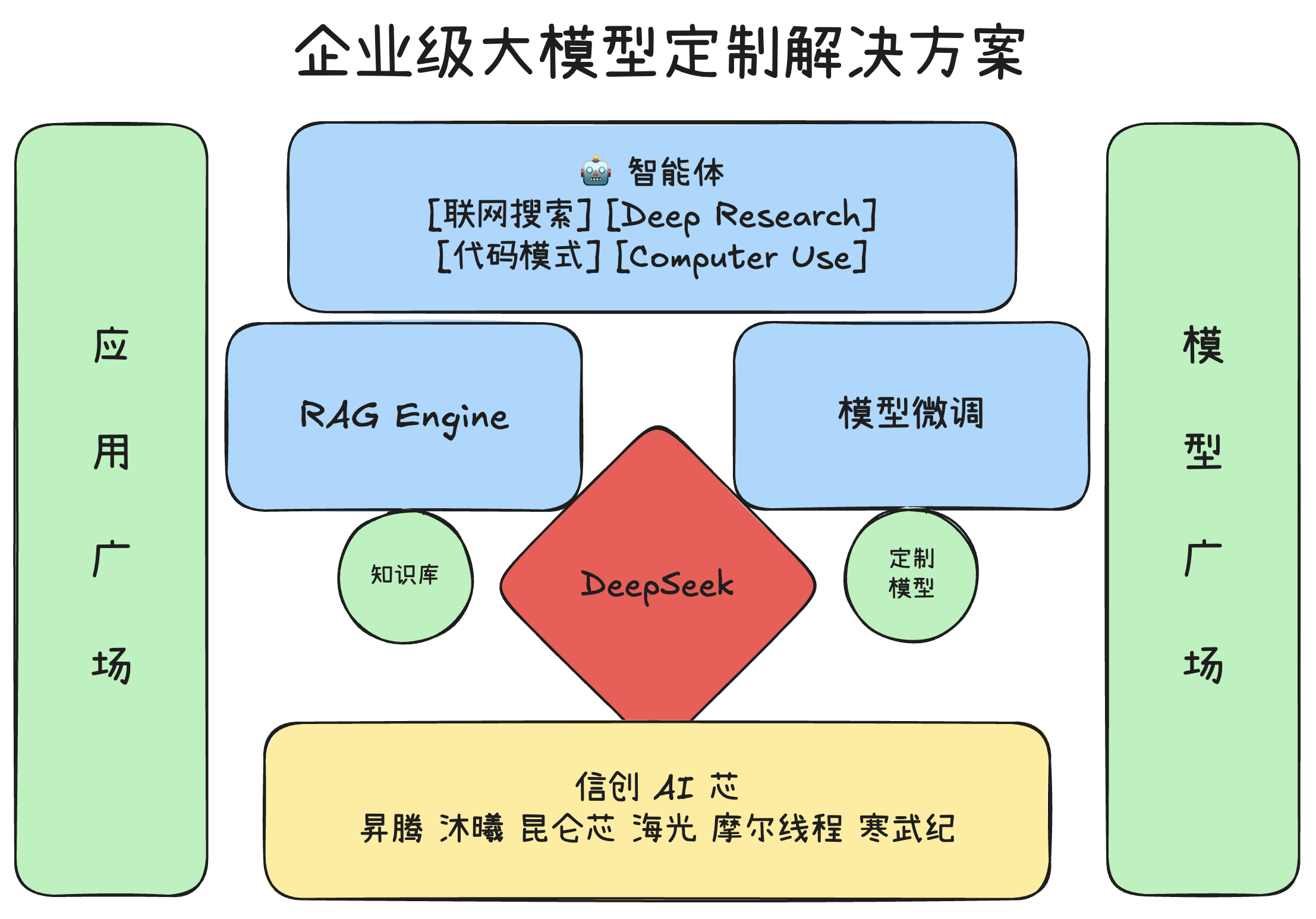

企业级大模型定制解决方案

软件栈

Jetson

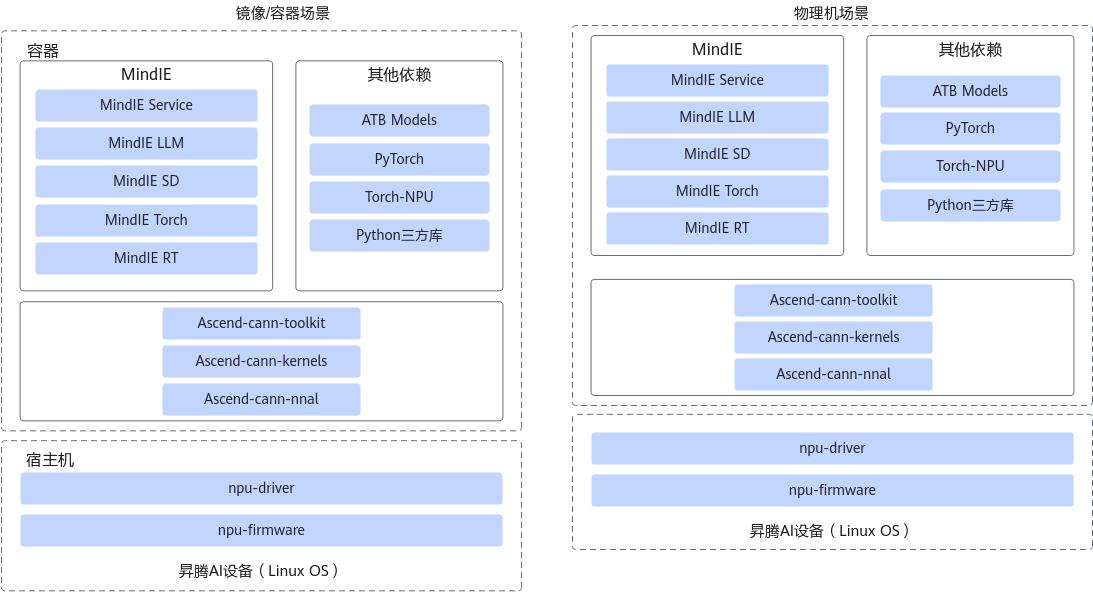

昇腾

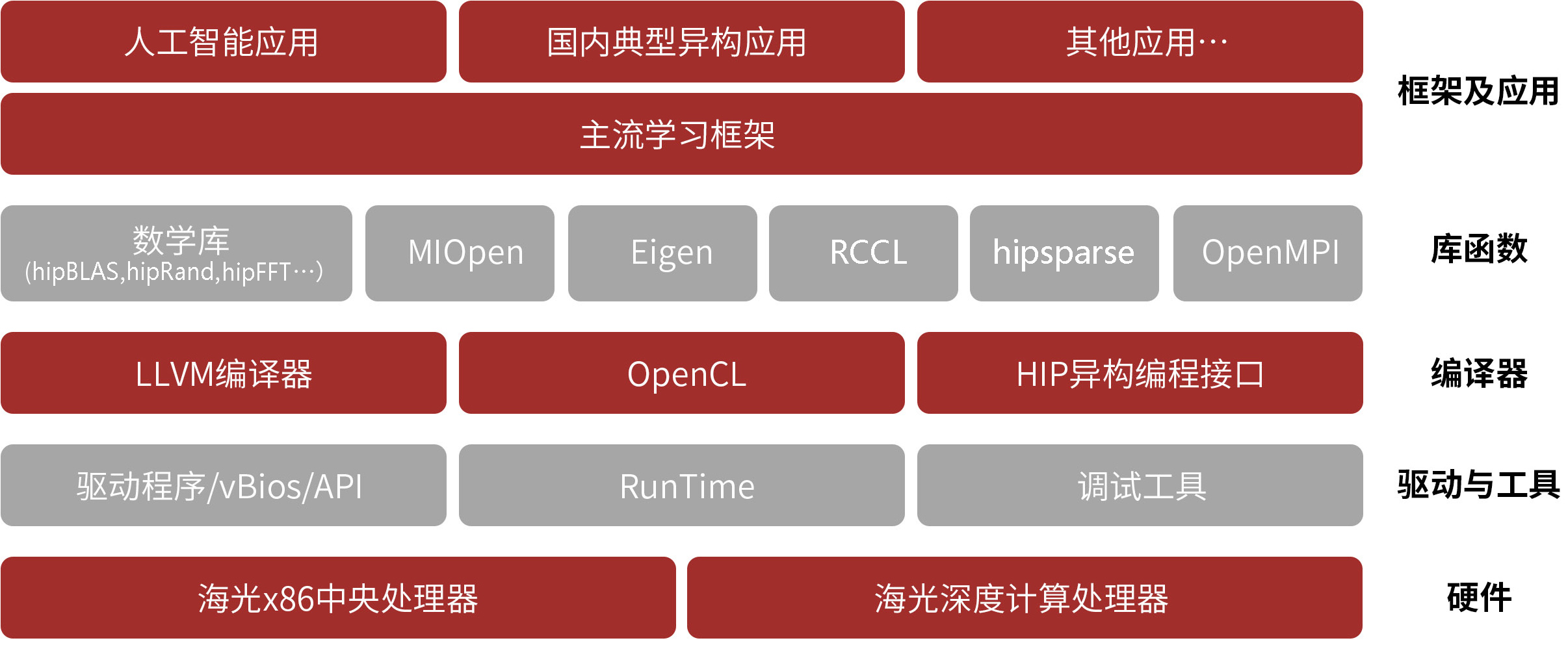

海光

沐曦

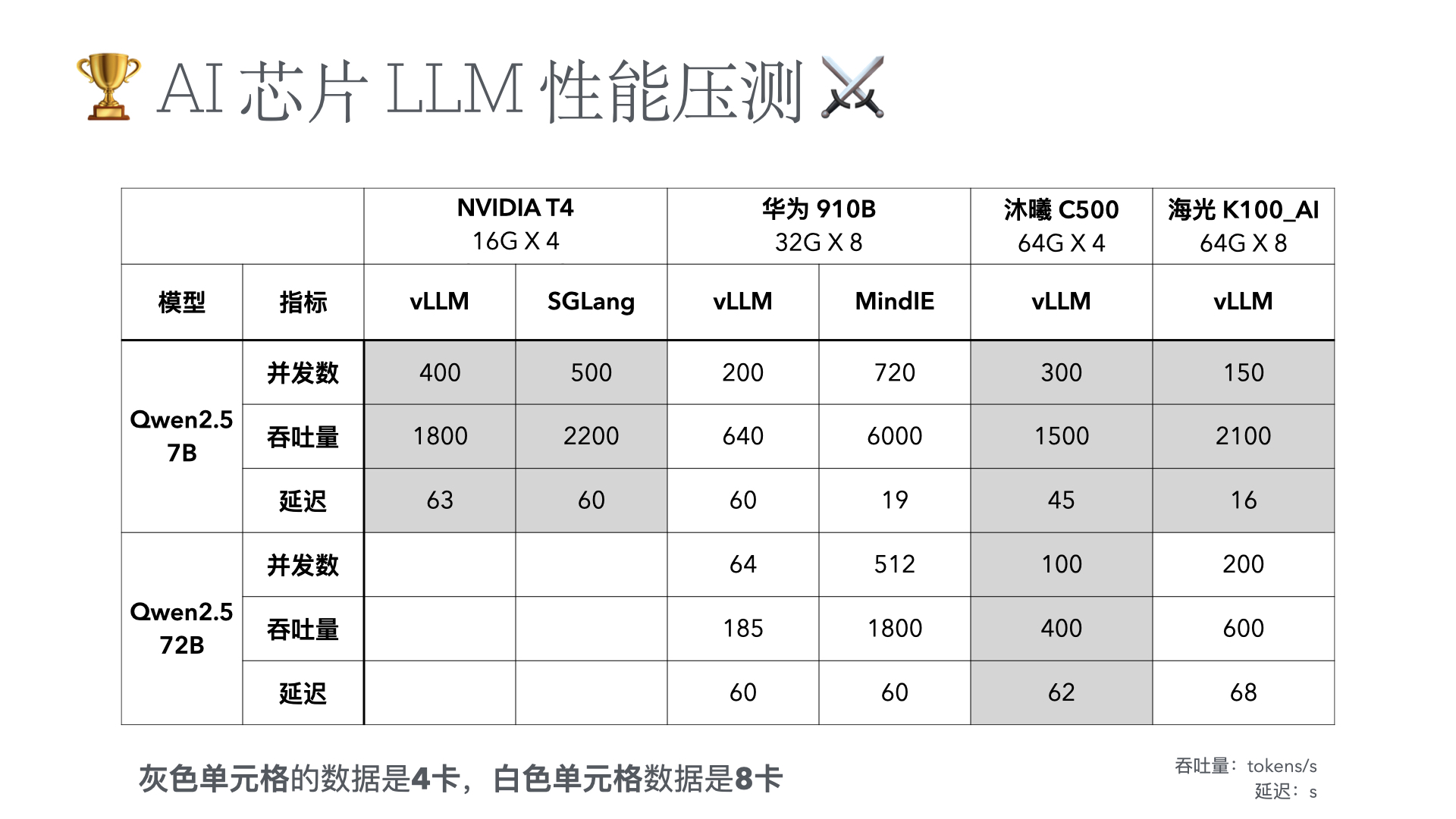

LLM 压测性能

AI 工具

聊天助手

编码助手

编码 IDE

LLM 应用框架

智能体框架

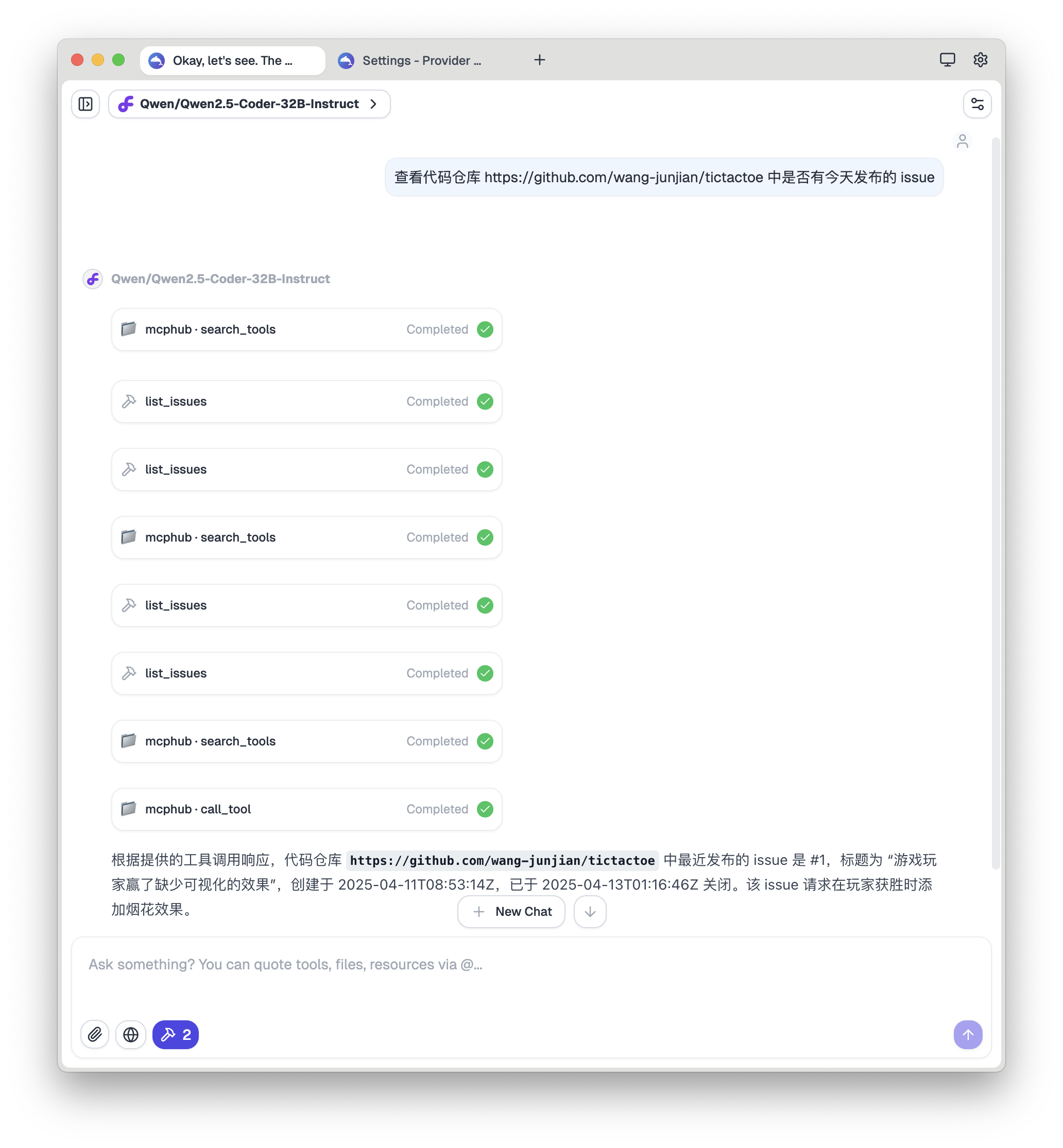

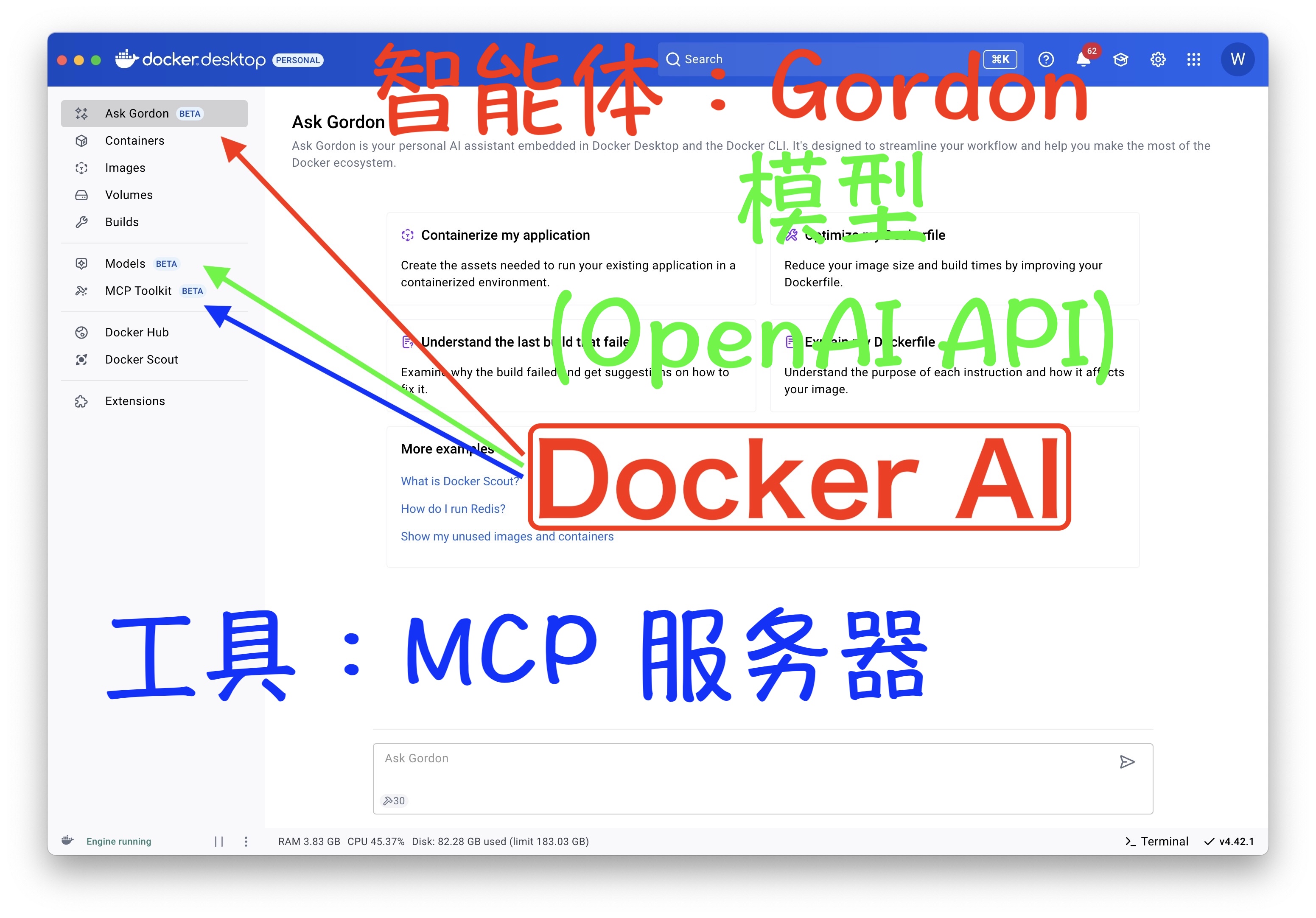

智能体应用

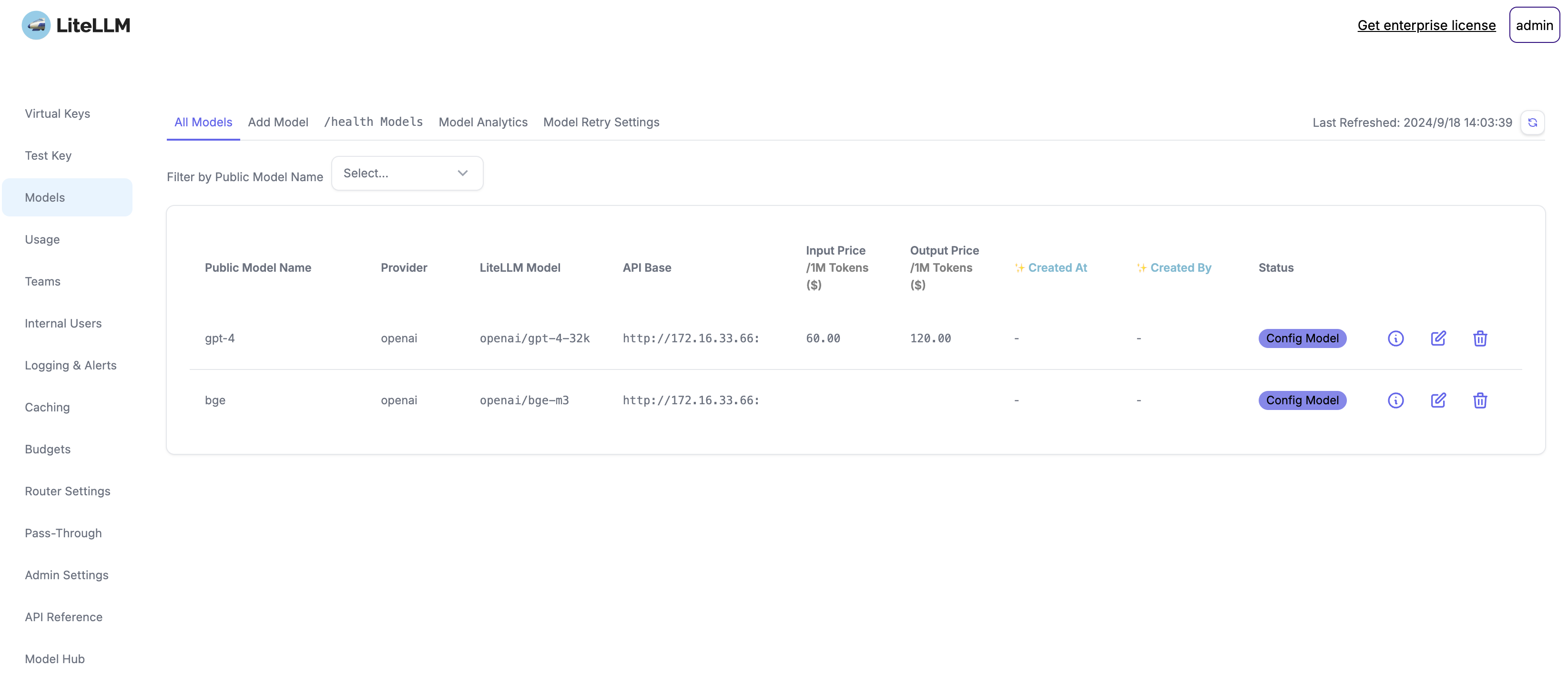

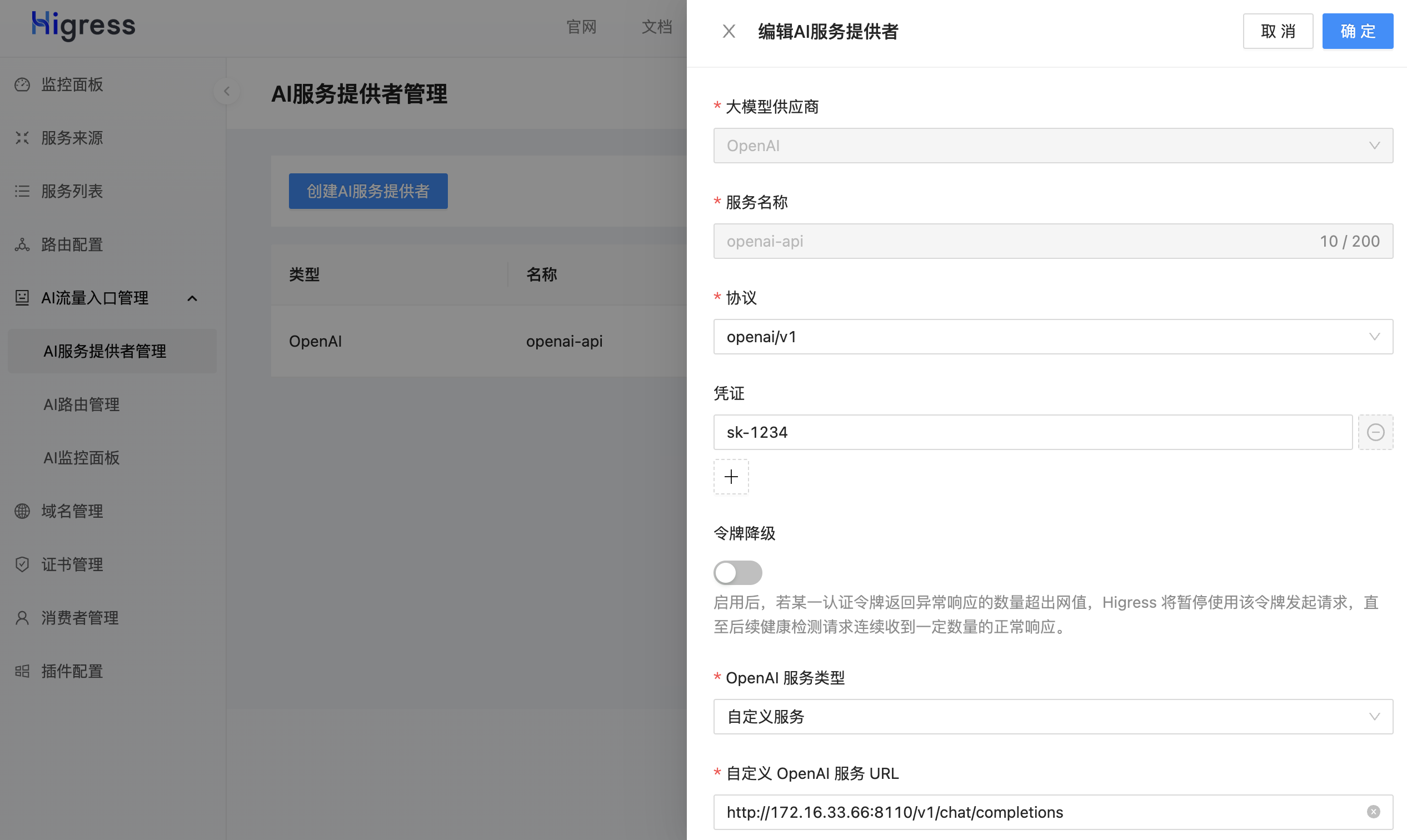

AI 网关

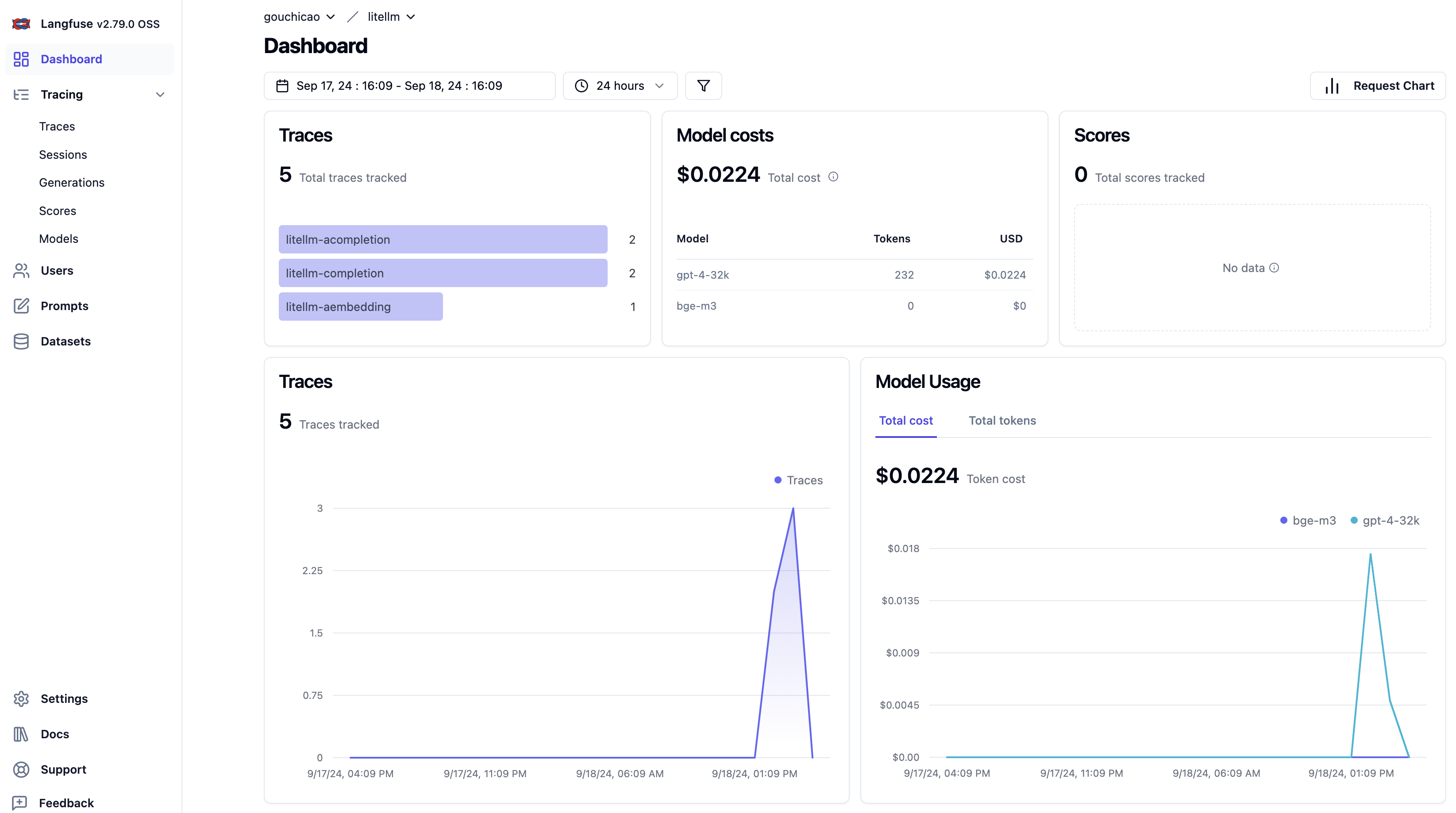

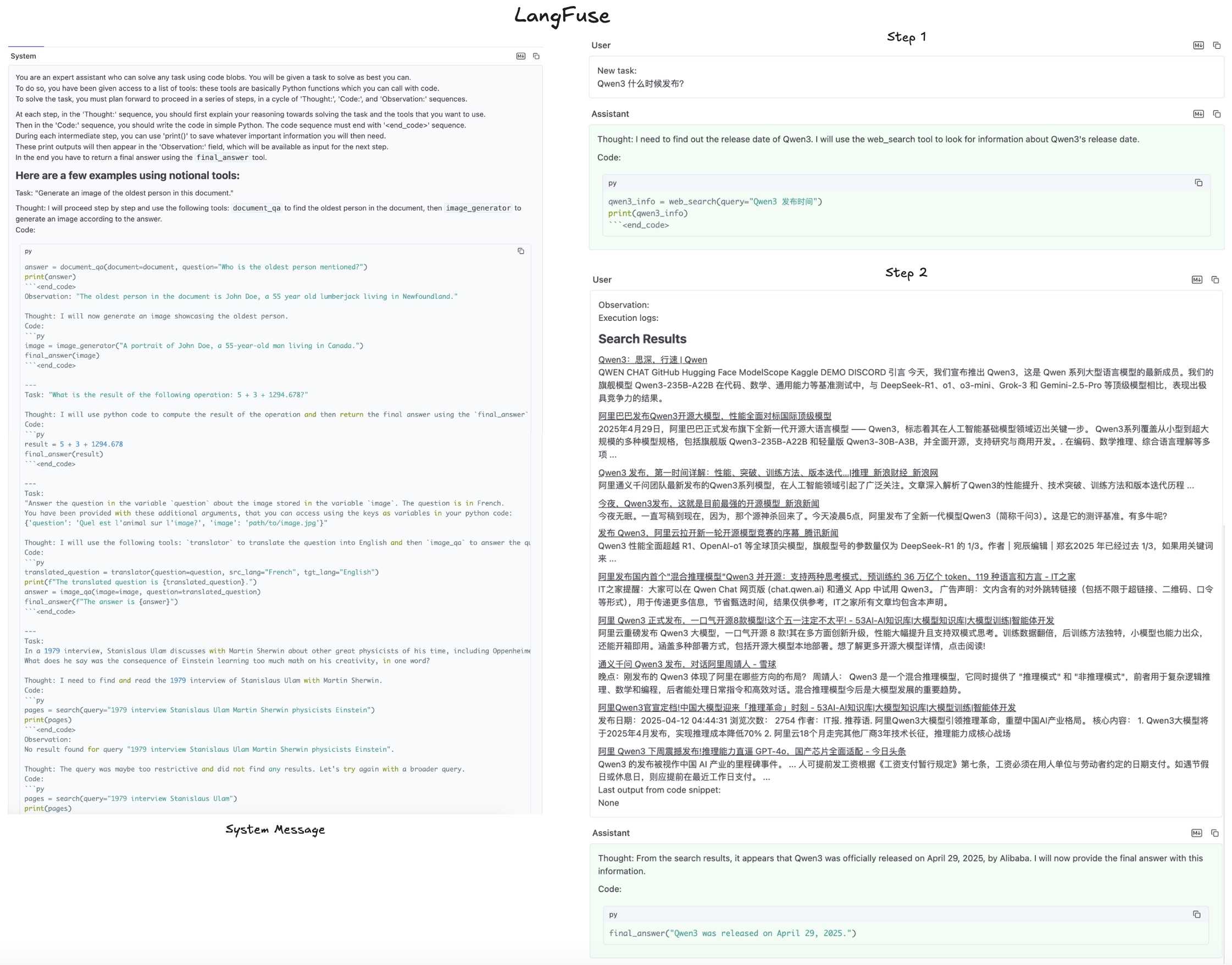

LLM 监控平台

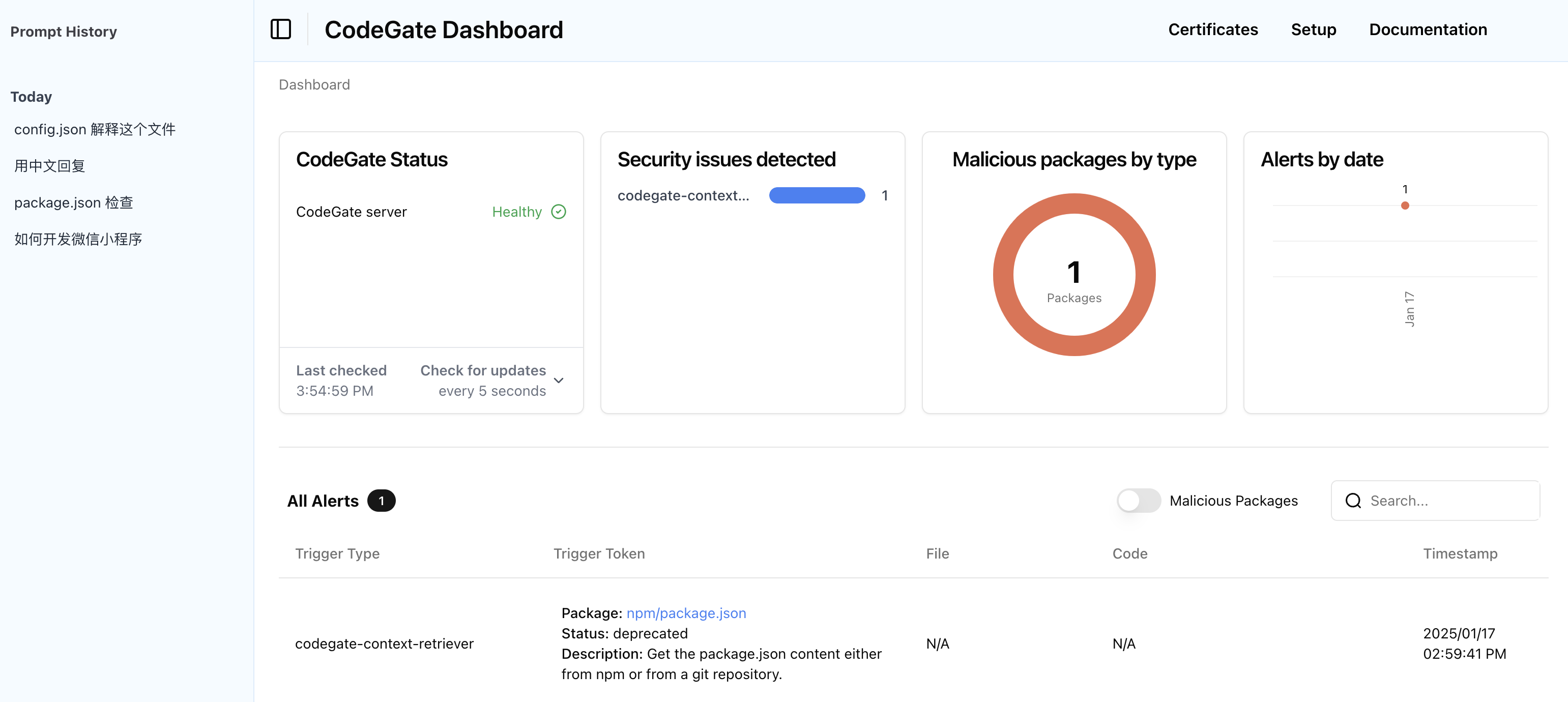

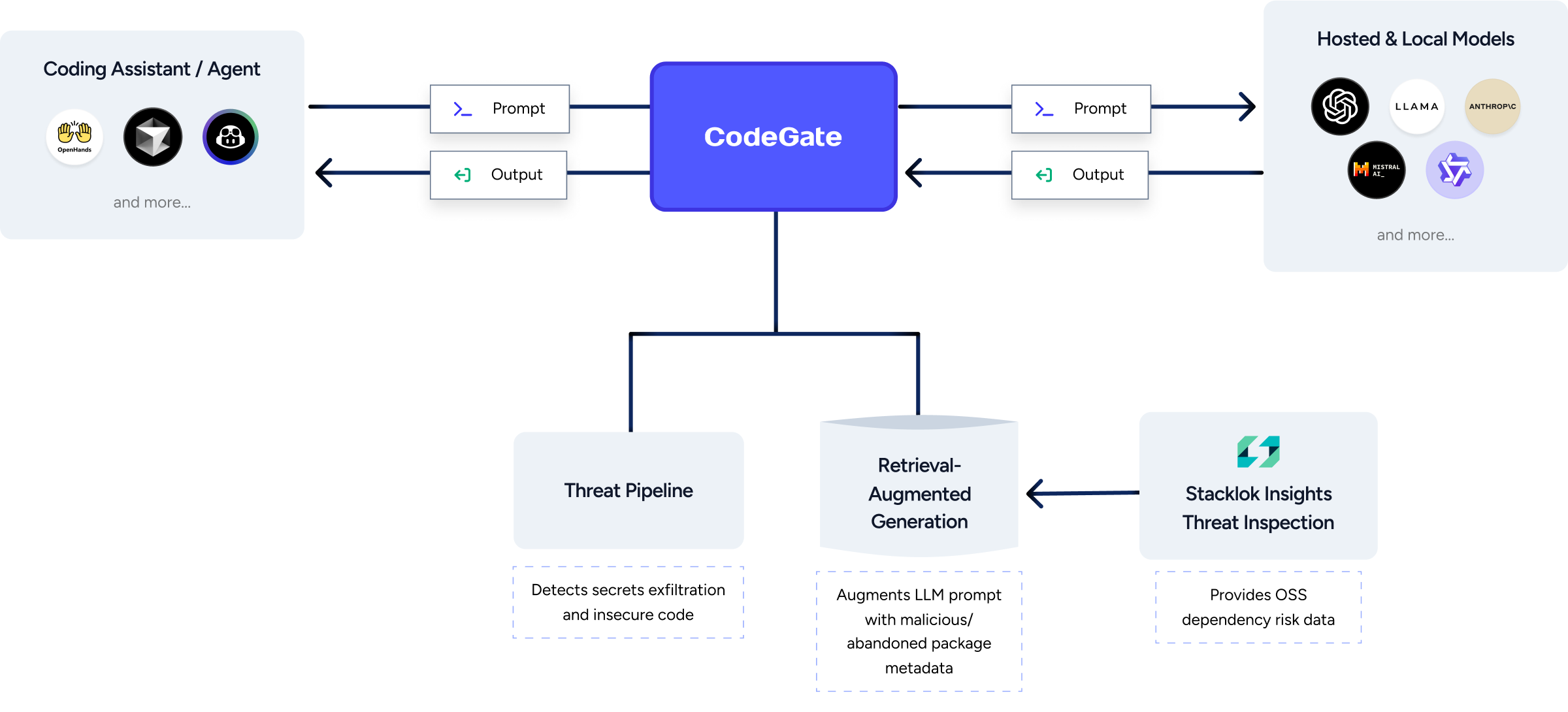

代码网关

LLM 工具

数据集生成

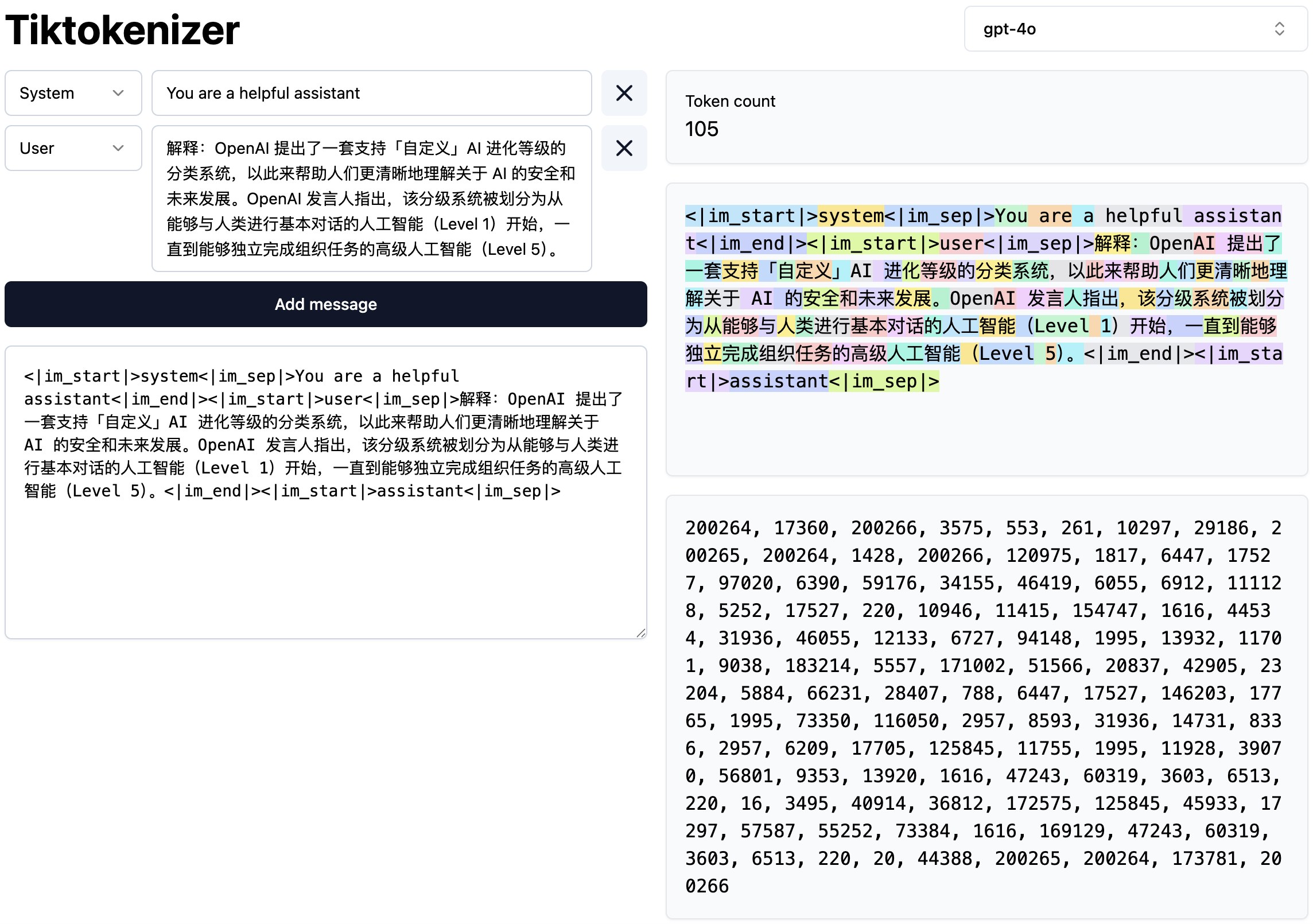

分词器

推理引擎

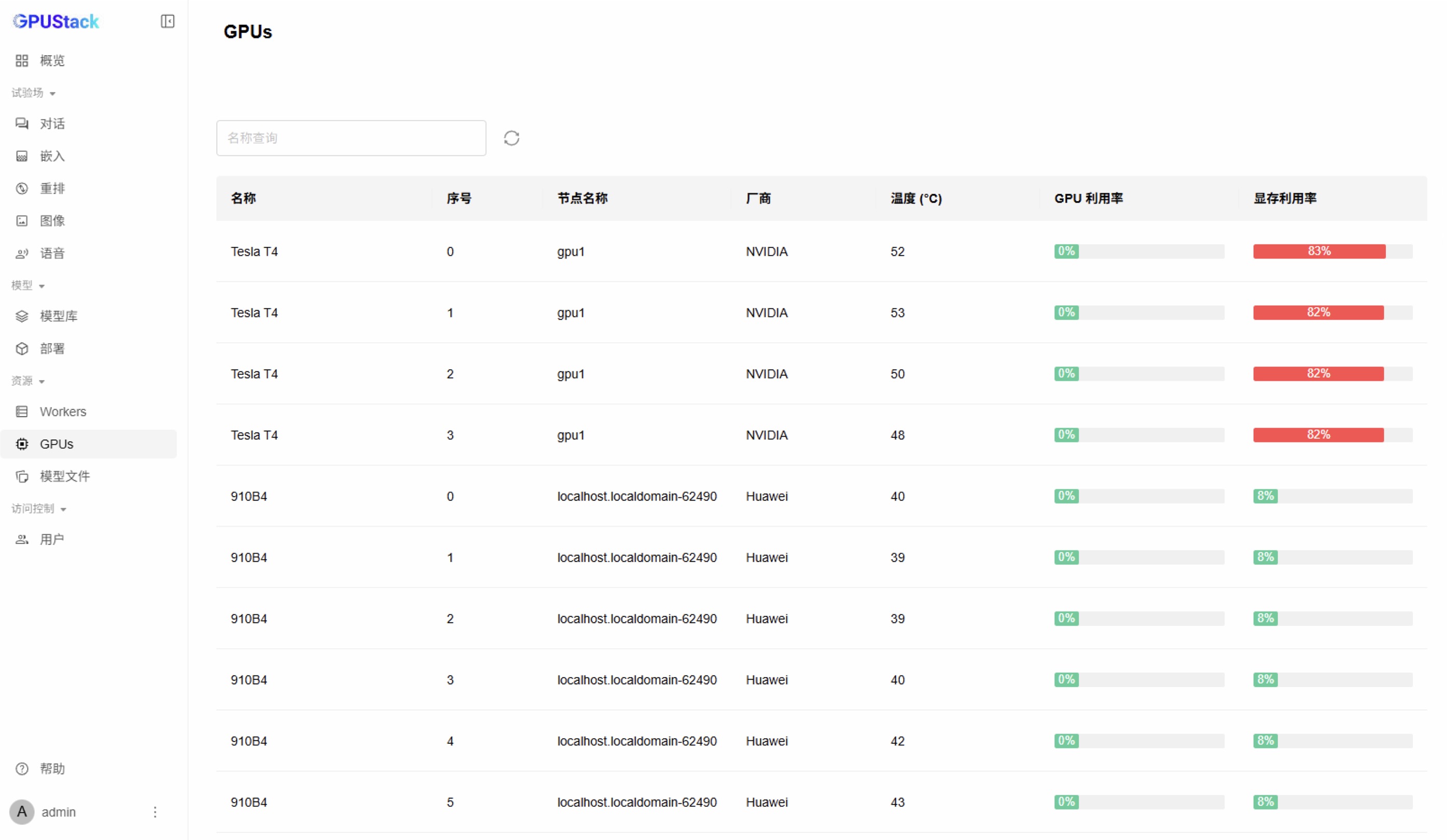

GPU 集群管理器

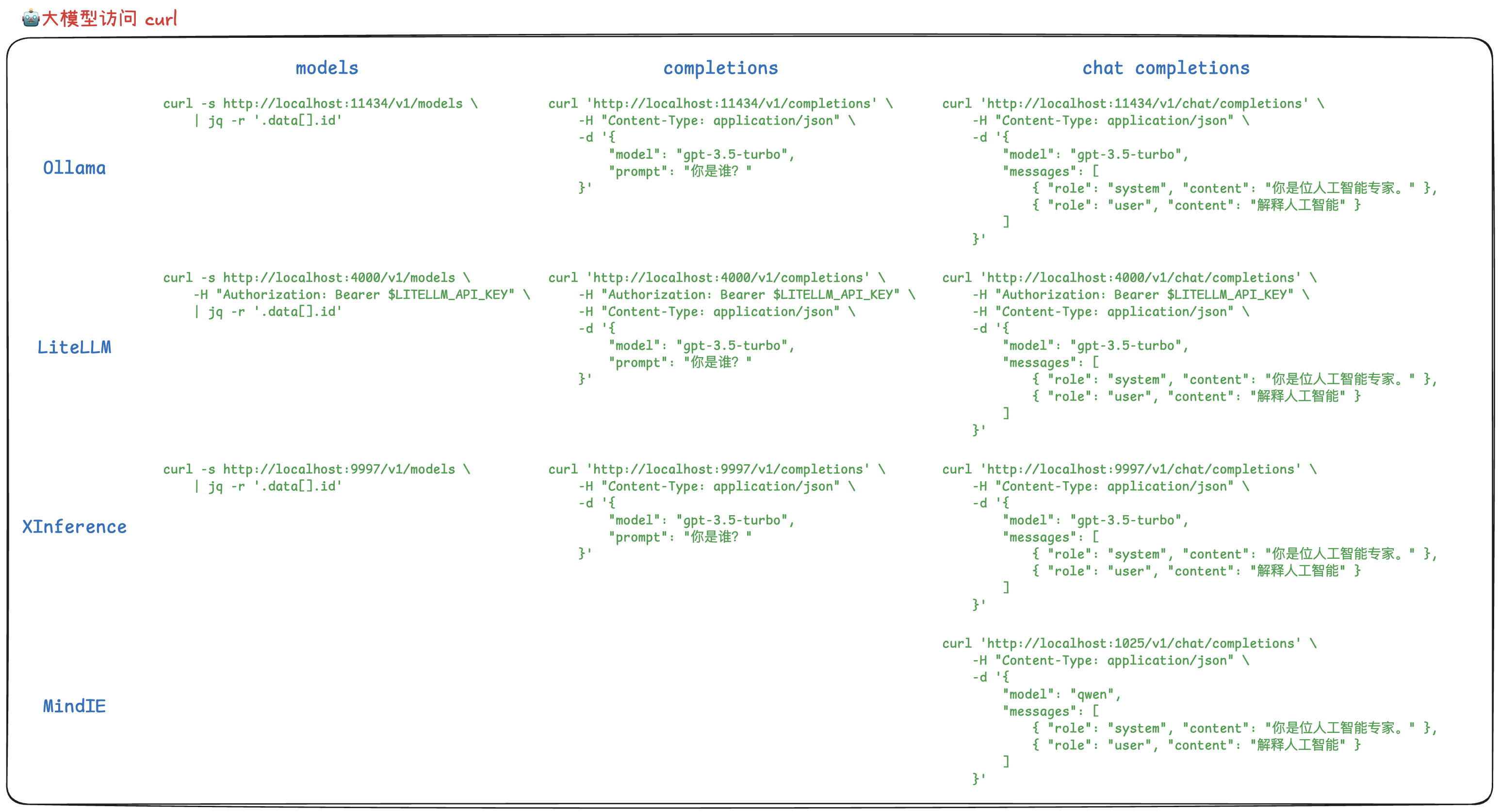

API 调用工具

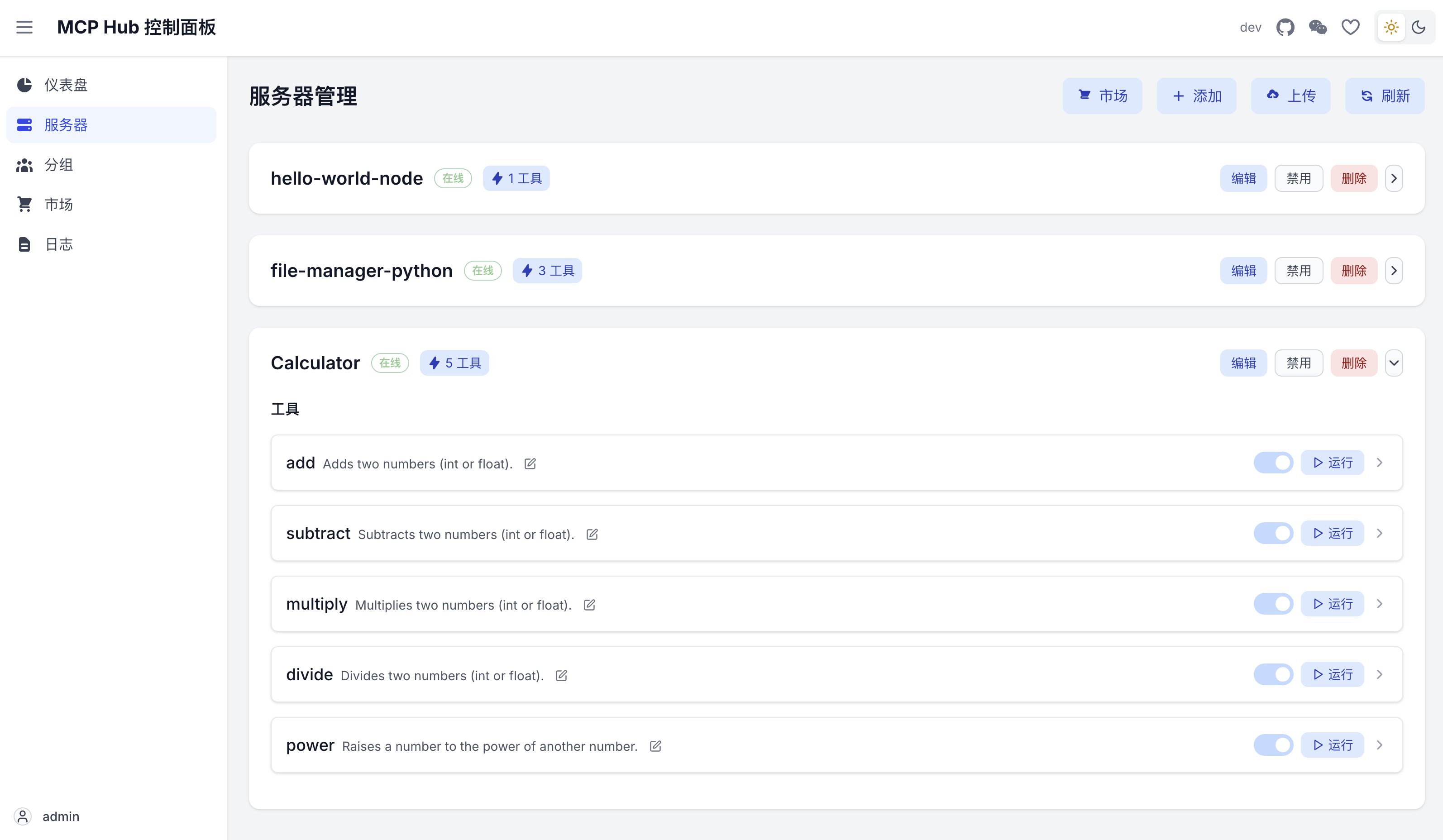

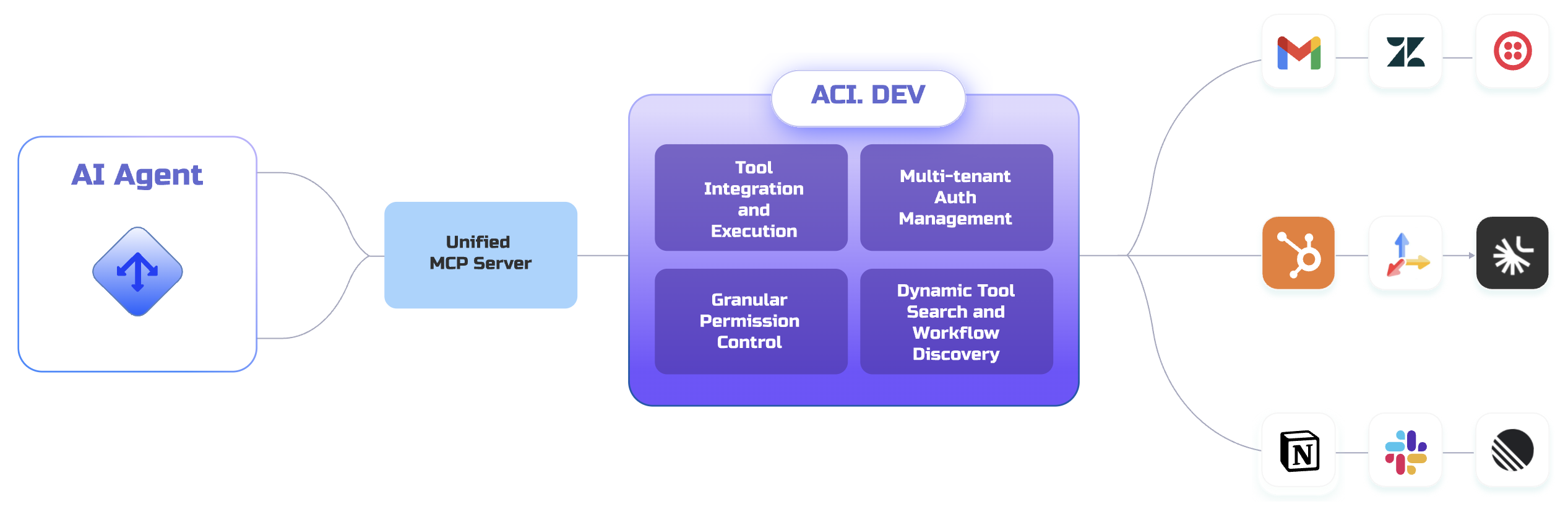

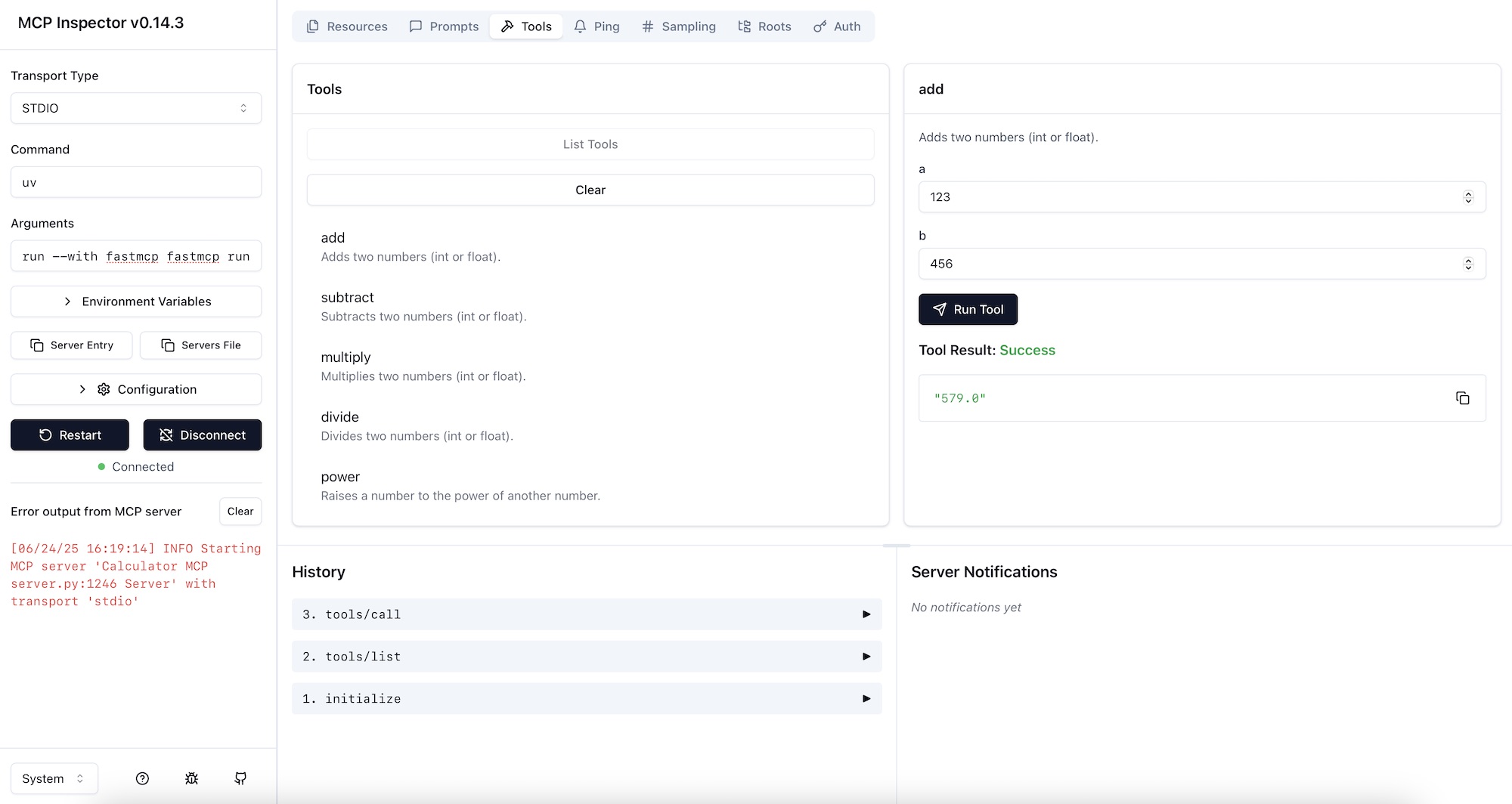

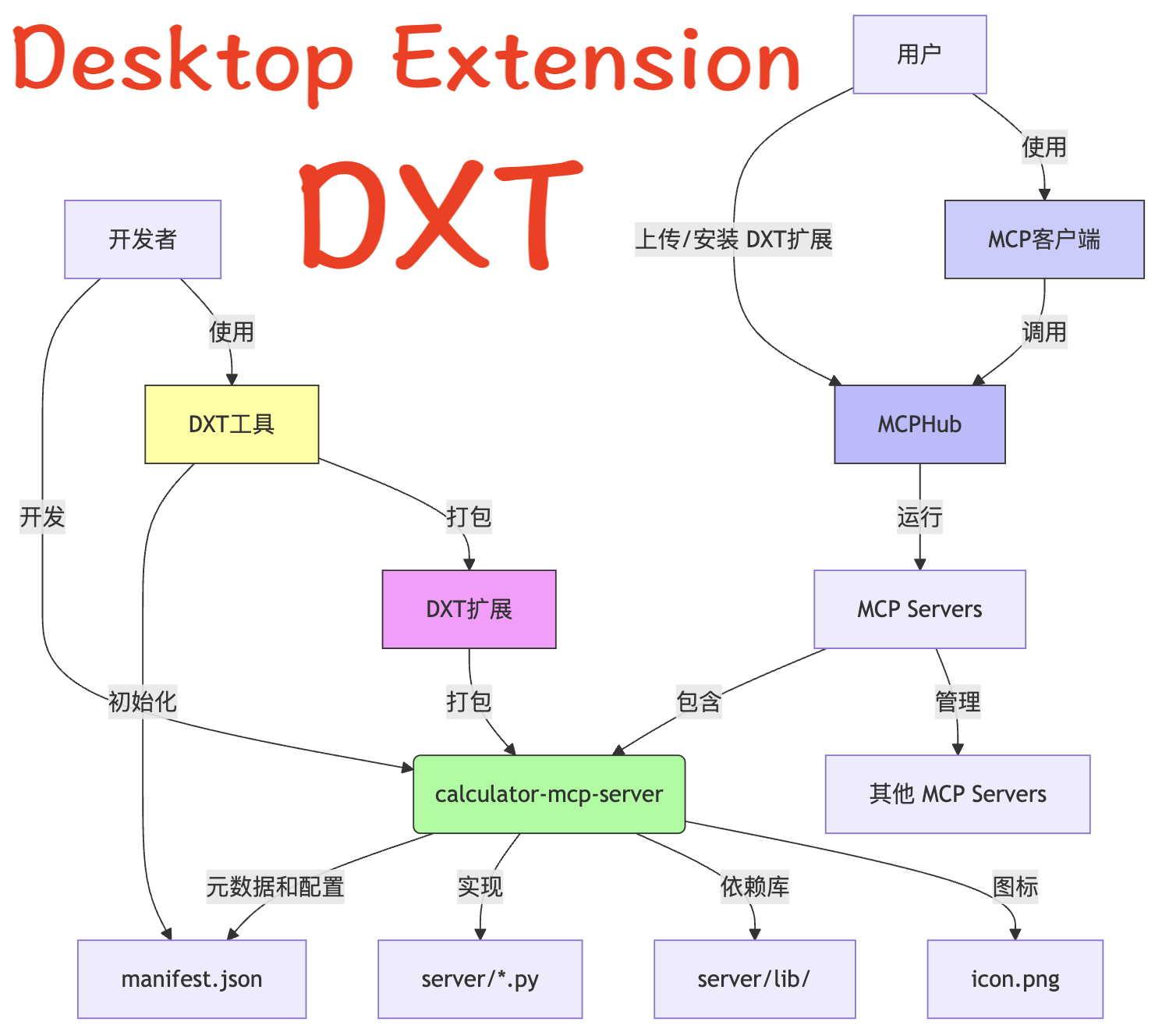

MCP Server

聚合平台

调试工具

打包工具

网页截图

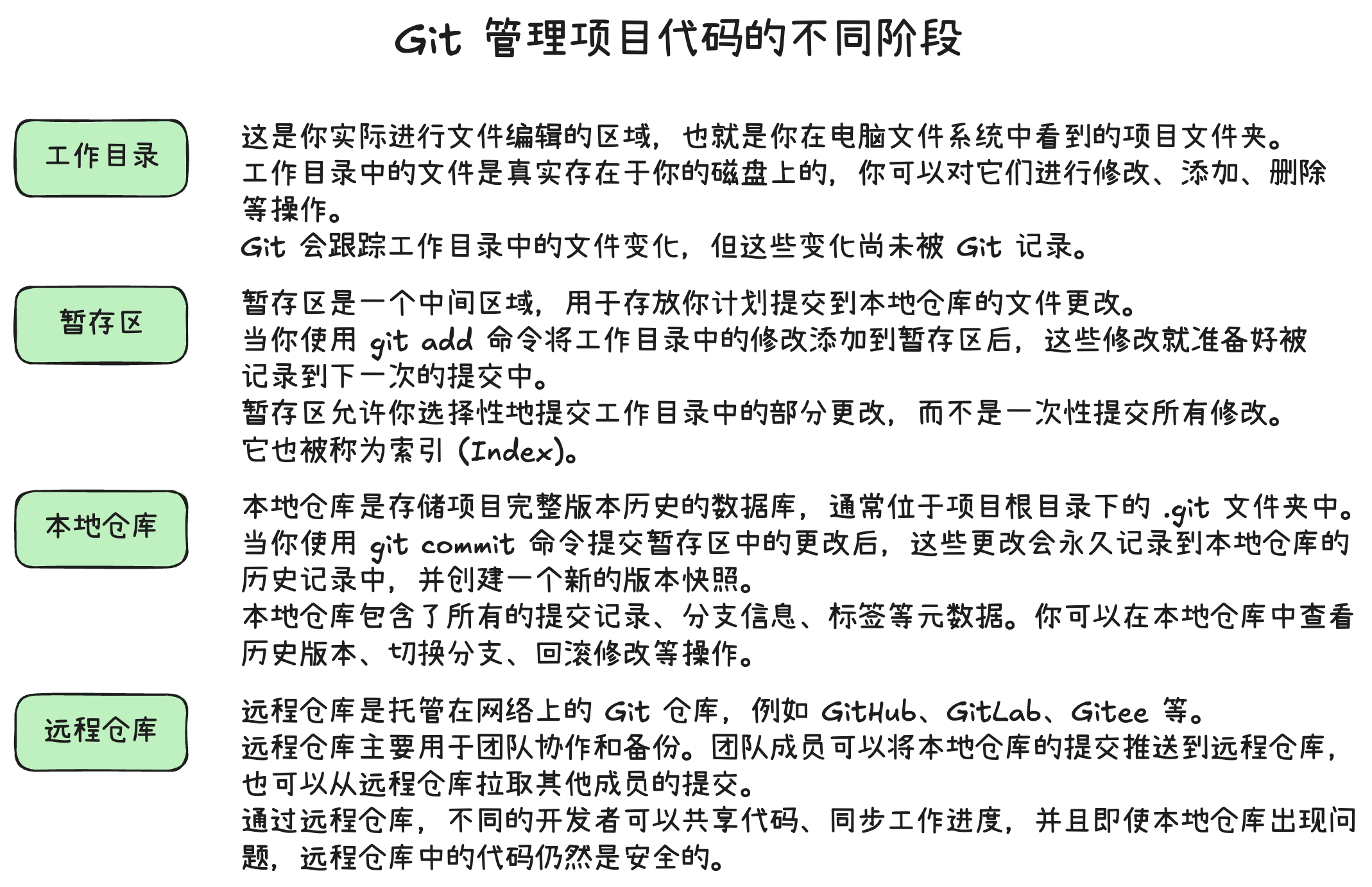

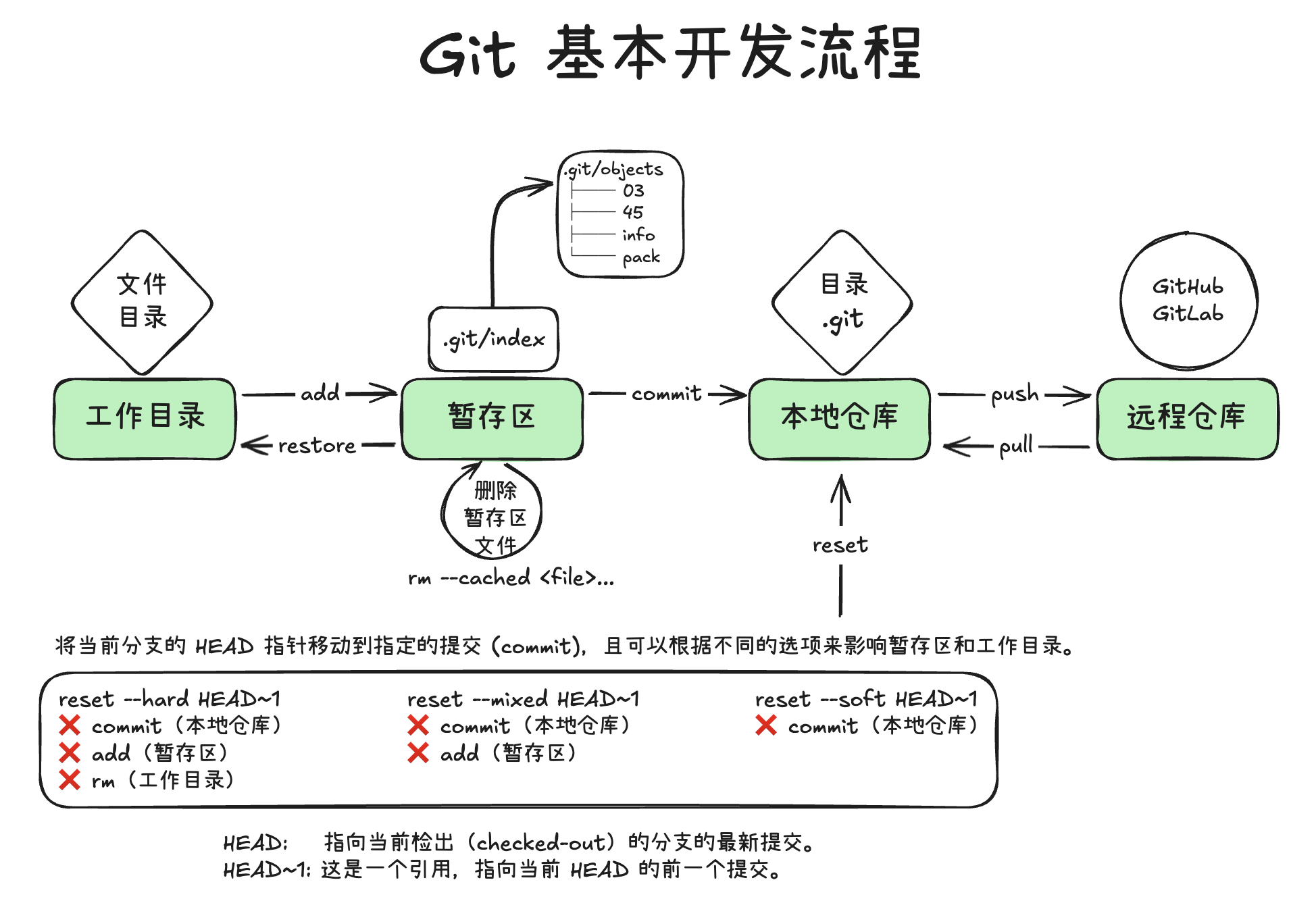

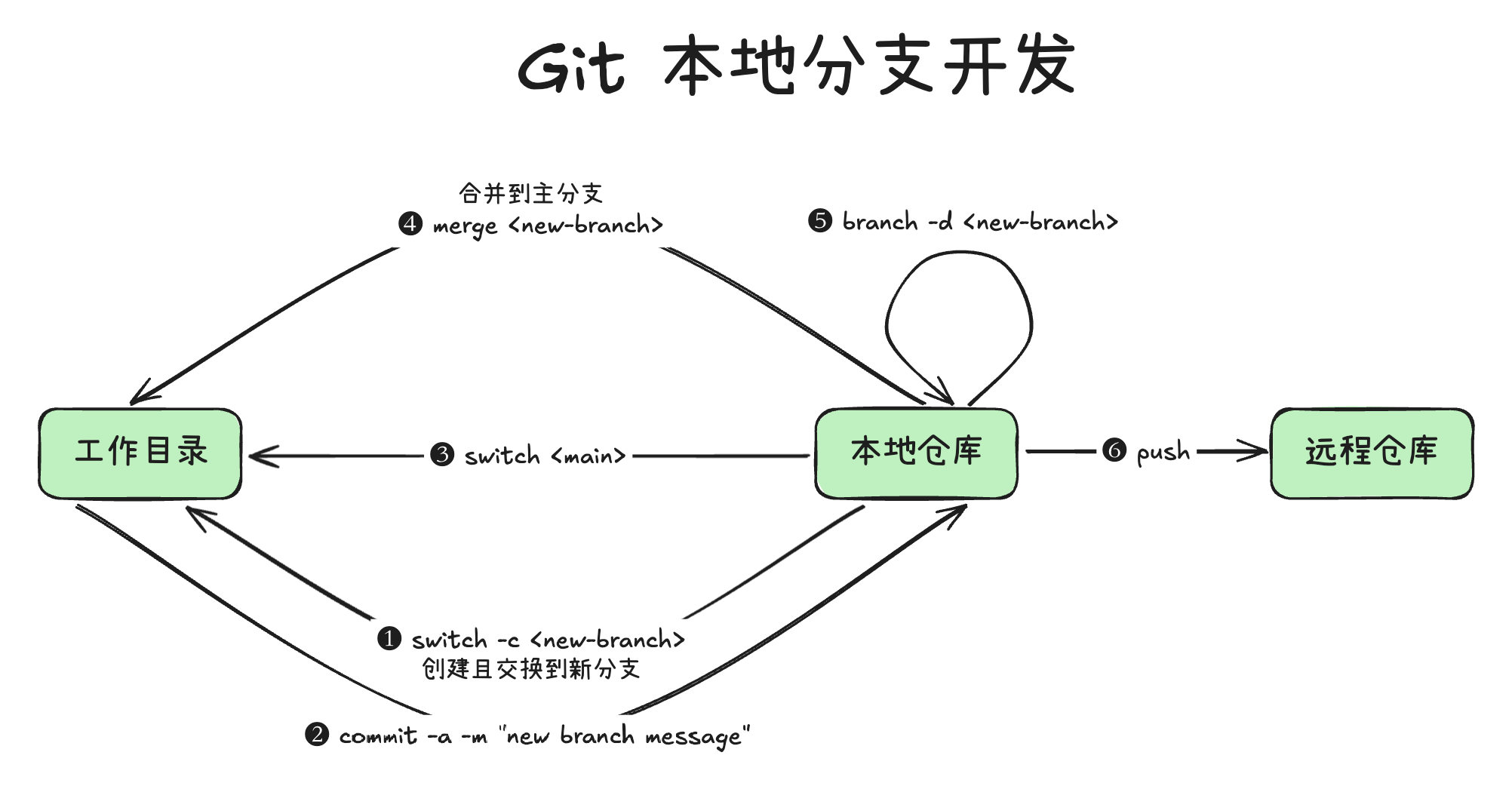

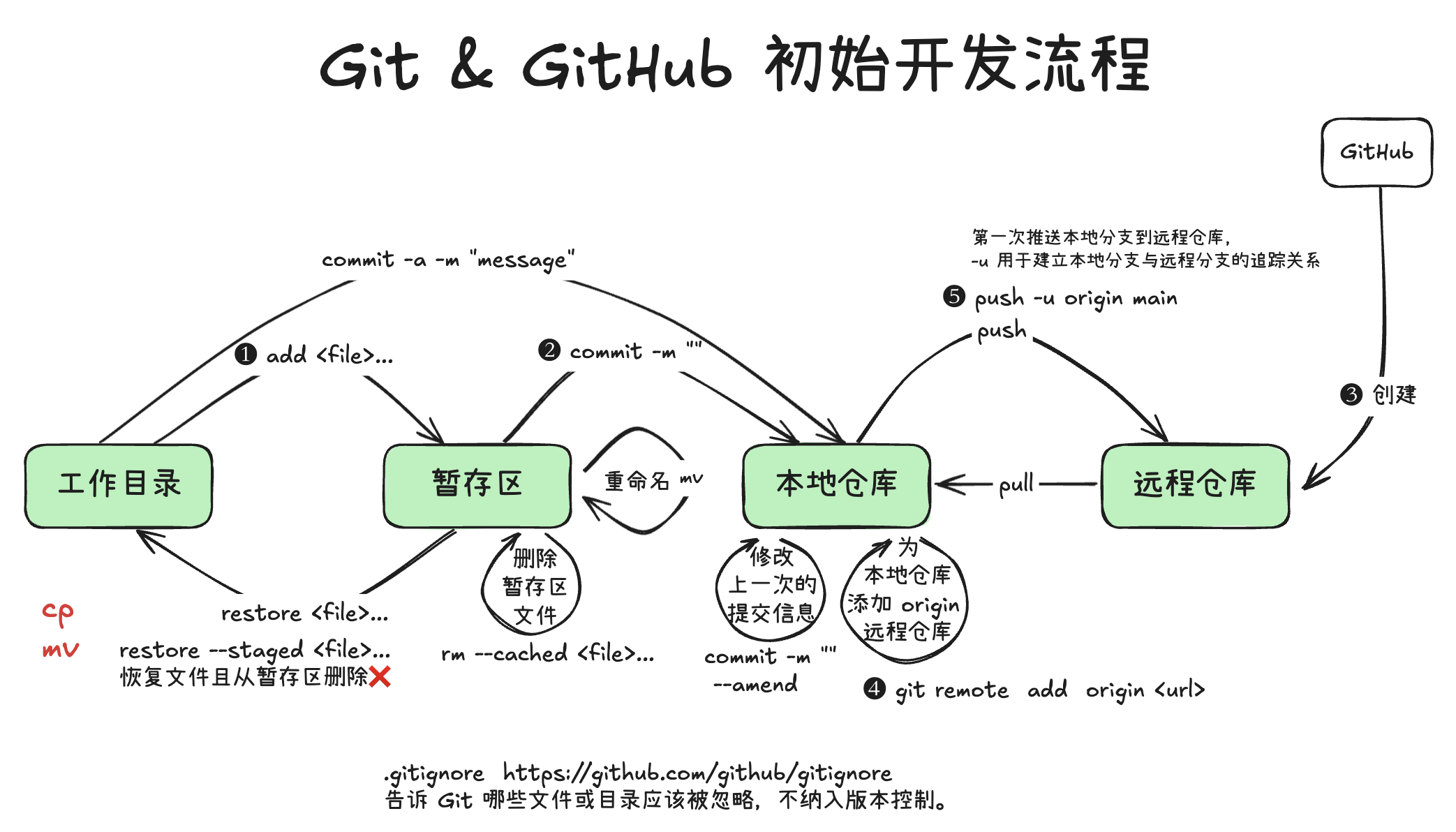

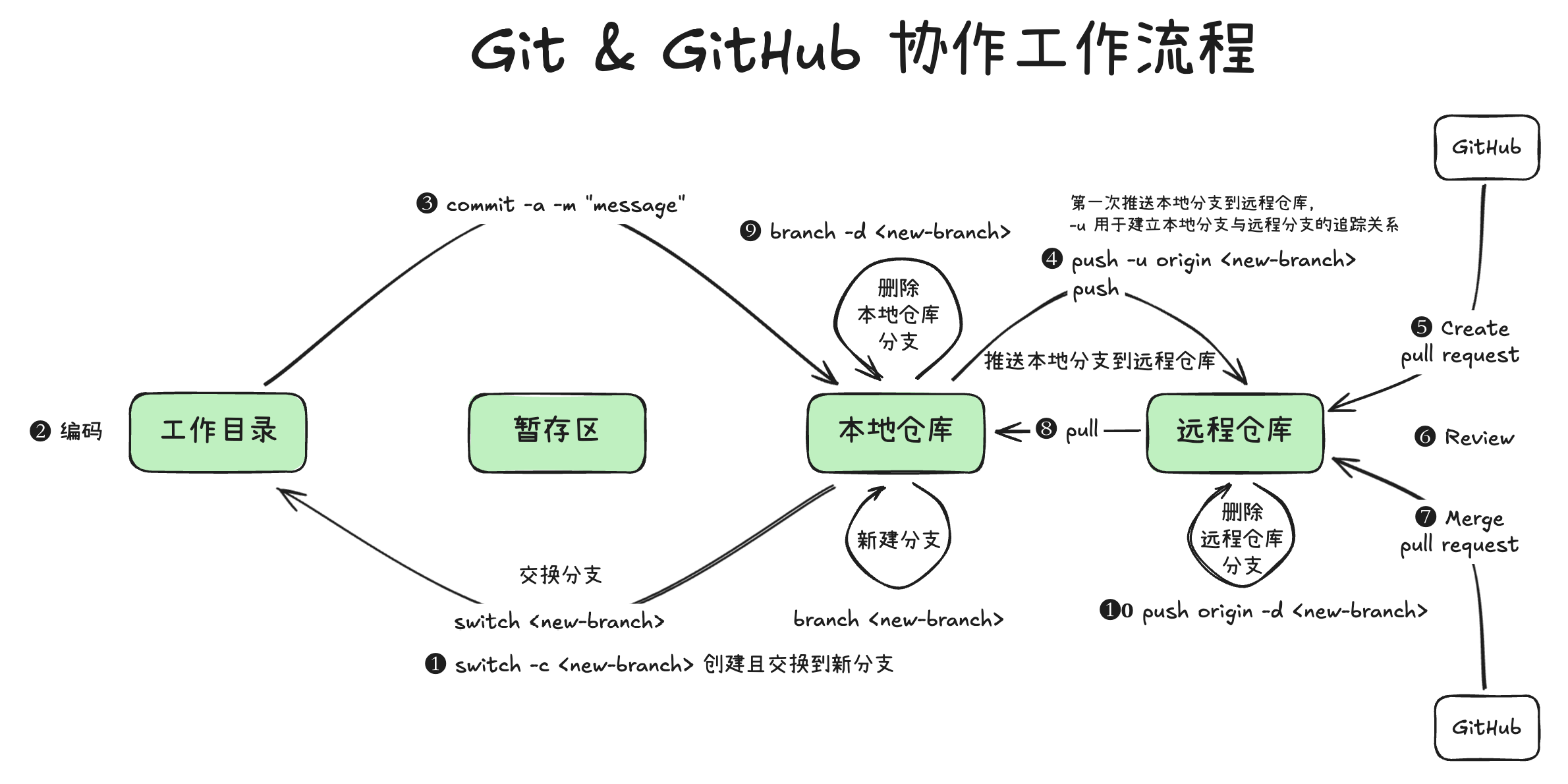

Git 开发

提示词

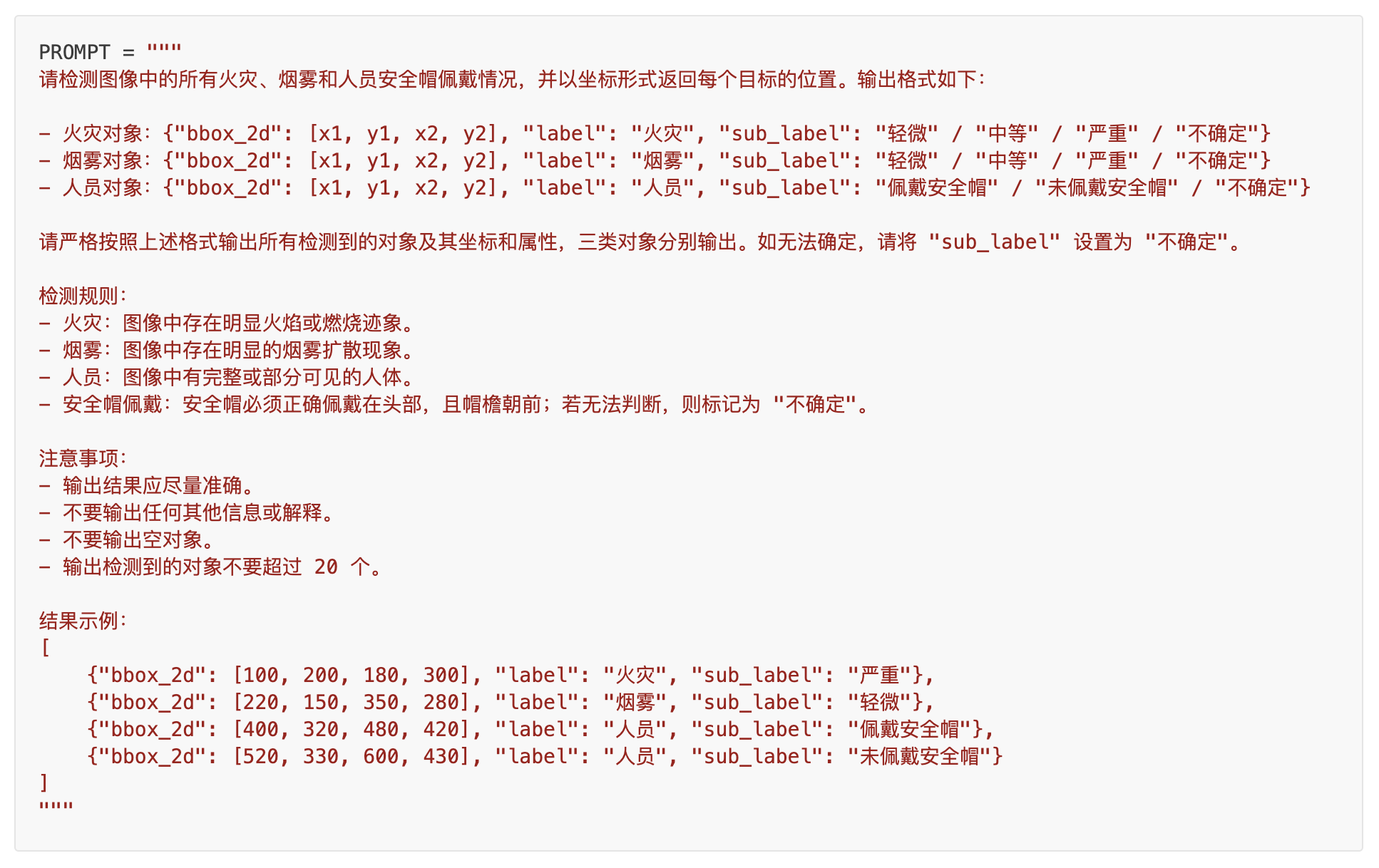

火灾安全检测系统(Qwen2.5-VL)

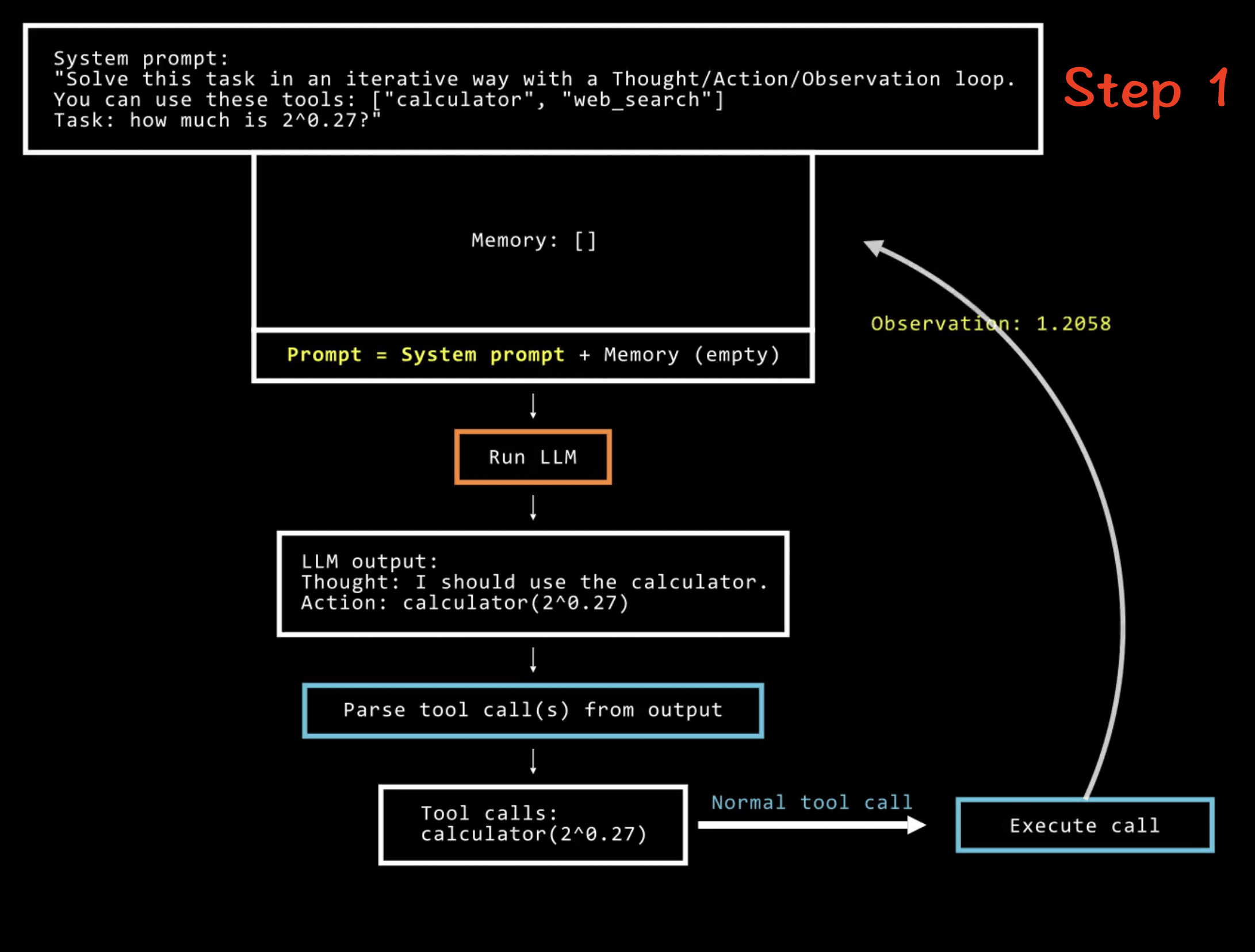

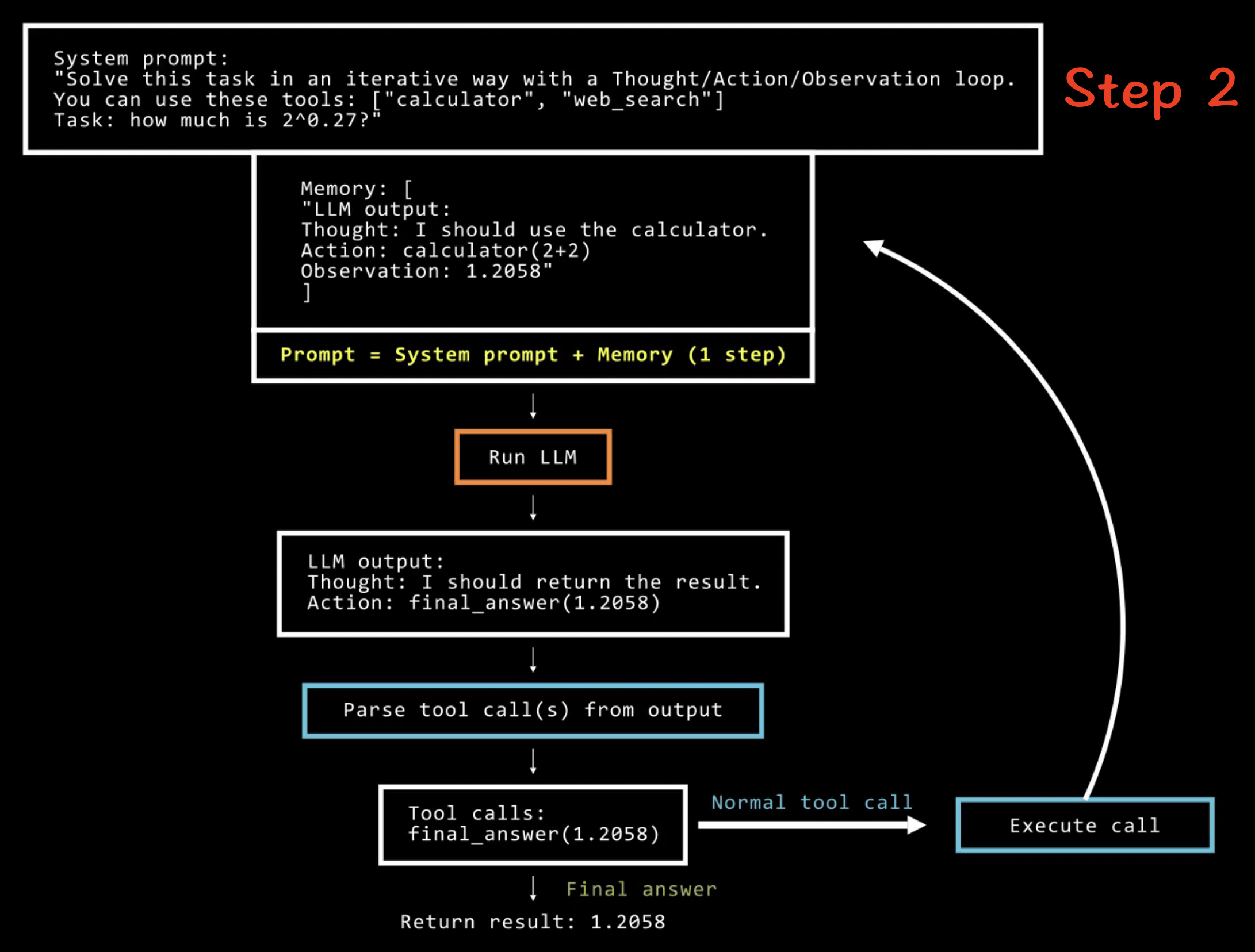

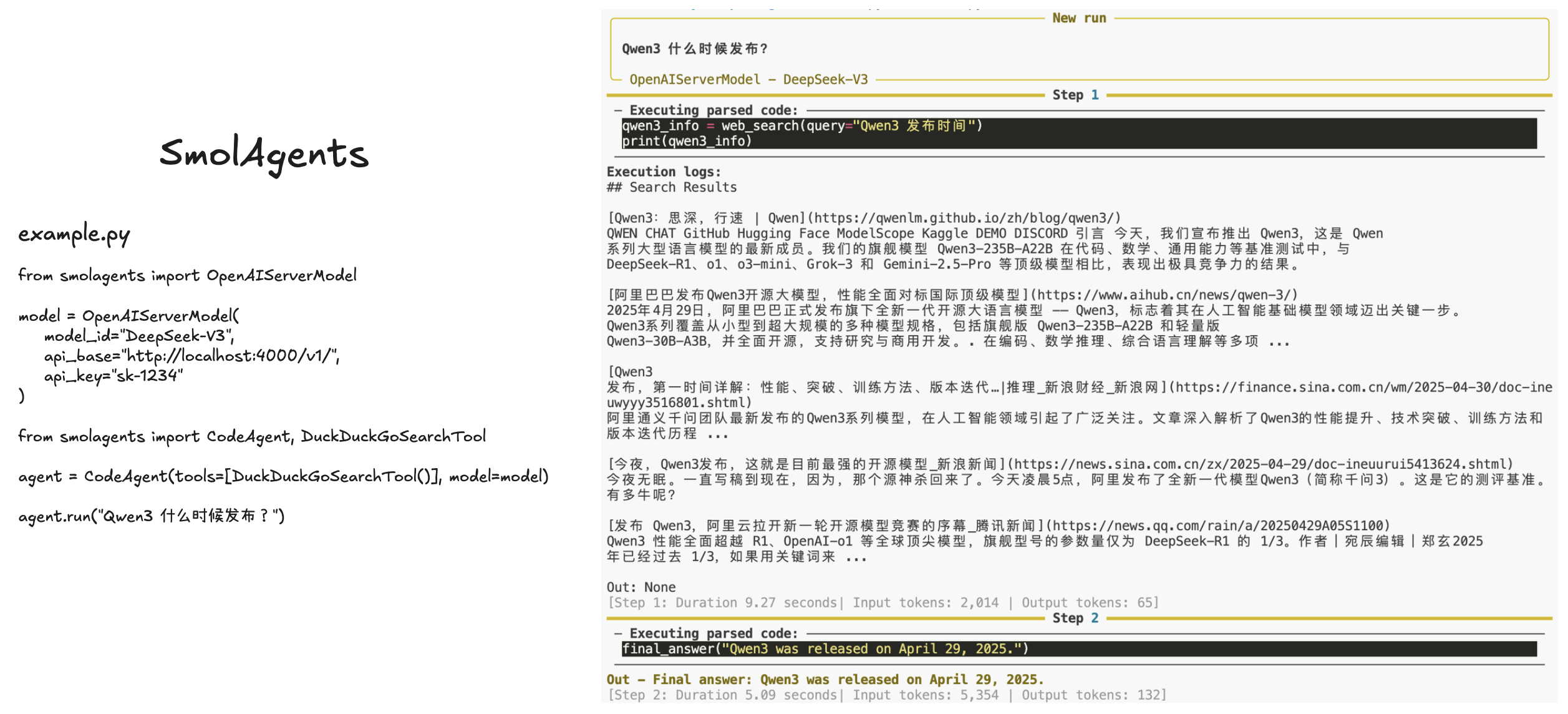

SmolAgents

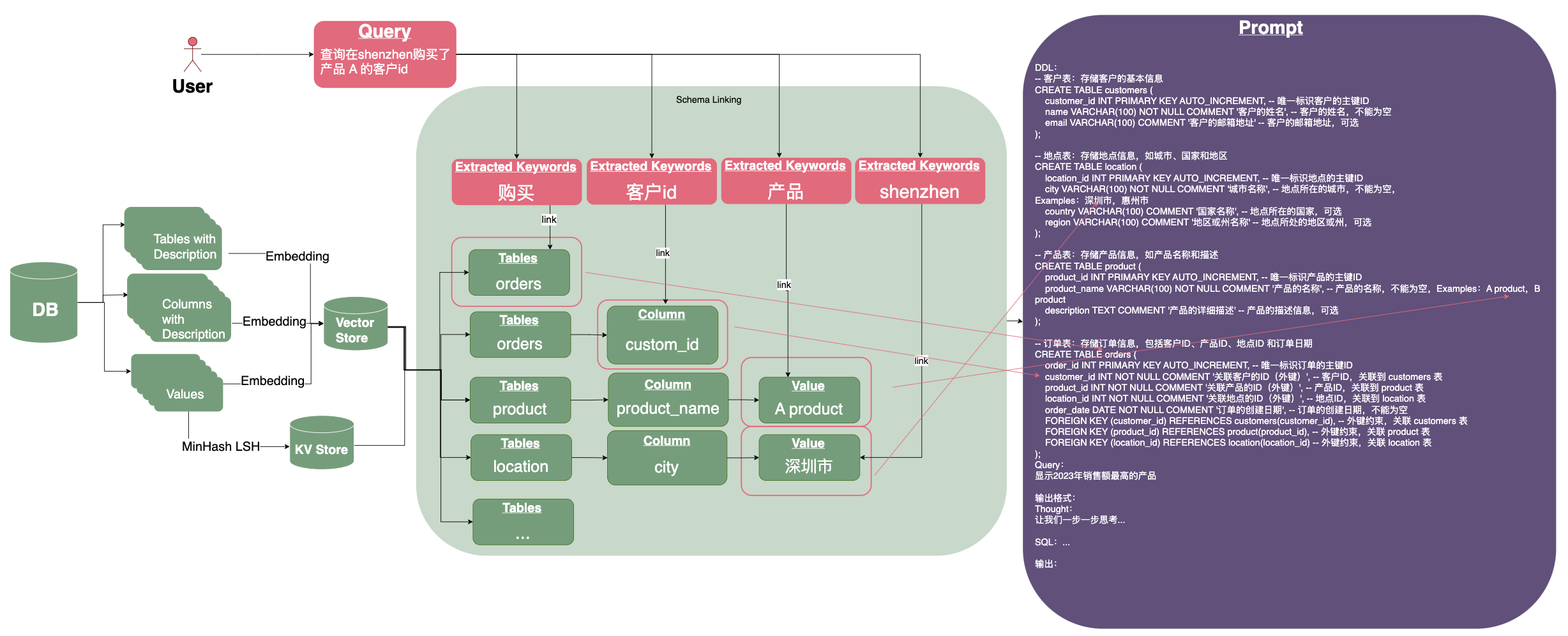

Text2SQL