← 返回幻灯片列表

大模型技术

大模型技术

◆

说明

- 📝 - arXiv

- 😺 - GitHub

- 🤗 - Hugging Face

◆

OPT: Open Pre-trained Transformer Language Models

这是一套仅包含解码器的预训练 Transformer,大小从 125M 不等 到 175B 参数。训练 OPT 模型以大致匹配 GPT-3 类模型的性能和规模。

训练数据:BookCorpus, CC-Stories, The Pile, Pushshift.io Reddit, CCNewsV2 。最终的训练数据包含 180B 个 token,对应 800GB 的数据。验证分割由 200MB 的预训练数据组成,按比例采样预训练语料库中每个数据集的大小。

使用 GPT2 字节级版本的字节对编码 (BPE)(针对 Unicode 字符)和 词汇量为 50272。输入是 2048 个连续标记的序列。

175B 模型在 992 个 80GB A100 GPU 上进行训练。训练持续时间约为 33 天左右。

◆

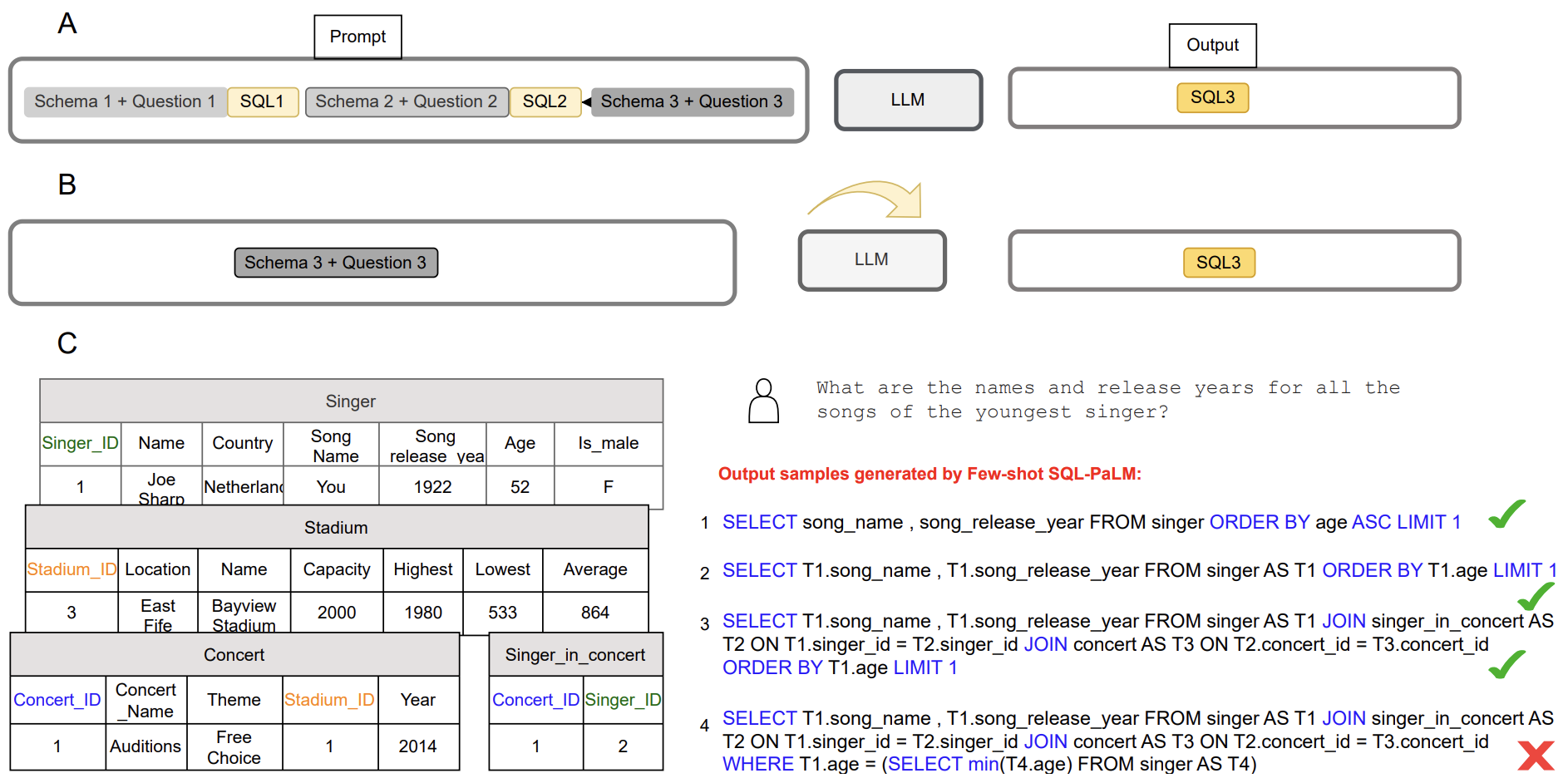

SQL-PaLM

◆

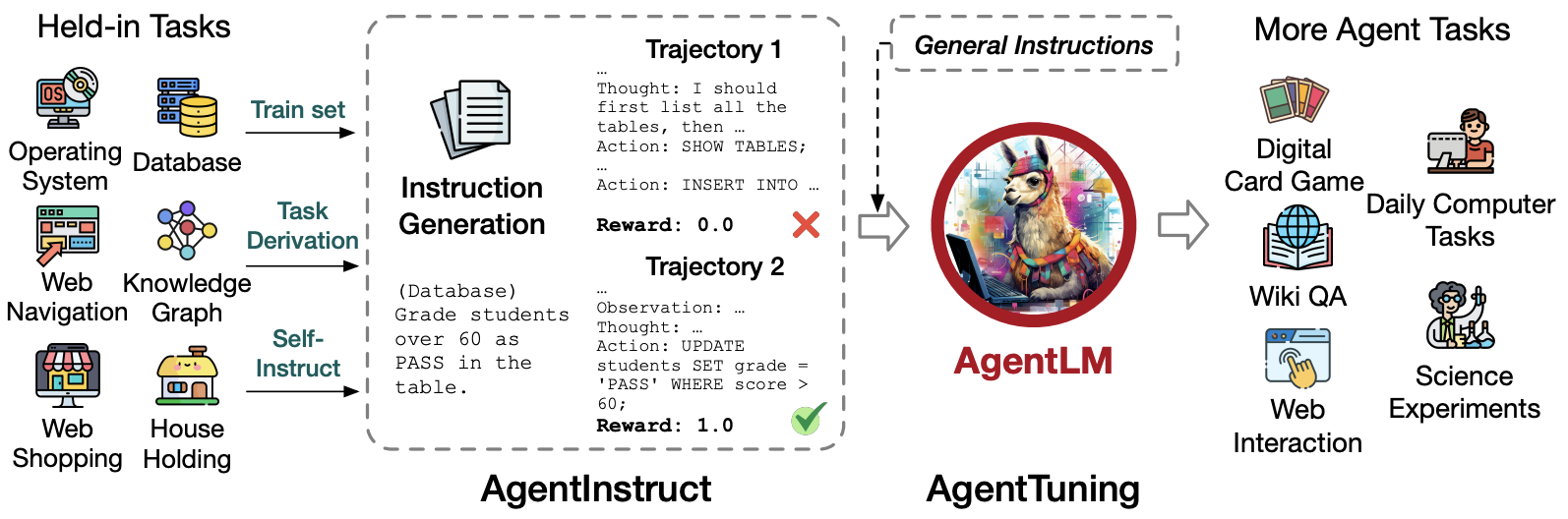

AgentTuning

◆

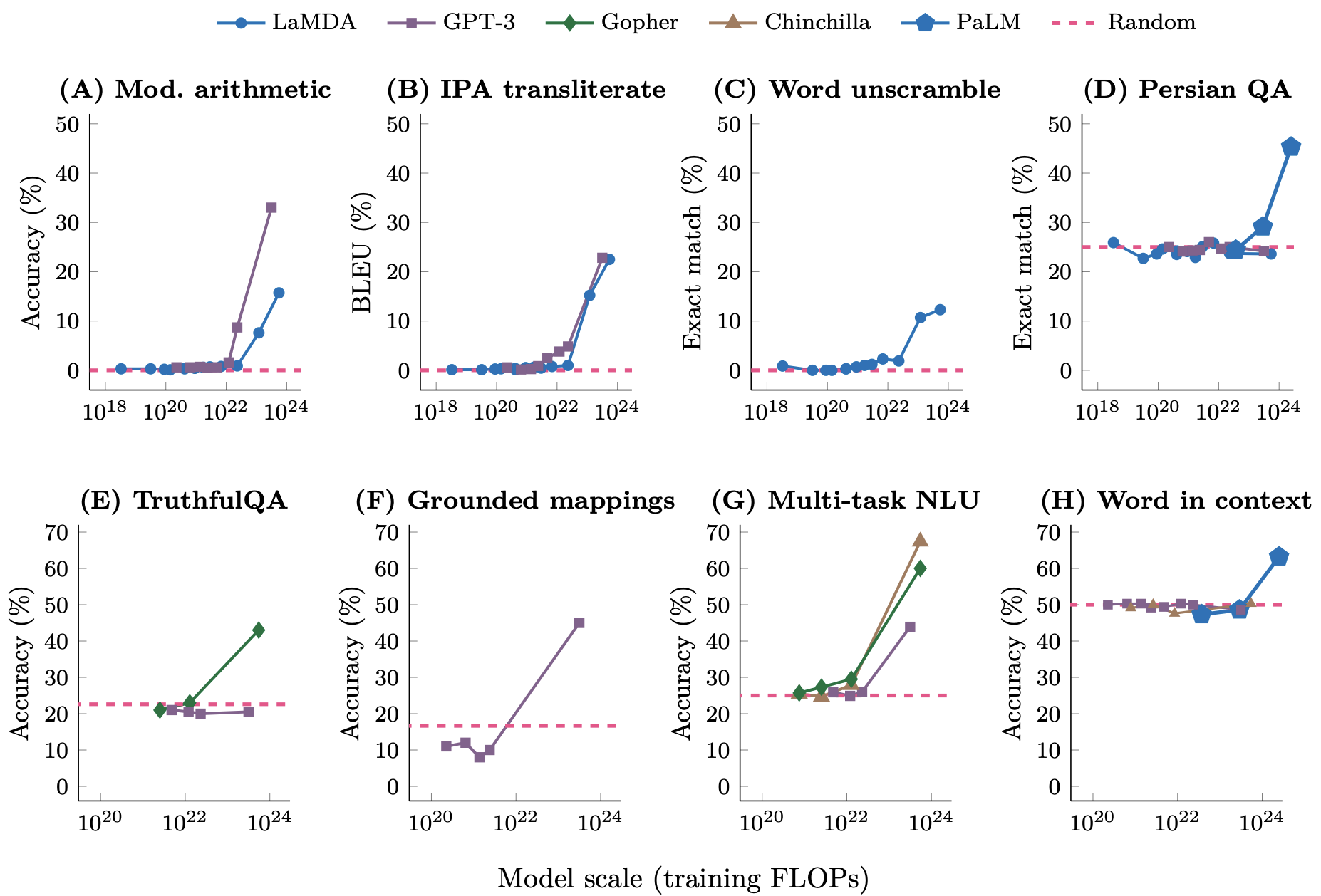

Model Scale

◆

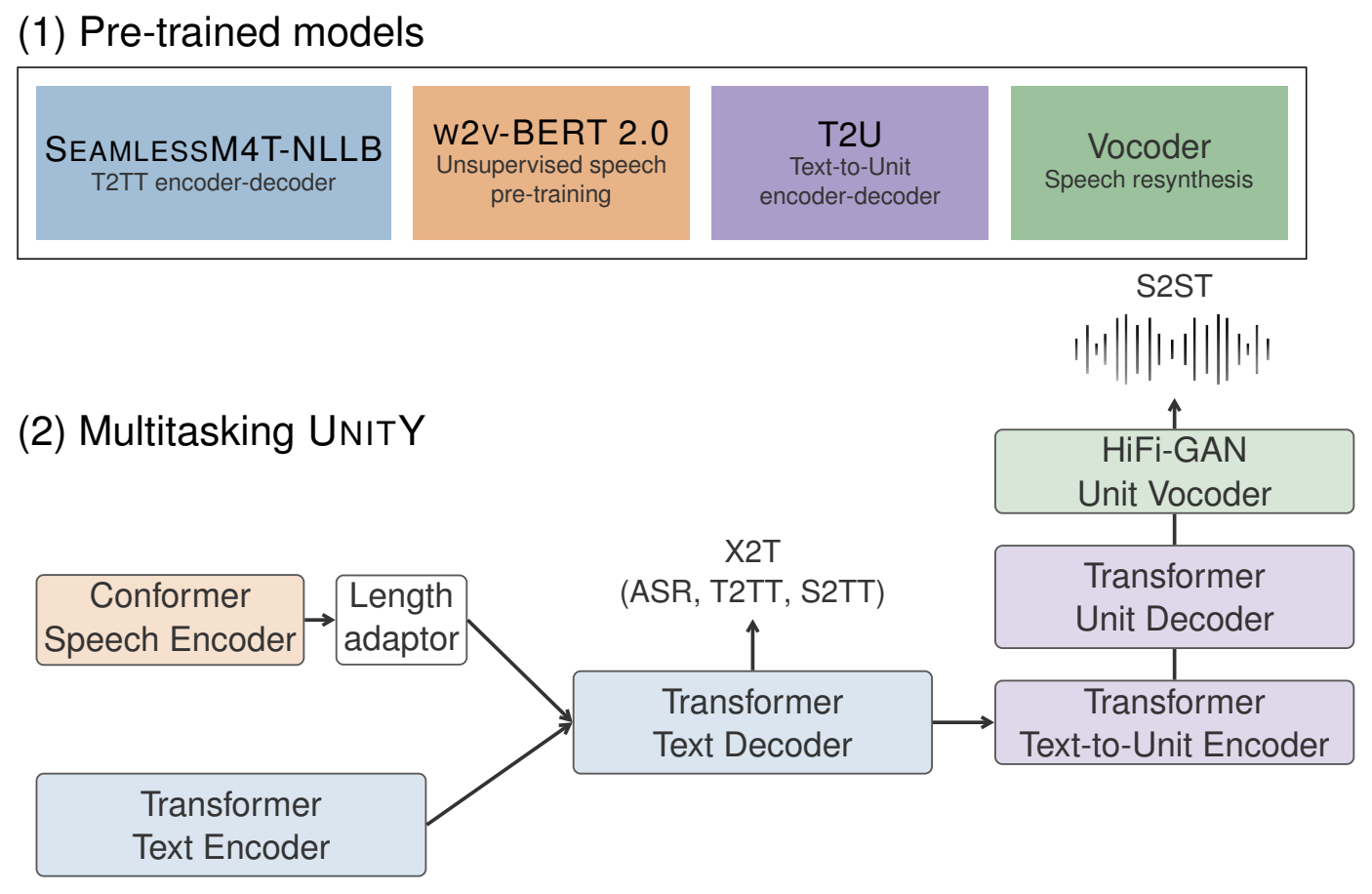

SeamlessM4T

大规模多语言和多模态机器翻译

◆